George

George

а как получить список меток?

смотреть в эту сторону https://serverfault.com/questions/1002890/get-array-of-latest-txg-values-and-uberblocks-using-zdb-on-a-zfs-pool

Evgenii

Evgenii

George

George

шифровальщик зашифровал шару на старом Freenas, а админ настроил снимки на корневой датасет, вместо рабочего вложенного... Может получится что то вытащить

сколько секунд после экспорта прошло? просто если сутками измеряется, то шансы ничтожны, по умолчанию 100 чтоли txg хранятся, или даже меньше

Evgenii

Evgenii

сколько секунд после экспорта прошло? просто если сутками измеряется, то шансы ничтожны, по умолчанию 100 чтоли txg хранятся, или даже меньше

Насколько я знаю, этот файловый сервер отключили сразу как нашли что файлы стали зашифрованы

Evgenii

Evgenii

сейчас там человек борется с freenas (вкладка включения службы ssh не прогружается, запустил обновление freenas), чтобы по ssh подключиться можно было, а то веб консоль там не позволяет промотать наверх, и посмотреть список txg который выводится командой

George

George

Evgenii

Evgenii

(вкладка включения службы ssh не прогружается, запустил обновление freenas).

пул я экспортировал уже

Ilya

Ilya

Насколько я знаю, этот файловый сервер отключили сразу как нашли что файлы стали зашифрованы

на родительский датасет НЕрекурсивно, что ли?

Сергей

Сергей

Должно было быть + - одинаково)) поэтому и говорю, что в один поток и сам зфс работает норм

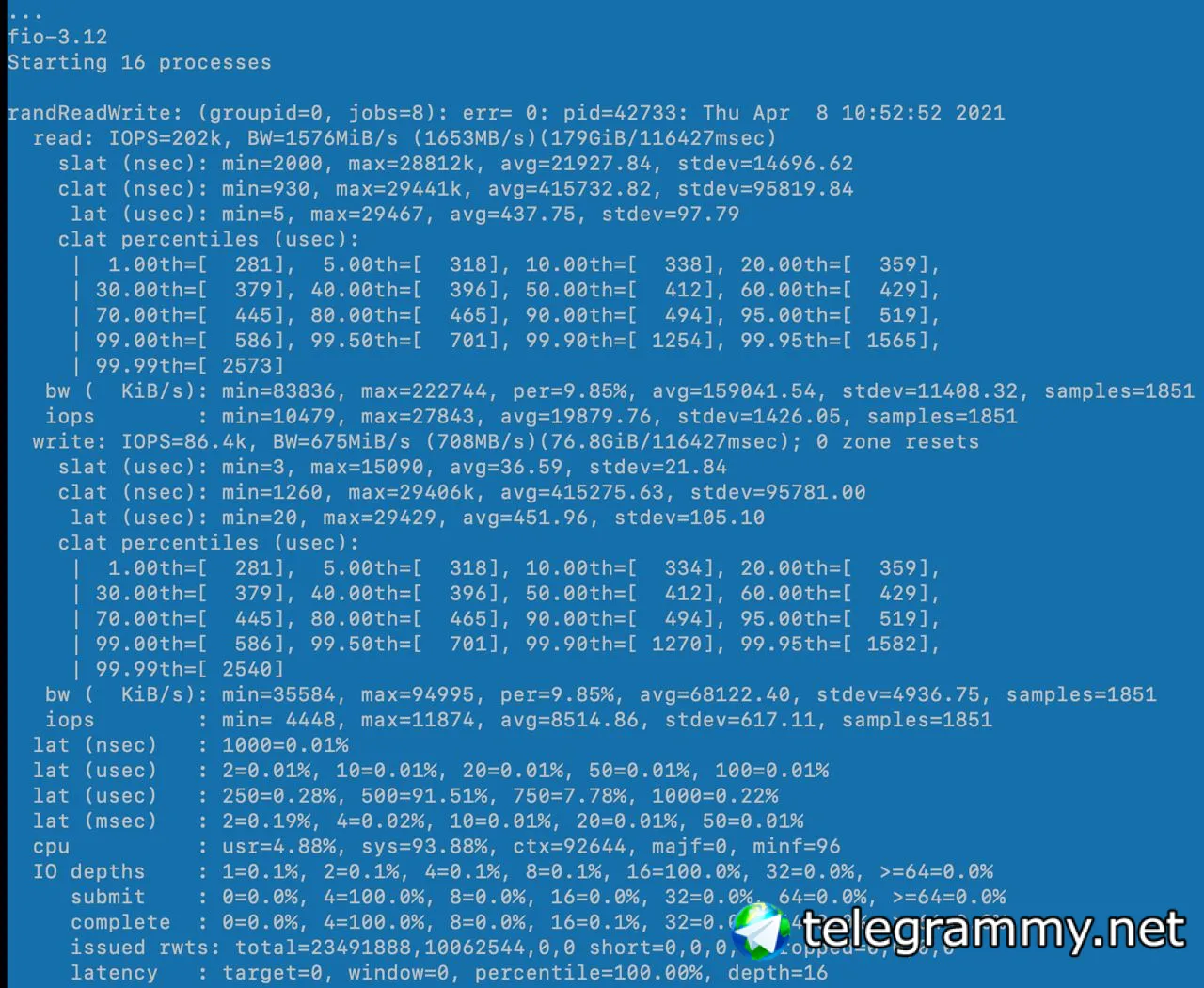

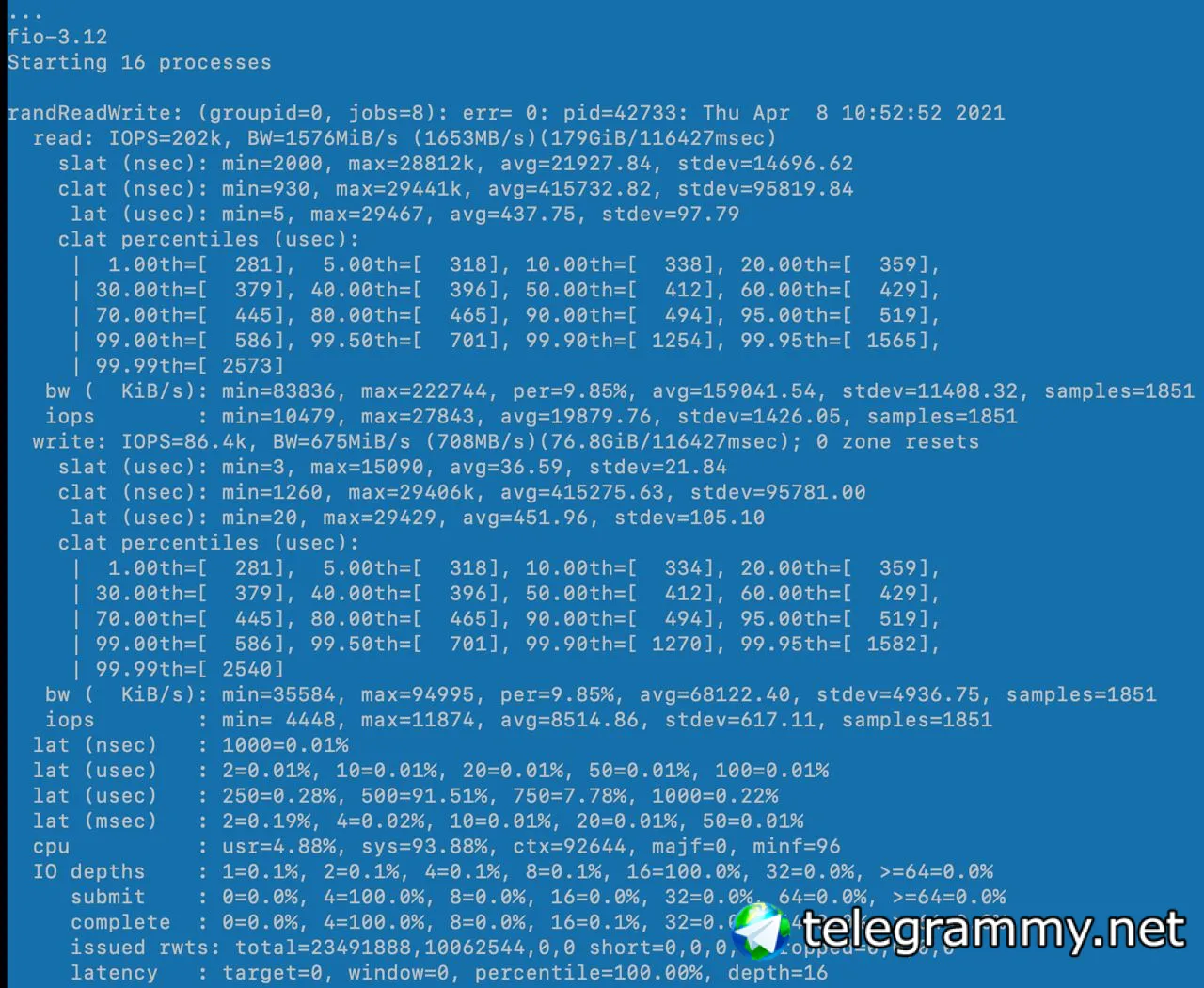

поднял архивы fio:

это для глубины 16 и кол-ва джоб 1,8,64.

выполняется два теста (файлы фио выкладывал тут в группе):

RandRW (70/30) и такой же RandRW (70/30), но с fsync=1

==== IOD 16-J1

Run status group 0 (all jobs):

READ: bw=232MiB/s (243MB/s), 232MiB/s-232MiB/s (243MB/s-243MB/s), io=22.4GiB (24.1GB), run=99039-99039msec

WRITE: bw=99.3MiB/s (104MB/s), 99.3MiB/s-99.3MiB/s (104MB/s-104MB/s), io=9831MiB (10.3GB), run=99039-99039msec

Run status group 1 (all jobs):

READ: bw=126MiB/s (132MB/s), 126MiB/s-126MiB/s (132MB/s-132MB/s), io=14.7GiB (15.8GB), run=120003-120003msec

WRITE: bw=53.0MiB/s (56.6MB/s), 53.0MiB/s-53.0MiB/s (56.6MB/s-56.6MB/s), io=6476MiB (6791MB), run=120003-120003msec

==== IOD 16-J8

Run status group 0 (all jobs):

READ: bw=588MiB/s (616MB/s), 588MiB/s-588MiB/s (616MB/s-616MB/s), io=68.9GiB (73.9GB), run=120002-120002msec

WRITE: bw=252MiB/s (264MB/s), 252MiB/s-252MiB/s (264MB/s-264MB/s), io=29.5GiB (31.7GB), run=120002-120002msec

Run status group 1 (all jobs):

READ: bw=308MiB/s (323MB/s), 308MiB/s-308MiB/s (323MB/s-323MB/s), io=36.1GiB (38.8GB), run=120001-120001msec

WRITE: bw=132MiB/s (138MB/s), 132MiB/s-132MiB/s (138MB/s-138MB/s), io=15.5GiB (16.6GB), run=120001-120001msec

==== IOD 16-J64

Run status group 0 (all jobs):

READ: bw=534MiB/s (560MB/s), 534MiB/s-534MiB/s (560MB/s-560MB/s), io=62.6GiB (67.2GB), run=120007-120007msec

WRITE: bw=229MiB/s (240MB/s), 229MiB/s-229MiB/s (240MB/s-240MB/s), io=26.8GiB (28.8GB), run=120007-120007msec

Run status group 1 (all jobs):

READ: bw=502MiB/s (527MB/s), 502MiB/s-502MiB/s (527MB/s-527MB/s), io=58.9GiB (63.2GB), run=120003-120003msec

WRITE: bw=215MiB/s (226MB/s), 215MiB/s-215MiB/s (226MB/s-226MB/s), io=25.2GiB (27.1GB), run=120003-120003msec

Alexander

Alexander

Сергей

Сергей

Приветствую, Сергей! А что у вас такое груп 0 и груп 1?

group 0 - randrw, 1 - randrw + fsync=1

Alexander

Alexander

Alexander

Alexander

там боьшая портянка, сейчас и ту часть выложу тогда

Спс, она более интересно, по бендвичу уже не помню. В памяти иопсы))

Alexander

Alexander

Ну и тут уже вижу, что на 16 джобах падение

На 64 ссори, но возможно уже и на 16 будет падать, до 8 росло

Сергей

Сергей

Ну и тут уже вижу, что на 16 джобах падение

?

J1:

group 0

read: IOPS=29.6k, BW=232MiB/s (243MB/s)(22.4GiB/99039msec)

write: IOPS=12.7k, BW=99.3MiB/s (104MB/s)(9831MiB/99039msec); 0 zone resets

group 1

read: IOPS=16.1k, BW=126MiB/s (132MB/s)(14.7GiB/120003msec)

write: IOPS=6907, BW=53.0MiB/s (56.6MB/s)(6476MiB/120003msec); 0 zone resets

J8:

group 0

read: IOPS=75.2k, BW=588MiB/s (616MB/s)(68.9GiB/120002msec)

write: IOPS=32.2k, BW=252MiB/s (264MB/s)(29.5GiB/120002msec); 0 zone resets

group 1

read: IOPS=39.4k, BW=308MiB/s (323MB/s)(36.1GiB/120001msec)

write: IOPS=16.9k, BW=132MiB/s (138MB/s)(15.5GiB/120001msec); 0 zone resets

Alexander

Alexander

Сергей

Сергей

Ну этож о чем я и говорил((( 40киопс с нвме - это ахтунг(((

в одном потоке). Зачем эксплуатировать ZFS и такие быстрые диски в одном потоке?

Ivan

Ivan

Ну этож о чем я и говорил((( 40киопс с нвме - это ахтунг(((

на голом диске эти тесты сколько кажут ?

Alexander

Alexander

в одном потоке). Зачем эксплуатировать ZFS и такие быстрые диски в одном потоке?

Синхроно в 8 потоков 50

Alexander

Alexander

в одном потоке). Зачем эксплуатировать ZFS и такие быстрые диски в одном потоке?

+ латенси я смотрю средняя стремится к 1мс

Alexander

Alexander

а вот это я и не помню точно

))) с сжатием иопсов больше в тестах кажут)) но результаты все равно лучше чем у меня на оптане🤔не понимаю как так

Сергей

Сергей

))) с сжатием иопсов больше в тестах кажут)) но результаты все равно лучше чем у меня на оптане🤔не понимаю как так

zfs на двух оптанах в зеркале? 905p?

Сергей

Сергей

в зфс то включено или нет ?

сейчас на пуле включено, а было ли включено при тестировании - не уверен в ответе. Делал разные варианты, но в названии теста не включал состоянии компрессии

Сергей

Сергей

У меня p4800 , если память не изменяет

отличная модель. У меня были только в реальном опыте 900p, я их под SLOG делал и под временные файлы остаток разделов в страйп 0 делал.

Alexander

Alexander

Сергей

Сергей

Ну где же 500 киопс, против 50

я на fsync=1 смотрю, мне именно этот тип записи больше всего интересует (у меня постгрес)

Alexander

Alexander

Alexander

Alexander

770 против 100

Вывод то понятен, хоть тут люди и спорили, на нвме пока делать нечего с zfs

Alexander

Alexander

в zfs sync включен был при тестах ?

Помоему по дефолту он там алвейс, но я и отключать пробовал

Сергей

Сергей

Alexander

Alexander

Сергей

Сергей

В арк не лег?))

сомневаюсь, там одновременно много же джоб запускалось. Из арк там бы скорость была на "миллионы", 48 ядер на машине

Alexander

Alexander

Сергей

Сергей

у прокса кстати есть анализ производительности за прошлый год:

https://www.proxmox.com/en/downloads/item/proxmox-ve-zfs-benchmark-2020

Сергей

Сергей

Осталось только повторить)) но я и рекордсайз уменьшал, особо не помогло

кстати, я в ядре всегда отключаю mitigations=off и init_on_alloc=0

Alexander

Alexander

а в голую сколько показывают 4800?

Прилично)) точные цифры могу завтра показать)) емнип у него по мануалу 500к на рандомную запись

Δαρθ

Δαρθ