George

George

да, тут надо аккуратно проверить что вы точно за раз весь файл вычитываете/записываете всегда

Δαρθ

Δαρθ

плюс если сжатие не включено, и в файле больше одного блока, то последний блок будет полного размера с нулями

тогда значит все куски данных строго recordsize? даже обрубки в конце файла?

George

George

тогда значит все куски данных строго recordsize? даже обрубки в конце файла?

если у файла больше чем 1 блок - то да. Но сжатие позволяет последний блок сжать

Δαρθ

Δαρθ

блин я наверное тупой :(

если сжатие выкл то файл 1.5мб с рекордсайз 1м займет 2мб

а если включено то в 1 рекордсайзе будет что? пусть например при этом файл не сжался до меньше 1м никак

George

George

блин я наверное тупой :(

если сжатие выкл то файл 1.5мб с рекордсайз 1м займет 2мб

а если включено то в 1 рекордсайзе будет что? пусть например при этом файл не сжался до меньше 1м никак

на сжатие всегда придут только данные одного блока

Олег

Олег

Решил тут детально мониторить ZFS на серверах. Кто чем мониторит? https://share.zabbix.com/operating-systems/zfs - оказался не рабочий, не сообразил как починить ошибку,root@voffice:~# /etc/zabbix/zfs.py

Traceback (most recent call last):

File "/etc/zabbix/zfs.py", line 153, in <module>

'vdevs': vdev_list(vdev_errors),

File "/etc/zabbix/zfs.py", line 87, in vdev_list

} for x in r if x[0].startswith('/')}

File "/etc/zabbix/zfs.py", line 87, in <dictcomp>

} for x in r if x[0].startswith('/')}

KeyError: '/dev/disk/by-id/ata-TOSHIBA_DT01ACA300_895BLKTAS-part3'

Roman

Roman

George

George

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Module%20Parameters.html#zfs-max-recordsize

Eugen

Eugen

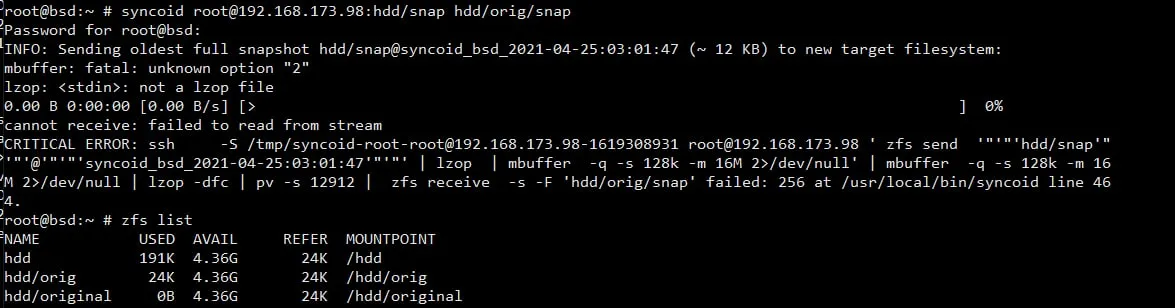

Правильно ли я понимаю? syncoid использует инструменты zfs send recv, но просто своими коммандами?

Evgenii

Evgenii

Правильно ли я понимаю? syncoid использует инструменты zfs send recv, но просто своими коммандами?

да, и все подобные тулзы

Evgenii

Evgenii

Eugen

Eugen

Через zfs send хоть получалось снимок отправить, им бы и пользовался, но не додумался еще как сделать так, что бы при следующей отправке, новый снимок заменил старый снимок на целевом сервере, при этом с целевого снимка уже сделано кучу клонов и они в работе 24/7.

Eugen

Eugen

Да, но другой уже работает, то есть он родитель дерева на удаленном сервере, и по этому не даст себя удалить без удаления всего дерева, верно? Значит нужен способ просто тихо обновить данные на нем

Evgenii

Evgenii

да я не о вашей проблеме пока еще речь веду. А о том, что бы мы говорили на одном языке.

нельзя заменить один снимок другим - нет такой операции в природе. Это речевая конструкция не имеет смысла в разрезе снимков

Eugen

Eugen

Хорошо, возможно такое можно сделать с клонами zvol, или на крайняк оригинальными наборами данных?

Eugen

Eugen

Специфика сервера такая, есть несколько zvol, с которых лелаются клоны, и вот кооны раздаются клиентам

Evgenii

Evgenii

по ssh реплицируете файловую систему, так? делаете снимок, и отправляете его на удаленный сервер. Там создается новая файловая система из снимка

Eugen

Eugen

То что работает сейчас, клонируется внутри каждого сервера, но это все затруднительнее с увеоичением числа таких серверов

Eugen

Eugen

Врт был бы механизм отправки на удаленные сервера снимка или клона датасета с актуальеыми изменениями по несколько раз в день, а уже на удаленных серверах с этого клонировать клиентам.

Evgenii

Evgenii

* у вас есть "золотая" файловая система, которую вы периодически обновляете

* в делаете копии золотой файловой системы на другие сервера, чтобы люди запускали с них виртуальные машины

* вы хотите иметь способ "сбрасывать" все изменения на клиентских серверах и накатывать обновление с "gold"

так?

Evgenii

Evgenii

я не понимаю как это можно сделать технически без обрыва в принципе, (без всякой привязки к ZFS)

Evgenii

Evgenii

такое вообще возможно? с помощью каких то известных вам технологий. Если да, опишите подробно механизм. Возможно я смогу прикинуть как это сделать в ZFS

Eugen

Eugen

Есть золотой образ zvol, внутри него винда. Раздается по iscsi ipxe, в момент загрузки с ipxe дергается скрипт, который удаляет старый клон+снап, и создает новый с золотого образа. В итоге клиент получает диски с актуальной инфой.

Evgenii

Evgenii

Но клиенты не в один момент перезагружаются если что, рандомно

у каждого клиента свой том. Тут нет технических ограничений тогда

Eugen

Eugen

Вопрос как золотой образ подгонять с удаленного сервера, и клонировать на месте, а потом обновить его, и при чем так что бы работающие люди этого не ощутили

Evgenii

Evgenii

в скрипте сейчас жестко задано имя снимка с которого создается новый клон, поэтому вы употребляли фразу "заменить снимок другим"?

Eugen

Eugen

Нет, я имел в виду замену клона/снимка на актуальный с удаленного (главного) сервера. И вот уже следующие клоны на клиентские пк делать с этого нового снимка/клона, пока не появится новый актуальный снимок с удаленного сервера

Evgenii

Evgenii

чтобы не запутаться - zfs clone работает только внутри одного zfs пула. То есть нельзя сделать клон на удаленную систему.

* вы отправите через zfs send копию файловой системы с основного сервера на удаленные сервера, указав определенный снимок.

* для "обновления" вы будете отправлять новые снимки с основного сервера на удаленные сервера. Точнее это будет команда zfs send -i имя_тома@исходный_снимок имя_тома@конечный_снимок | ssh root@ip zfs recv -v имя_тома

* когда ваш скрипт будет уничтожать клиентскую фс и снова клонировать ее из gold, он должен будет клонировать из последнего снимка.

* снимки можно удалять, если вам больше не нужно на них откатываться.

Evgenii

Evgenii

Evgenii

Evgenii

чтобы не запутаться - zfs clone работает только внутри одного zfs пула. То есть нельзя сделать клон на удаленную систему.

* вы отправите через zfs send копию файловой системы с основного сервера на удаленные сервера, указав определенный снимок.

* для "обновления" вы будете отправлять новые снимки с основного сервера на удаленные сервера. Точнее это будет команда zfs send -i имя_тома@исходный_снимок имя_тома@конечный_снимок | ssh root@ip zfs recv -v имя_тома

* когда ваш скрипт будет уничтожать клиентскую фс и снова клонировать ее из gold, он должен будет клонировать из последнего снимка.

* снимки можно удалять, если вам больше не нужно на них откатываться.

старые снимки gold тома на удаленных серверах можно будет удалять. Но они не смогут быть удалены, пока будет существовать хотя бы 1 клон - что логично. Как только все клиенты обновятся, удаление пройдет

Eugen

Eugen

старые снимки gold тома на удаленных серверах можно будет удалять. Но они не смогут быть удалены, пока будет существовать хотя бы 1 клон - что логично. Как только все клиенты обновятся, удаление пройдет

Та в этом и бочина, был бы способ обновить инфу не удаляя все клоны.

central

central