Krey

Krey

В смысле руками собрать статистику по всем файлам?

Могу дать прогу которая выдаёт статистику по размерам файлов

Mr.

Mr.

а какая связь с компрессией?

да это я уже посмотрел, основной пул. щас надо создать второй. На первом ssd и ashift поставил 13

edo1

edo1

потому что многие hdd уже с секторами по 4к, и большинство прошивок ssd оптимизируется под доступ блоками 4кб в разных бенчмарках, без того же crystaldiskmark не обходится ни один обзор ssd

Mr.

Mr.

я пока только начинаю работать с zfs по рекомендации коллеги, а так же на ssd поставил 13 так он утвердительно посоветовал

George

George

я пока только начинаю работать с zfs по рекомендации коллеги, а так же на ssd поставил 13 так он утвердительно посоветовал

Стандартная практика 12 для хдд, 13 для ссд. Вообще если не понимаете как это выяснить - стоит довериться zfs, он и базу дисков содержит выделяющихся

Mr.

Mr.

Mr.

Mr.

не понял вопрос

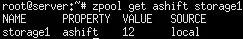

zpool get ashift на выхлопе куча всего. я создал пул, как узнать какой ashift я выбирал. Понимаю что возможно несу бред, но......

edo1

edo1

zpool get ashift на выхлопе куча всего. я создал пул, как узнать какой ashift я выбирал. Понимаю что возможно несу бред, но......

«куча всего» — это хелп по команде, судя по всему ))))

Mr.

Mr.

«куча всего» — это хелп по команде, судя по всему ))))

Буду просвещаться. На все времени катастрофически не хватает. утром ложися утром же и встаешь, хуё-мое и уже ночь

Andrew

Andrew

Могу дать прогу которая выдаёт статистику по размерам файлов

А есть что-то готовое, что может дать стату по используемому размеру блоков, типа liveoptics, но без выгрузки в чужие сервисы?

Krey

Krey

А есть что-то готовое, что может дать стату по используемому размеру блоков, типа liveoptics, но без выгрузки в чужие сервисы?

Не знаю что такое liveoptics. Просто себе прогу писал, показывает удобно стату по размеру файлов

Andrew

Andrew

Да, zdb показывает, но эт немного не то, что хочу. Профиль нагрузки больше интересует.

Решение не HCI, а файлстораж, который шарится по nfs и iscsi.

Интересует инфа о размере блоков, которыми нагружается таргет.

Andrew

Andrew

Мне тут ранее Сергей Голод показывал, как собирать стату поблочно, на линухах, через zfs iostat, очень понравилось. Надеялся, что есть что-то подобное, но не только для linux. Ну и с какой-то аггрегацией сразу.

Kolyanius

Kolyanius

Всем привет, как можно объяснить, что

команда

fio --name=random-write --ioengine=posixaio --rw=randwrite --bs=4k --size=4g --numjobs=1 --iodepth=1 --runtime=60 --time_based --end_fsync=1

выдает на

оптане write: IOPS=19.3k, BW=75.3MiB/s

на 2*RZ1(по 5 дисков) из старых hdd IOPS=22.9k, BW=89.3MiB/s

sync=standart atime=off comp=lz4

на TrueNAS 12.0

=Андрей=

=Андрей=

sync=standard

Полагаю оптан в LOG? При этой установке LOG может быть не задействован.... Это надо проверять, особенно при sync=always

Kolyanius

Kolyanius

sync=standard

Полагаю оптан в LOG? При этой установке LOG может быть не задействован.... Это надо проверять, особенно при sync=always

Оптан не как лог, а просто как zpool

Nikita

Nikita

Nikita

Nikita

wipefs -a

я делал dd if=/dev/zero of=/dev/sxx bs=1M, запись о ZFS стерлась c дисков, но это не помогло.

Григорий

Григорий

На сколько помню, поставить снуля на диски с таблицами zfs с первого раза не получиться. Нужно занулять wipefs, а потом уже ставить ОС.

Nikita

Nikita

разделы удалял ? может остались

Ну если даже диски другие он воспринимает как родные)

Где проблема с проверкой устройств sdc, sdd

George

George

George

George

Всем привет, как можно объяснить, что

команда

fio --name=random-write --ioengine=posixaio --rw=randwrite --bs=4k --size=4g --numjobs=1 --iodepth=1 --runtime=60 --time_based --end_fsync=1

выдает на

оптане write: IOPS=19.3k, BW=75.3MiB/s

на 2*RZ1(по 5 дисков) из старых hdd IOPS=22.9k, BW=89.3MiB/s

sync=standart atime=off comp=lz4

на TrueNAS 12.0

Ну тестите асинхронную запись, zfs её умеет аггрегировать эффективно

Алексей

Алексей

Алексей

Алексей

но вообще с дисков зфс вычистить можно через zpool labelclear. но это не ваш судя по всему случай

Δαρθ

Δαρθ

central

central

Fedor

Fedor

Владимир

Владимир

Nikolay

Nikolay