edo1

edo1

у него позиция: в меру подгаживать gpl-несовместимому коду, паразитирующему на ядре. стратегически это правильно (вспоминаем всякие nvidia).

а openzfs просто заодно огребает ((((

edo1

edo1

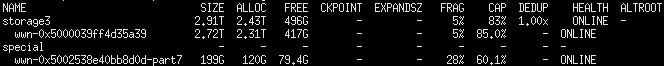

> На дефрагментацию вообще не смотрите, до заполнения 80% диска она вас не потревожит, и пусть вас не смущает показатель fragmentation у zpool — он показывает приблизительную фрагментацию метаданных, не более.

а если vdev чисто для данных (есть special), то что показывает фрагментация?

George

George

edo1

edo1

How the percentages relate to the average segment size of free space goes roughly like this. Based on the current Illumos kernel code, if all free space was in segments of the given size, the reported fragmentation would be:

512 B and 1 KB segments are 100% fragmented

2 KB segments are 98% fragmented; 4 KB segments are 95% fragmented.

8 KB to 1 MB segments start out at 90% fragmented and drop 10% for every power of two (eg 16 KB is 80% fragmented and 1 MB is 20%). 128 KB segments are 50% fragmented.

2 MB, 4 MB, and 8MB segments are 15%, 10%, and 5% fragmented respectively

16 MB and larger segments are 0% fragmented.

тут пишут, что процент фрагментации считается по (условно) среднему размеру свободного блока

George

George

https://console.dev/qa/rsync-john-kozubik/

Problems began to arise as early as 2008, however, as we began to push the boundaries of UFS2 - both in terms of filesystem size and number of inodes (files). Not only did we start to see prohibitively long fsck times but we started to run out of memory address space that fsck could track inodes with.

At some point in 2011, while working with Kirk McKusick, the author of UFS, I wondered out loud what the real, long-term solution was to the problems we were having as we pushed UFS2 well beyond its design … and he simply said “use ZFS”.

George

George

George

George

https://console.dev/qa/rsync-john-kozubik/

Problems began to arise as early as 2008, however, as we began to push the boundaries of UFS2 - both in terms of filesystem size and number of inodes (files). Not only did we start to see prohibitively long fsck times but we started to run out of memory address space that fsck could track inodes with.

At some point in 2011, while working with Kirk McKusick, the author of UFS, I wondered out loud what the real, long-term solution was to the problems we were having as we pushed UFS2 well beyond its design … and he simply said “use ZFS”.

So we embarked on a two year testing and development project to stress test and deploy ZFS which culminated in our first production ZFS systems in 2013. It took another four years before we migrated the final UFS2 storage array to ZFS.

вот правильные сроки для тестирования решений у людей 😁

Igor

Igor

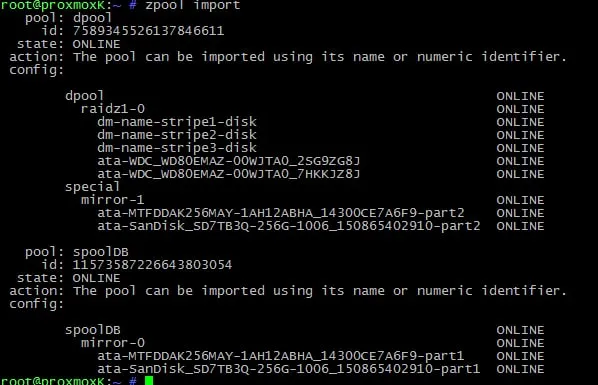

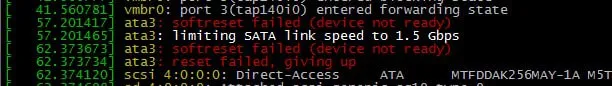

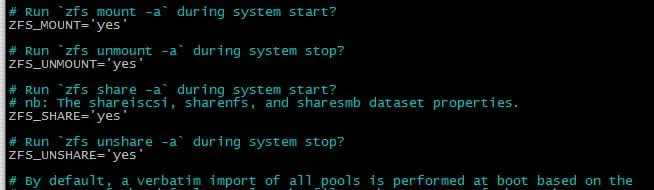

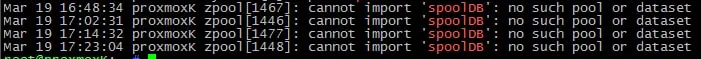

добрый день. Есть пул, собранный на 5 дисках и 3ссд зеркало для спешла +пул на трех ссд зеркалах. Вывалился один диск. ПРишла нотификация, ничего страшного, начал готовить замену. Ребутнулся и все, пулы не хотят автоматически маунтится

Igor

Igor

вообще ничего не трогал. просто отвалился диск и ребутнул систему. до того все работало идеально

d

d

=Андрей=

=Андрей=

Igor

Igor

root zfs протюнил и не отваливается. Он монтировался идеально... а вот два других пула, где был трупик - не маунтились автоматом

edo1

edo1

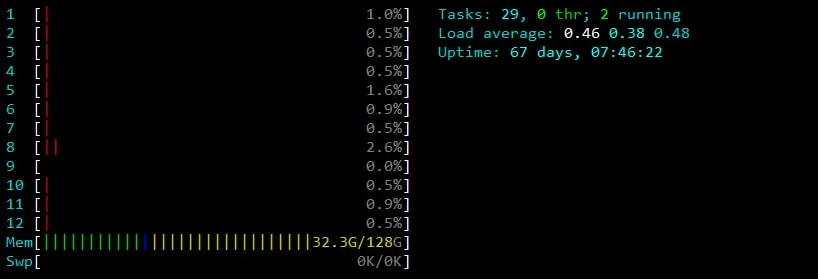

Ilya

Ilya

Да, это то, что в htop'е жёлтым. При необходимости, система освободит его под нужды других сервисов

Александр

Александр

Доброй ночи!

Не могу взять в толк. volblocksize - это свойство zvol. В случае Proxmox, который создает по zvol под каждый диск, это позволяет, и правда, задавать параметр под каждый диск каждой машины, но - это нужно делать при создании zvol, а создает его сам прокс. В итоге, как управлять параметром volblocksize к пользе каждой виртуалки?

И еще - если прокс берет этот параметр равным 8к, а это даст хорошие IOPSы, то - вроде как мы и получили быстрый (точнее, отзывчивый) строрадж? В чем польза от существенно больших volblocksize - только в повышении скорости линейного чтения?

Алексей

Алексей

Александр

Александр

в свойствах стороджа можно поменять волблоксайз

Дефолтное значение в проксе - 8К, если не ошибаюсь. Для БД это значение хорошее, правильно? Дедупликацией не балюсь )

Александр

Александр

Ок, а как тогда делать ВМ с дисками с разной величиной volblocksize? При создании диска прокс не спрашивает, сколько ставить )

Δαρθ

Δαρθ

central

central

Krey

Krey

Fedor

Fedor

Eugen

Eugen