edo1

edo1

но чтобы он получился, нам надо, чтобы эти два мегабайта лежали одним куском; и очень желательно, чтобы и читались одним куском

edo1

edo1

что один диск потратит 10мс на поиск, что два диска потратят по 10мс на поиск, быстрее не будет

edo1

edo1

но! в первом случае у вас второй диск свободен и может пока выполнять другие команды, а во втором он занят

edo1

edo1

если у вас 1000 пользователей скачивают файлы, то запросы могут (и будут) приходить одновременно (многопоточная нагрузка)

edo1

edo1

Александр

Александр

Друзья, подскажите: есть у меня проксмокс, есть на нем пул, собранный из двух SSD- дисков. Есть легенда, что под виртуалки нужно правильно выбирать recordsize. У меня нагрузка невысока (машины с веб-серверами, часть тестовая притом), но есть, скажем, диски в машинах, где лежат статические файлы, есть - где лежит БД MySQL. Я особо разницы не заметил, но, может, и "смотреть" не сумел.

Но в ZFS размеры блоков динамические, т.е. size не должен влять сильно?

Сергей

Сергей

Александр

Александр

"внутри" zfs лежат, проксмокс так кладет. По факту это raw оказывает, записанный в блочном устройстве, реализованном как zfs

Владимир

Владимир

Друзья, подскажите: есть у меня проксмокс, есть на нем пул, собранный из двух SSD- дисков. Есть легенда, что под виртуалки нужно правильно выбирать recordsize. У меня нагрузка невысока (машины с веб-серверами, часть тестовая притом), но есть, скажем, диски в машинах, где лежат статические файлы, есть - где лежит БД MySQL. Я особо разницы не заметил, но, может, и "смотреть" не сумел.

Но в ZFS размеры блоков динамические, т.е. size не должен влять сильно?

это не легенда, так и есть, у меня в разных виртуалках от 8кб до 128кб, на бекапах 1мб

Владимир

Владимир

А причина в чем, если динамически размер будет выбираться?

я от тебя услышал впервые про динамический размер)

Владимир

Владимир

И как выбрать, где 8к, где 128к сделать?

ну 8кб я ставлю под постгрескул, 128кб там где нет сильной нужды в иопсах

Сергей

Сергей

"внутри" zfs лежат, проксмокс так кладет. По факту это raw оказывает, записанный в блочном устройстве, реализованном как zfs

для таких блочных устройств размер блока фиксированный - volblock. по умолчанию прокс его делает 8к

recsize - это размер блока для файловых систем создаваемых на zfs. Которые например можно биндить к контейнерам или сами контейнеры лежат в таких файловых системах

Александр

Александр

так я могу или не могу, в сумме, оптимизировать производительность вирт. диска с БД, скажем, против диска со статикой?

Владимир

Владимир

так я могу или не могу, в сумме, оптимизировать производительность вирт. диска с БД, скажем, против диска со статикой?

перефразируй, мне что-то не понятен твой вопрос)

Александр

Александр

Собственно, все сводится к такому: как выжать из zfs максимальную скорость работы диска ВМ. Можно ускорять не все ВМ-диски, а только содержащие (внутри ВМ) файлы БД (pgsql или mysql).

Владимир

Владимир

Собственно, все сводится к такому: как выжать из zfs максимальную скорость работы диска ВМ. Можно ускорять не все ВМ-диски, а только содержащие (внутри ВМ) файлы БД (pgsql или mysql).

я постгрескул и мускуль вообще стараюсь держать в контейнерах, не в вируталках

Владимир

Владимир

ну и вообще, постгрескул у меня тянул производительность на моей практике когда я выделял мало ОЗУ на воркера что порождало создание темп файлов и просаживало дисковую произовдительность ухудшая отклик.

Сергей

Сергей

Собственно, все сводится к такому: как выжать из zfs максимальную скорость работы диска ВМ. Можно ускорять не все ВМ-диски, а только содержащие (внутри ВМ) файлы БД (pgsql или mysql).

поставить volblock size = XXk, где XX - размер страницы для вашей СУБД

подключить к zfs SLOG для ускорения операций синхронной записи (fsync)

ну и Владимир правильно указал - вынести СУБД из ВМ и разместить в контейнере.

Владимир

Владимир

Собственно, все сводится к такому: как выжать из zfs максимальную скорость работы диска ВМ. Можно ускорять не все ВМ-диски, а только содержащие (внутри ВМ) файлы БД (pgsql или mysql).

ты вот скажи, тебе записи не хватает или чтения?, ну вот это хотя бы для начала)

Александр

Александр

ты вот скажи, тебе записи не хватает или чтения?, ну вот это хотя бы для начала)

Кажется, что записи. Потому что при потоке на запись субд тупить сильно больше начинает, конечно.

Владимир

Владимир

Кажется, что записи. Потому что при потоке на запись субд тупить сильно больше начинает, конечно.

это сейчас про какуюсубд речь?

Александр

Александр

Ну и вообще как ты определил что именно накопителя мало?

Скорее, есть вопрос, что-то можно выжать еще больше из него )

Владимир

Владимир

Скорее, есть вопрос, что-то можно выжать еще больше из него )

ты не думал что может ты не там жмёшь?))

Сергей

Сергей

универсальный ответ sync=disabled

для СУБД)))), ага - "лечит". До первого падения хоста

edo1

edo1

поставить volblock size = XXk, где XX - размер страницы для вашей СУБД

подключить к zfs SLOG для ускорения операций синхронной записи (fsync)

ну и Владимир правильно указал - вынести СУБД из ВМ и разместить в контейнере.

я сейчас задумался, ещё надо ext4 (или что там в виртуалке) сказать, что файлы нужно выравнивать на границу 8кб, иначе ерунда получится

Сергей

Сергей

я сейчас задумался, ещё надо ext4 (или что там в виртуалке) сказать, что файлы нужно выравнивать на границу 8кб, иначе ерунда получится

ну да, подровнять "размеры" всех вложенных ФС

Александр

Александр

я сейчас задумался, ещё надо ext4 (или что там в виртуалке) сказать, что файлы нужно выравнивать на границу 8кб, иначе ерунда получится

а как "сказать"? ext4, да

edo1

edo1

For example, if you use volblocksize=8k and ext4 on top of that, you should create the ext4 with "-b 4096 -E stripe-width=2"

https://zfsonlinux.topicbox.com/groups/zfs-discuss/T968b07629ed860c3

Александр

Александр

поставить volblock size = XXk, где XX - размер страницы для вашей СУБД

подключить к zfs SLOG для ускорения операций синхронной записи (fsync)

ну и Владимир правильно указал - вынести СУБД из ВМ и разместить в контейнере.

Когда я поставлю volblock, ори применится к новым данным, так? Те нужно создать пустой диск, поставить ему в zfs volblock, потом создать фс в вм на этом диске, и скопировать файлы данных бд?

Александр

Александр

Сергей

Сергей

Когда я поставлю volblock, ори применится к новым данным, так? Те нужно создать пустой диск, поставить ему в zfs volblock, потом создать фс в вм на этом диске, и скопировать файлы данных бд?

volblock применяется ко всему тому. в томе не может быть блоков разного размера

Владимир

Владимир

Когда я поставлю volblock, ори применится к новым данным, так? Те нужно создать пустой диск, поставить ему в zfs volblock, потом создать фс в вм на этом диске, и скопировать файлы данных бд?

можно просто переместить уже существующий том и при перемещении он создастся с заданным волблоком

Александр

Александр

volblock применяется ко всему тому. в томе не может быть блоков разного размера

Те перенести данные с тома, убить том, заново его создать с новым volblock, вернуть машины, и как-то потом еще фс внутри проверить на выравнивание?

Сергей

Сергей

Те перенести данные с тома, убить том, заново его создать с новым volblock, вернуть машины, и как-то потом еще фс внутри проверить на выравнивание?

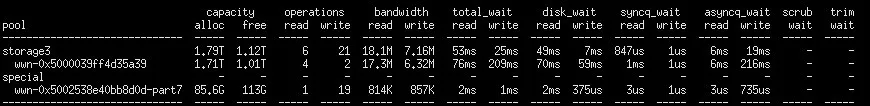

zfs get volblocksize rpool/XXXX

покажите для вашего диска

edo1

edo1

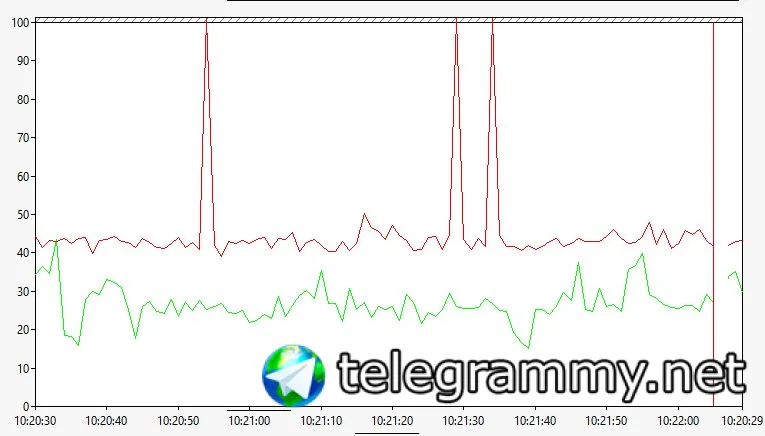

картинка с винды, извините.

время доступа на запись в микросекундах

красным оптан, зелёным какой-то серверный intel

Сергей

Сергей

картинка с винды, извините.

время доступа на запись в микросекундах

красным оптан, зелёным какой-то серверный intel

а что за оптан? P48XX, P5XXX?

edo1

edo1

в общем-то почти любой серверный ssd при разумной глубине очереди будет на записи заметно быстрее оптана

Сергей

Сергей

в общем-то почти любой серверный ssd при разумной глубине очереди будет на записи заметно быстрее оптана

дайте название вашего серверного ССД. Я вам по спекам покажу что он не может быть быстрее оптана

edo1

edo1

а что за оптан? P48XX, P5XXX?

десктопный, но тут это роли не играет, задержки у них одинаковые.

optane пишет напрямую во флэш (wt), а обычный накопитель кэширует в памяти (wb)

Сергей

Сергей

Да

с точки зрения volblocksize уже ничего делать не нужно. Можно попробовать пересоздать ext4 как советовали выше, но чуда я бы не ждал. "Чудо" будет если отключите sync, но это чревато...

Сергей

Сергей

Алексей

Алексей

Evgenii

Evgenii