Egor V

Egor V

с ZFS по NFS кто-нибудь скорости добивался? При раздачи по nfs скорость записи падает раз в 5-10, при локальном диске все гуд.

https://wiki.freebsd.org/ZFSTuningGuide#NFS_tuning

Alexander

Alexander

Roman

Roman

Это какой -же штатный?

https://github.com/open-iscsi/targetcli-fb в репах дебиана тоже есть

дальше в пуле датасторы создаете и их блочные девайсы раздаете

George

George

https://wiki.freebsd.org/ZFSTuningGuide#NFS_tuning

Лол, это прекрасно See ZFS Evil Tuning Guide, section "Disabling the ZIL (Don't)".

Nikolay

Nikolay

#Вопсро Принимаю инкриментные бэкапы. Получил такую ошибку.

zfs cannot receive incremental stream: destination space quota exceeded.

Вычитал что это когда размер снапшота превышает quota. Но у меня quota=none Есть только refquota=150G. Установил её в none и ошибка ушла. Получается refquota так же размер снапшота ограничивает ?

George

George

Я не терял. Полет уже несколько лет.

выдерните розетку из хранилища и найдите данные за последние секунд 5

Т.е. zfs будет консистентен, но если у вас какое-то кластерное решение где sync запись всё же важна, то может быть чревато

George

George

#Вопсро Принимаю инкриментные бэкапы. Получил такую ошибку.

zfs cannot receive incremental stream: destination space quota exceeded.

Вычитал что это когда размер снапшота превышает quota. Но у меня quota=none Есть только refquota=150G. Установил её в none и ошибка ушла. Получается refquota так же размер снапшота ограничивает ?

по доке ты прав, на память не скажу во что конкретно ты упёрся

George

George

Согласен

я так то тоже люблю sync=disabled, но как панацея советовать его даже не вспомнив про atime=off, recordsize, mirrors вместо raidz, xattr=sa...

Олег

Олег

Олег

Олег

Не пробовал кто-нибудь в реальности JBOD сделанные на Raid карте Adaptec перенести на hba адаптер?

Олег

Олег

переносил в обратную сторону, сконфигурировав на raid диски как jbod.

всё нормально.

Мне нужно с 5xxx адаптека мигрироваться или на LSI HBA SAS2 вот и вопрос.

А метка у дисков не слетела? FS на месте оказалась и все ок?

Alex

Alex

Там был древний raidz, времён 8-9й фри, на голых дисках.

После переноса массив продолжил работать без проблем.

George

George

Товарищи, а что говорят не так у zfs+nvme?

Работает, просто утилизировать много nvme в пуле пока не особо получится, есть куда оптимизировать код

George

George

Типа много накопителей работают туго?

Не туго, а смысла мало т.к. Не утилизируются по производительности полностью

Владимир

Владимир

я даже от 4 SSD в зеркале не могу получить больше 5k IOPS

сколько потоков, по сколько кб запросы?

Eugen

Eugen

я даже от 4 SSD в зеркале не могу получить больше 5k IOPS

То есть в теории даже от сата ссд можно больше получить в теории?)

Vladislav

Vladislav

То есть в теории даже от сата ссд можно больше получить в теории?)

да, вот есть такие Интелы

https://ark.intel.com/content/www/us/en/ark/products/82935/intel-ssd-dc-s3610-series-480gb-2-5in-sata-6gb-s-20nm-mlc.html

еще минус оверхед, дает RAID контроллер, через который они подключены как JBOD

Vladislav

Vladislav

5c интервал, но еще надо оптимизацию внутри VM делать, чтоб не жрали лишний раз IOPS

capacity operations bandwidth

pool alloc free read write read write

---------- ----- ----- ----- ----- ----- -----

rpool-SSD 181G 699G 778 7,13K 3,39M 128M

rpool-SSD 181G 699G 475 5,69K 2,11M 116M

rpool-SSD 181G 699G 328 4,66K 1,29M 91,7M

rpool-SSD 180G 700G 227 3,62K 937K 70,8M

rpool-SSD 180G 700G 220 2,81K 916K 66,2M

rpool-SSD 180G 700G 291 3,90K 1,20M 110M

rpool-SSD 180G 700G 283 3,70K 1,16M 83,5M

Eugen

Eugen

Ну это не много на самом деле. Но по наблюдениям и правда, продуктивность сата и нвме в единичных дисках считай одинаковые. Есть несколько серверов с саташными и нескалько с нвме, работают одинаково шустро. Но я думал что все нивелирует arc

Alexander

Alexander

Ребят а как заквотировать 20 процентов объема чтобы zfs не зпаполняла из и всехда оставались свободные блоки?

Alexander

Alexander

при заполнении пула более 80 процентов zfs просаживается по производительности записи т.к. дольше ищет свободные блоки

Alexandr

Alexandr

можно ли уменьшит объем scpecial (сделан на разделах) если изначально было выделено чрезмерно много места под него?

Roman

Roman

Alexandr

Alexandr

Отключить, пересоздать.

а как потом мету на него снова вытеснить и смалл файлы? (перелив всего объема не предлагать)

George

George

George

George

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Module%20Parameters.html#spa-slop-shift

George

George

можно ли уменьшит объем scpecial (сделан на разделах) если изначально было выделено чрезмерно много места под него?

Если в пуле нет raidz, то как уже предложили - исключить из пула и создать нужный. Иначе только через пересоздание пула

Alexandr

Alexandr

Спасибо всем что подтвердили, я надеялся что вдруг я чего то не знаю и перелива можно избежать(

Roman

Roman

Если в пуле нет raidz, то как уже предложили - исключить из пула и создать нужный. Иначе только через пересоздание пула

Где об этом написано, про raidz в пуле?

George

George

Где об этом написано, про raidz в пуле?

В манах https://openzfs.github.io/openzfs-docs/man/8/zpool-remove.8.html

Алексей

Алексей

Коллеги, прошу помочь. во время сенда завис мбуффер на принимающей стороне, снапшот не докопировался, датасет "подвис". сделал роллбэк, откатилось, но у датасета по прежнему остался резюме токен. и при попытке повторно накатить выдает cannot receive incremental stream destination has been modified contains partially-complete state from "zfs receive -s". я как то раньше такое фиксил, но не могу вспомнить как. 😁

George

George

Алексей

Алексей

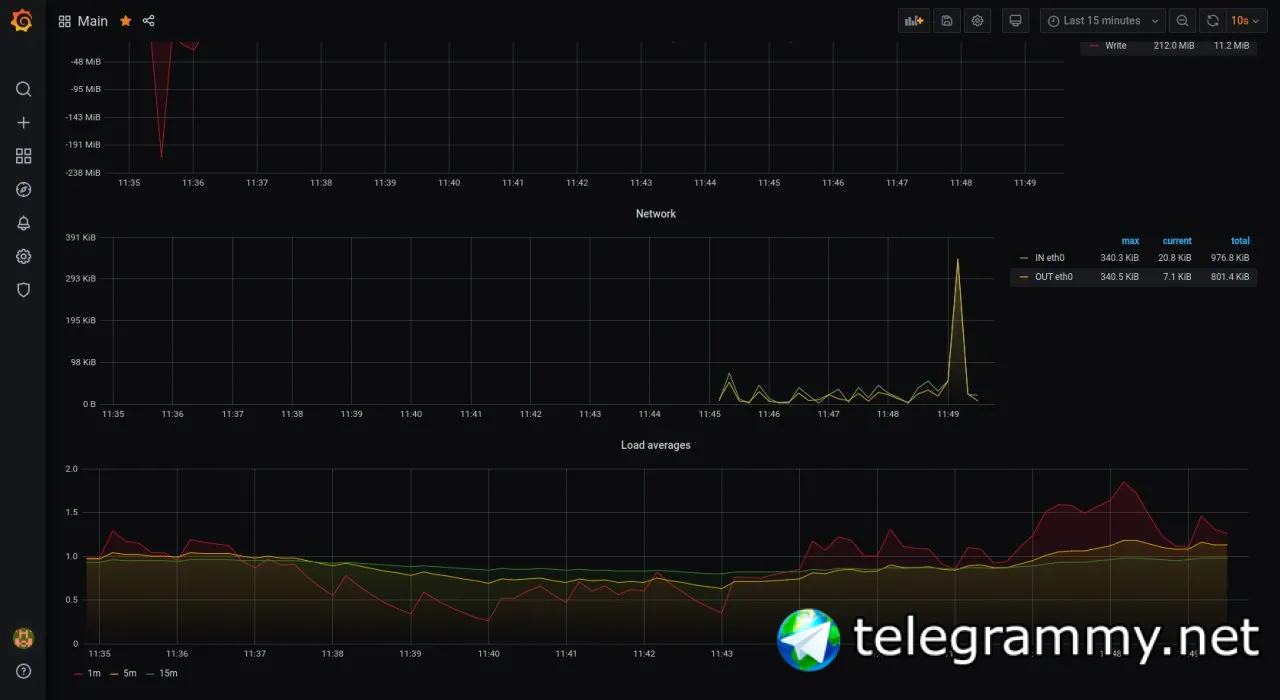

хммммммм. оказыватся это не мбуффер завис, а пул ведет себя странно. читает как не в себя. хотя никаких процессов кроме наливки в него снапшота на нём нет

Ivan

Ivan

Алексей

Алексей

connect to [192.168.100.10] from host04.a.b [192.168.100.4] 36440

in @ 0.0 kiB/s, out @ 0.0 kiB/s, 1168 MiB total, buffer 0% full

summary: 1181 MiByte in 12min 50.7sec - average of 1569 kiB/s

cannot receive incremental stream: destination pooli/subvol-122-disk-0 has been modified

since most recent snapshot