Krey

Krey

И мой вам совет, гоните метлой всяких визуалстудийщиков, поставьте линукс и найдите разрабов под линукс, сэкономите и нервы и деньги.

Не слушайте советов тех, кто не отличает среду разработки от тулчейна

ウァシーリイ

ウァシーリイ

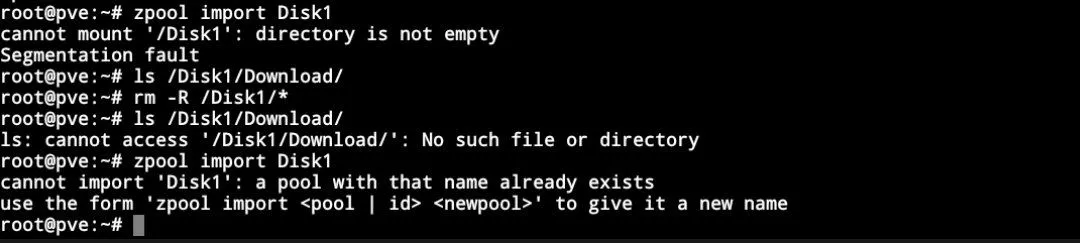

Почему-то он пропал, до этого работало всё. Единственное вмешательство было - подключил в проксмоксе самба шару этого диска и туда бэкапы делал

Олександр

Олександр

По ошибке запустил в зеркале replace нормального диска на новый. Ресильвер идет, сервер работает. А че, так можно было? :)

Vladislav

Vladislav

По ошибке запустил в зеркале replace нормального диска на новый. Ресильвер идет, сервер работает. А че, так можно было? :)

да, но есть шанс, что рабочий диск сбойнет и вы рискуете остаться без пула.

Олександр

Олександр

Это ясно как божий день. Просто не думал что возможно вообще. Уже заменил сбойный на "освободившийся", все ок.

d

d

Это ясно как божий день. Просто не думал что возможно вообще. Уже заменил сбойный на "освободившийся", все ок.

Повод alignment поправить на диске, например

Mikhail

Mikhail

А какой io шедулер использует zfs?

zfs вроде работает и на винде и на bsd. Так что скажем что ортогонально к шедулерам blk/blk-mq. ибо разные подсистемы

Murmuring

Murmuring

zfs вроде работает и на винде и на bsd. Так что скажем что ортогонально к шедулерам blk/blk-mq. ибо разные подсистемы

То есть шедулер тот, что в системе по умолчанию стоит ?

Mikhail

Mikhail

То есть шедулер тот, что в системе по умолчанию стоит ?

Да, стоит то что выбрало ядро линукса в зависимости от типа устройства.

Mikhail

Mikhail

Ок, спасибо

это по логике и по небольшому опыту. Лучше спросить ж пошире мнение, ибо могу и ошибаться.

Murmuring

Murmuring

То есть шедулер тот, что в системе по умолчанию стоит ?

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Module%20Parameters.html#zfs-vdev-scheduler

When the pool is imported, for whole disk vdevs, the block device I/O scheduler is set to zfs_vdev_scheduler. The most common schedulers are: noop, cfq, bfq, and deadline.

In some cases, the scheduler is not changeable using this method. Known schedulers that cannot be changed are: scsi_mq and none. In these cases, the scheduler is unchanged and an error message can be reported to logs.

nikolay

nikolay

вопрос - можно ли собрать на двух SSD по 800 Gb (SAS, mixed workload) special vdev в mirror для пула из 4-х vdev по 10 HDD в raidz2? особенно с учетом "The redundancy of this device should match the redundancy of the other normal devices in the pool"

Nikita

Nikita

вопрос - можно ли собрать на двух SSD по 800 Gb (SAS, mixed workload) special vdev в mirror для пула из 4-х vdev по 10 HDD в raidz2? особенно с учетом "The redundancy of this device should match the redundancy of the other normal devices in the pool"

У меня реданданси в спешиала вообще нигде не совпадает с реданданси остальных вдев.

Всё работает, тьфу-тьфу, не падает.

Nikita

Nikita

Кстати, а безболезненно извлечь спешиал вдев из пула уже можно? Или с момента появления он намертво завязан?

Ivan

Ivan

Кстати, а безболезненно извлечь спешиал вдев из пула уже можно? Или с момента появления он намертво завязан?

можно. тогда special будет писаться на hdd пул.

Nikita

Nikita

но вродь special+raidz - неочень связка.

Сорри, а почему?

На всех моих инсталляциях со спешиал - спешиал представлен зеркалом из двух ссд, а прочие вдев в пуле - raidz разной степени избыточности.

Чем плоха подобная связка?

Ivan

Ivan

Сорри, а почему?

На всех моих инсталляциях со спешиал - спешиал представлен зеркалом из двух ссд, а прочие вдев в пуле - raidz разной степени избыточности.

Чем плоха подобная связка?

я точно не помню в чем заковырка. то ли слабая производительность, то ли нельзя special на raidz "выключить"

нужно у @gmelikov уточнить

George

George

можно. тогда special будет писаться на hdd пул.

нееееет! zpool remove работает пока ТОЛЬКО если в пуле нет raidz vdevs!

George

George

У меня реданданси в спешиала вообще нигде не совпадает с реданданси остальных вдев.

Всё работает, тьфу-тьфу, не падает.

iirc главное чтобы реданданси хоть какое-то было, сколько дисков может вылететь он в обязательной проверке емнип не считал

George

George

о, не знал ) я только на raid10 юзаю.

в draid просто всё ещё хуже с эффективностью хранения мелких блоков (мета в первую очередь), там даже сначала для меты тупо зеркало внутри было (не помню как в итоговом патче правда)

nikolay

nikolay

в draid просто всё ещё хуже с эффективностью хранения мелких блоков (мета в первую очередь), там даже сначала для меты тупо зеркало внутри было (не помню как в итоговом патче правда)

Георгий, а как в моем случае быть с объемом спешиал вдев? Объём пула у меня 216 тб, полезный объём 161 тб

George

George

Георгий, а как в моем случае быть с объемом спешиал вдев? Объём пула у меня 216 тб, полезный объём 161 тб

примерно так

Option #1: Take the estimate that the metadata SSD should be about 0.3% of the pool size for a typical workload. For atypical workloads scale appropriately.

Option #2: run "zdb -Lbbbs POOLNAME" for block statistics. Level 0 ZFS Plain File and Level 0 zvol objects do NOT go to the metadata SSD, but everything else would. This may take a while, but would give the most accurate answer possible. Oh, and use the ASIZE column for your measurements.

nikolay

nikolay

George

George

тупой вопрос - как расшифровывается аббревиатура iirc?) не первый раз вижу ее в чате..

if I remember correctly; if I recall correctly. https://www.dictionary.com/browse/iirc

Fedor

Fedor

if I remember correctly; if I recall correctly. https://www.dictionary.com/browse/iirc

Привет! А в зфс дедуп по аналогии с хеш-таблицами реализован?

George

George

Привет! А в зфс дедуп по аналогии с хеш-таблицами реализован?

в дедуп под капот не смотрел, не скажу точно

Олег

Олег

Скажите, кто-нибудь использует ZFS с дедупликацией под бекапы? Сколько вам удается сэкономить места на диске?

Олег

Олег

Олег

Олег

@Oller22 а в PBS, что вас больше всего привлекает?

Халява и возможно бекапа proxmox инкрементально

Egor V

Egor V

Сравнивал EMC DataDomain, HPE StoreOnce и MS NTFS DEDUP. На одинаковом наборе данных (450 Гб виртуалок разных) коэффициент дедупа почти одинаков 1:8.8

Eugen

Eugen

Владимир

Владимир