Alexandr

Alexandr

ну или проще, просто убедитесь что на блоксхеме мамки, эти линии идут непосредственно в проц

Nikita

Nikita

Гуд, благодарю.

Ещё вопрос тогда.

Диски в разных контроллерах отличаются по количеству и производительности. Везде хдд, но сами хдд по iops отличаются.

В таком случае всё равно, всё в один пул и один vdev? Или пытаться сбалансировать их в приблизительно одинаковые по производительности vdev одного пула?

Ну т.е. пример - четыре хдд 3.5 дюйма сата на встроенном контроллере и и по 6 хдд 2.5 дюйма в двух дискретных контроллерах. Их все в один пул и один вдев? Или один пул и raidz2 на 4-х дисках встроенного контроллера и два вдев raidz3 на 6-ти дисках каждого отдельного контроллера?

Александр

Александр

Nikita

Nikita

Вот не стал бы я такое делать. Эскадра равняется по тихоходу

Если не затруднит, уточните посыл пожалуйста.

Александр

Александр

Если не затруднит, уточните посыл пожалуйста.

Обращения к более медленным дискам в пуле заметно нивелируют прирост скорости от более быстрых.

Alexandr

Alexandr

Гуд, благодарю.

Ещё вопрос тогда.

Диски в разных контроллерах отличаются по количеству и производительности. Везде хдд, но сами хдд по iops отличаются.

В таком случае всё равно, всё в один пул и один vdev? Или пытаться сбалансировать их в приблизительно одинаковые по производительности vdev одного пула?

Ну т.е. пример - четыре хдд 3.5 дюйма сата на встроенном контроллере и и по 6 хдд 2.5 дюйма в двух дискретных контроллерах. Их все в один пул и один вдев? Или один пул и raidz2 на 4-х дисках встроенного контроллера и два вдев raidz3 на 6-ти дисках каждого отдельного контроллера?

да, лучше однотипные диски собирать в 1 vdev, желательно не миксовать (но к котроллеру это не относится)

Nikita

Nikita

Ок, т.е. однотипные диски в отдельные vdev с собственной избыточностью.

В таком случае штраф по перфомансу будет минимален.

Благодарю всех за помощь.

Ещё момент (понимаю, что он описан в доках, но раз уж зацепились) - при операциях чтения\записи в пулах с несколькими vdev нагрузка равномерно распределяется между всеми vdev или по мере заполнения используются отдельные vdev последовательно? Ну т.е. при 10% заполнения пула, где эти 10% целиком укладываются в объём первого vdev - использоваться будет только он?

Случай со special не рассматриваем.

George

George

Ок, т.е. однотипные диски в отдельные vdev с собственной избыточностью.

В таком случае штраф по перфомансу будет минимален.

Благодарю всех за помощь.

Ещё момент (понимаю, что он описан в доках, но раз уж зацепились) - при операциях чтения\записи в пулах с несколькими vdev нагрузка равномерно распределяется между всеми vdev или по мере заполнения используются отдельные vdev последовательно? Ну т.е. при 10% заполнения пула, где эти 10% целиком укладываются в объём первого vdev - использоваться будет только он?

Случай со special не рассматриваем.

по умолчанию запись на vdevs идёт всегда равномерно, при дисбалансе занятого пространства он будет предпочитать менее занятый vdev, если кратко

Владимир

Владимир

Всем привет. Есть хост машина с zfs raid 1 на nmve дисках от samsung. И по результатам тестирования скорость записи занижена 1700 а скорость чтения 5500 хотя заявленная скорость накопителя 3500 на чтение и 3500 на запись. Тесты проводил через dd. Может кто сталкивался с таким поведением или я в корне не верно провожу тестирование сокрости ?

Autumn

Autumn

Всем привет. Есть хост машина с zfs raid 1 на nmve дисках от samsung. И по результатам тестирования скорость записи занижена 1700 а скорость чтения 5500 хотя заявленная скорость накопителя 3500 на чтение и 3500 на запись. Тесты проводил через dd. Может кто сталкивался с таким поведением или я в корне не верно провожу тестирование сокрости ?

dd это не лучший способ тестирования. Используйте например fio.

Autumn

Autumn

Не уверен, чем обусловлена скорость записи, но скорость чтения скорее всего достигнута за счет ARC.

Владимир

Владимир

Не уверен, чем обусловлена скорость записи, но скорость чтения скорее всего достигнута за счет ARC.

Что есть arc? Извиняюсь если глупые вопросы.

Autumn

Autumn

Что есть arc? Извиняюсь если глупые вопросы.

Вам стоит почитать про архитектуру ZFS. ARC - кеш в оперативной памяти. По сути при тесте чтения, само чтение похоже происходило из этого кеша, т.е. из оперативки, а не с ссд. Ну и как вариант с обоих ссд одновременно, т.к. у Вас зеркало. Но я не могу точно ответить не зная что у Вас там и как сконфигурировано и как Вы тестировали.

Владимир

Владимир

Вам стоит почитать про архитектуру ZFS. ARC - кеш в оперативной памяти. По сути при тесте чтения, само чтение похоже происходило из этого кеша, т.е. из оперативки, а не с ссд. Ну и как вариант с обоих ссд одновременно, т.к. у Вас зеркало. Но я не могу точно ответить не зная что у Вас там и как сконфигурировано и как Вы тестировали.

Я вас понял. Кеш выделял 8гб . Завтра попробую произвести тестирование через fio

Autumn

Autumn

Я вас понял. Кеш выделял 8гб . Завтра попробую произвести тестирование через fio

вот тут прочтите https://habr.com/ru/company/mailru/blog/529516/

Ivan

Ivan

Я вас понял. Кеш выделял 8гб . Завтра попробую произвести тестирование через fio

пересоздайте пул с ashift=13

Autumn

Autumn

Я вас понял. Кеш выделял 8гб . Завтра попробую произвести тестирование через fio

8ГБ мало, минимум 4, лучше 16-32.

Autumn

Autumn

пересоздайте пул с ashift=13

можно с ashift=12, 13 сожрет кучу места но в скорости разница будет ну такой себе, но тут человеку надо сначала почитать что такое и как работает zfs и зачем нужен этот ashift.

Autumn

Autumn

Я даже особо не конфигурировал поставил из коробки проксмокс на zfs raid 1

А зачем прокс на nvme ставить? Ему обычных сата ссд за глаза для работы, а вот уже хранилище для виртуалок на nvme будет отлично.

Владимир

Владимир

Ну он особо много места не знамает почему бы его в зеркало не поставить раз он сам это умеет.

Autumn

Autumn

Ну он особо много места не знамает почему бы его в зеркало не поставить раз он сам это умеет.

Ну вот поэтому пара обычных сата ссд на 250 ГБ за глаза. nvme для таких целей как по мне расточительно. В любом случае при установке есть опции настройки ФС, там можно было попробовать ashift=13 (ashift=12 там по умолчанию), остальное не должно влиять. Ну и я бы попробовал, если возможно, установить прокс на одну ссд, а вторую просто отформатить в ext4 и подмонтировать и вот на ней уже прогнать тесты. Может проблема в аппаратной части.

Autumn

Autumn

Версию UEFI обновить может. Хз, что еще посоветовать. Голый тест ссд с ext4 это то с чего бы я начал, естественно после обновления UEFI матринки.

Владимир

Владимир

Ну вот поэтому пара обычных сата ссд на 250 ГБ за глаза. nvme для таких целей как по мне расточительно. В любом случае при установке есть опции настройки ФС, там можно было попробовать ashift=13 (ashift=12 там по умолчанию), остальное не должно влиять. Ну и я бы попробовал, если возможно, установить прокс на одну ссд, а вторую просто отформатить в ext4 и подмонтировать и вот на ней уже прогнать тесты. Может проблема в аппаратной части.

Пробовал тесты на win диски показывают по 3500 что по очереди что в однавременнлм тесте.

Autumn

Autumn

Пробовал тесты на win диски показывают по 3500 что по очереди что в однавременнлм тесте.

Ну вот, тест на голой ext4 покажет хотя бы направление проблемы - если не железо то либо ОС либо сам дистр и драйвер в ядре.

Владимир

Владимир

Владимир

Владимир

Кстати, а какие рекомендации для ashift если zfs будет использоваться как хранилище для виртуалок ? (1x NVME) ?

Vladislav

Vladislav

nagual

nagual

Всем привет. Есть хост машина с zfs raid 1 на nmve дисках от samsung. И по результатам тестирования скорость записи занижена 1700 а скорость чтения 5500 хотя заявленная скорость накопителя 3500 на чтение и 3500 на запись. Тесты проводил через dd. Может кто сталкивался с таким поведением или я в корне не верно провожу тестирование сокрости ?

Попробуйте потестировать в разных fs хттп_гитхаб/nagual2/Test/blob/master/test_fs_ubuntu.sh

nagual

nagual

Есть хранилище из 6-ти дисков по 500 гиг zraid2 1.7 гига скорость /bonnie++ где то 427 / 427 записал 900 гиг сделал новый датасет и протестировал, скорость 225 / 314 ... свободное пространсво у них общее ...

d

d

Подумалось: а что если грузиться с небольших дешёвых USB флешек через UEFI, а основные диски и SSD не размечать, а целиком в сыром виде отдать под ZFS пулы?

А то я каждый раз мучаюсь с разметкой дисков вспоминая что у меня да как там. Недавно перепутал src и dst таблицы разделов и запорол один диск, пришлось сутки ресильвера ждать.

Nikita

Nikita

Кстати, а на производительность есть какое-то влияние в сценарии использования разделов на диске и сырых дисков в составе пулов?

Сейчас всегда отрезаю один раздел, чуть меньше заявленного объема диска, чтобы из-за десятка килобайт разбежки в объеме у различных вендоров не попасть в ситуацию "для замена диска с объемом N придется использовать диск с объемом 2*N, ибо точно таких же моделей нет, а альтернативы на пару-тройку килобайт меньше".

Возможно зря я так заморачиваюсь, на самом деле.

Владимир

Владимир

ниразу так не заморачивался)), хотя коегде оставляем порядка 10% диска не размеченным, но по другой причине

Nikita

Nikita

Правда стрёмно, диски на 10+ терабайт скачут в сыром объеме ощутимо.

Не приходилось пока заменять прям другими моделями, удавалось выбить оригиналы, но рано или поздно придется.

С другой стороны, к тому моменту и ценники будут не такими страшными.

Олег

Олег

Имеем

pool: rpool

state: ONLINE

scan: resilvered 1.03G in 0 days 00:00:30 with 0 errors on Tue Nov 10 09:43:59 2020

config:

NAME STATE READ WRITE CKSUM

rpool ONLINE 0 0 0

ata-ST1000LM024_HN-M101MBB_S30YJ9BH627271-part3 ONLINE 0 0 0

Нужно добавить диск в зеркало,

root@v14:~# zpool attach rpool /dev/disk/by-id/ata-WDC_WD10SPCX-21KHST0_WD-WX11A86A7X0H-part3

missing <new_device> specification

Чет не соображу какую комманду построить, подскажите плиз

George

George

Имеем

pool: rpool

state: ONLINE

scan: resilvered 1.03G in 0 days 00:00:30 with 0 errors on Tue Nov 10 09:43:59 2020

config:

NAME STATE READ WRITE CKSUM

rpool ONLINE 0 0 0

ata-ST1000LM024_HN-M101MBB_S30YJ9BH627271-part3 ONLINE 0 0 0

Нужно добавить диск в зеркало,

root@v14:~# zpool attach rpool /dev/disk/by-id/ata-WDC_WD10SPCX-21KHST0_WD-WX11A86A7X0H-part3

missing <new_device> specification

Чет не соображу какую комманду построить, подскажите плиз

https://openzfs.github.io/openzfs-docs/man/8/zpool-attach.8.html

Владимир

Владимир

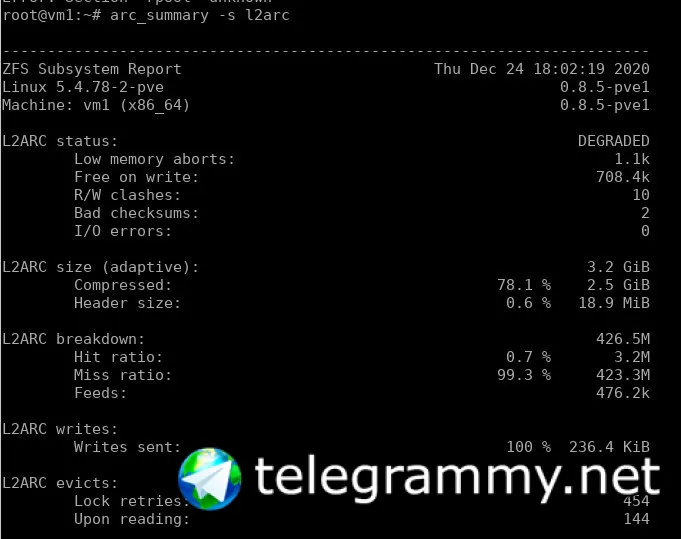

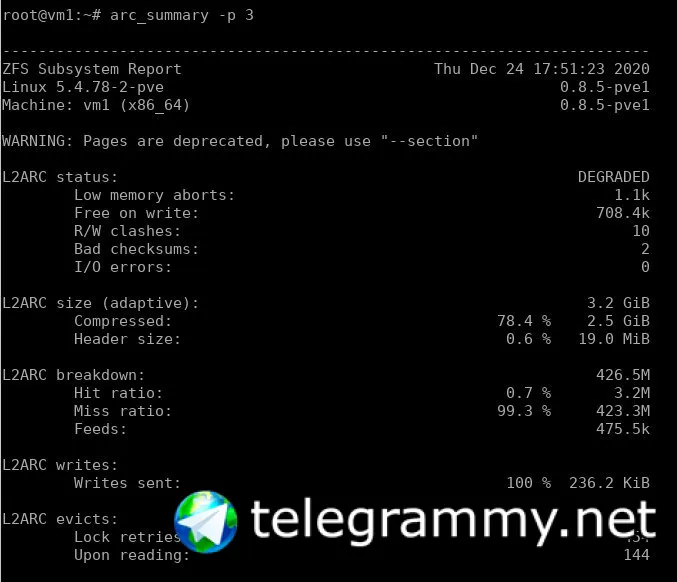

Доброго дня, а какой командой я могу посмотреть статистику l2arc и почему команда

arc_summary -p 3 может показывать

L2ARC status: DEGRADED

Сергей

Сергей

Доброго дня, а какой командой я могу посмотреть статистику l2arc и почему команда

arc_summary -p 3 может показывать

L2ARC status: DEGRADED

именно этой командой и смотреть. Может наверное если ваш l2arc приказал долго жить

Владимир

Владимир

именно этой командой и смотреть. Может наверное если ваш l2arc приказал долго жить

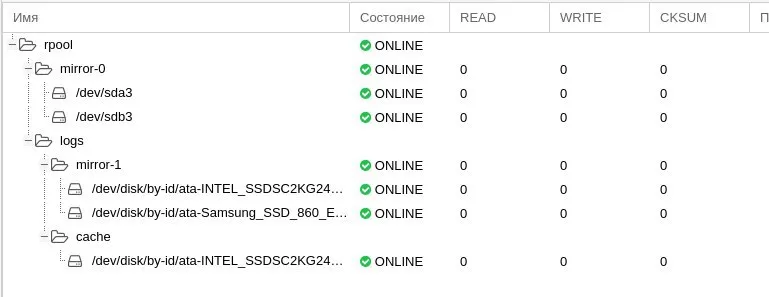

ну в статусе пула он онлайн

Владимир

Владимир

не от того, что команда страницы устарела? Там вроде так и ругаеццо

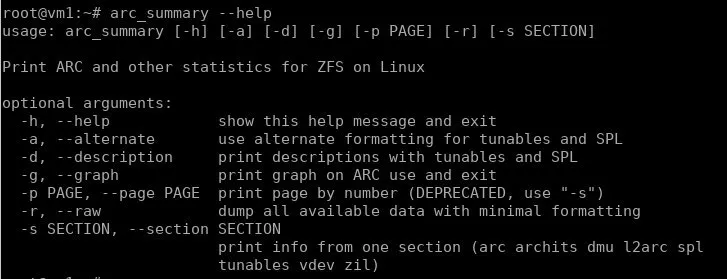

да вижу, но я не понял синтаксиса новой команды

LordMerlin

LordMerlin

A1EF

A1EF