Dima

Dima

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Module%20Parameters.html?highlight=zfs_no_scrub_prefetch#zfs-no-scrub-prefetch

спасибо, это я и сам нашел. Я не понимаю почему это так на летенси влияет

George

George

спасибо, это я и сам нашел. Я не понимаю почему это так на летенси влияет

ну префетч= доп нагрузка на диски.

но т.к. вы явно сказали про латенси, вас может это задевать, если у вас hdd https://github.com/openzfs/zfs/pull/11166

Nikolay

Nikolay

fio --ioengine=libaio --filename=/ton618/fio/file --sync=0 --rw=write --bs=16K --numjobs=4 --iodepth=1 --group_reporting --name=writeBackup --filesize=10G --runtime=120

c sync=0 - скорость аж почти 1 Гб/с Но утилизация дисков >90% slog 10%

с sync=1 - 111 Мб\с (так понимаю это реальная скорость) Утилизация дисков ~10% slog - 99%

Это на raidz3

max

max

Народ, совет нужен

Собираюсь брать доманий сервак, есть 8x SAS 15k 600gb

И 2 контролера по 4 канала

Думал про рейд, планирую на каждом из контролеров сделать raid 0 ( чтобы все диски контроллера были одним) а вот между контролёрами сделать зеркало.

Суть вопроса какой из рейдов делать аппаратным , а какой программным ?

Ivan

Ivan

Народ, совет нужен

Собираюсь брать доманий сервак, есть 8x SAS 15k 600gb

И 2 контролера по 4 канала

Думал про рейд, планирую на каждом из контролеров сделать raid 0 ( чтобы все диски контроллера были одним) а вот между контролёрами сделать зеркало.

Суть вопроса какой из рейдов делать аппаратным , а какой программным ?

зочем сас 15k, когда можно ssd поставить ?

max

max

этож интерфейс вроде как

SATA - кострированый и удешевлённый SAS, он рулит тем что у него 12гб в секунду ширина капканов передачи + надежность

Fedor

Fedor

SATA - кострированый и удешевлённый SAS, он рулит тем что у него 12гб в секунду ширина капканов передачи + надежность

сата это слегка улучшенный IDE

Fedor

Fedor

в сата нельзя, например, сказать "запиши ка мне 1000 блоков, забитых нулями" или "повтори последний блок"

Fedor

Fedor

Самое важное отличие sata от sas - это наличие в scsi/sas сети между устройствами, позволяющее сделать множество плюшек, типа расширения хранилища доп. модулями с дисками или множественных путей доступа к устройству

Ivan

Ivan

SAS мне вышел на 60% дешевле чем ssd

неолайн наверно ?

кмк хороший sata ssd лучше sas hdd 15k. sas ssd канешна еще лучше )

Fedor

Fedor

неолайн наверно ?

кмк хороший sata ssd лучше sas hdd 15k. sas ssd канешна еще лучше )

по датарейту и иопсам лучше, но на этом все преимущества заканчиваются.

Dima

Dima

ну префетч= доп нагрузка на диски.

но т.к. вы явно сказали про латенси, вас может это задевать, если у вас hdd https://github.com/openzfs/zfs/pull/11166

Спасибо за ссылку, очень похоже на правду

Evgenii

Evgenii

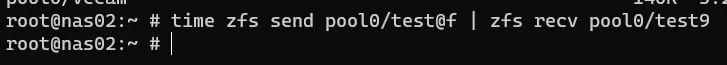

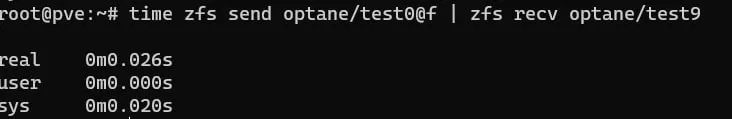

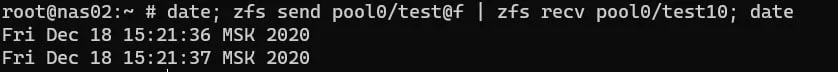

Кто нибудь знает как измерить время работы пайпа? хочу померять скорость передачи снимков с разным сжатием на приемнике

ivdok

ivdok

ivdok

ivdok

Попробуй ещё пайпить вывод не в консоль, а другой файл. Или >/dev/null 2>&1

$ time lspci >/dev/null 2>&1

real 0m0.012s

user 0m0.011s

sys 0m0.000s

George

George

George

George

время

честно говоря не понимаю разницу тогда, просто используй time для времени, или pv для скорости именно пайпа

Evgenii

Evgenii

честно говоря не понимаю разницу тогда, просто используй time для времени, или pv для скорости именно пайпа

разобрался почему time не работало. Freebsd

Fedor

Fedor

Alexandr

Alexandr

подскажите пожалуйста, после выравнивания версий ZFS на freebsd и linux можно ли просто так взять и пекинуть диск на линукс с фряхи?

George

George

подскажите пожалуйста, после выравнивания версий ZFS на freebsd и linux можно ли просто так взять и пекинуть диск на линукс с фряхи?

да и до не помню явных проблем, если features совпадали поддерживаемые, но это инфа из третьих рук

d

d

подскажите пожалуйста, после выравнивания версий ZFS на freebsd и linux можно ли просто так взять и пекинуть диск на линукс с фряхи?

оно заругается если что, пробовать можно безопасно, как мне кажется

Mikhail

Mikhail

разобрался почему time не работало. Freebsd

Добрый. Скорее не в bsd, а в конкретном шелле. Сам time делает то что ему шелл передаст. Надо просто добавить скобки на всю команду.

Andrew

Andrew

а подскажите, если я смотрю (freebsd) gstat и вижу, что физические диски (шпиндели, sata) заняты на 50%, а dataset в zfs на 100%, то что мне стОит сделать, чтобы "разогнать" систему, устранить узкое место в dataset?

дисков 15 — 3 zvol из raidz(5 дисков в каждом).

проц загружен где-то на 30-40% system и 15% на interrupts. два ядра.

вынести slog на ssd? проц поменять на более производительный?

что гуглить/почитать, чтобы понять почему это происходит?

Andrew

Andrew

iops на дисках от 120 до 170. interrupts до 20%.

%busy на дисках около 50%.

т.е. запас, вроде, есть.

Mikhail

Mikhail

Mikhail

Mikhail

iops на дисках от 120 до 170. interrupts до 20%.

%busy на дисках около 50%.

т.е. запас, вроде, есть.

Вообще средний диск - 150-180 потокол.

Andrew

Andrew

примерно равномерно.

tomb: ~# zpool iostat 5

capacity operations bandwidth

pool alloc free read write read write

---------- ----- ----- ----- ----- ----- -----

tomb 13.2T 14.0T 668 580 41.6M 29.2M

tomb 13.2T 14.0T 535 615 33.5M 32.1M

tomb 13.2T 14.0T 533 591 33.3M 32.1M

tomb 13.2T 14.0T 659 545 41.2M 29.9M

tomb 13.2T 14.0T 400 984 25.0M 56.4M

tomb 13.2T 14.0T 621 621 38.8M 31.5M

tomb 13.2T 14.0T 540 601 33.7M 32.1M

tomb 13.2T 14.0T 645 579 40.3M 32.1M

Mikhail

Mikhail

примерно равномерно.

tomb: ~# zpool iostat 5

capacity operations bandwidth

pool alloc free read write read write

---------- ----- ----- ----- ----- ----- -----

tomb 13.2T 14.0T 668 580 41.6M 29.2M

tomb 13.2T 14.0T 535 615 33.5M 32.1M

tomb 13.2T 14.0T 533 591 33.3M 32.1M

tomb 13.2T 14.0T 659 545 41.2M 29.9M

tomb 13.2T 14.0T 400 984 25.0M 56.4M

tomb 13.2T 14.0T 621 621 38.8M 31.5M

tomb 13.2T 14.0T 540 601 33.7M 32.1M

tomb 13.2T 14.0T 645 579 40.3M 32.1M

Добавление ssd для лога лишним не будет. Но не проще ли понять все на ssd? Эффект будет лучше.

Andrew

Andrew

Ну про пул с ssd понятно, что быстрее будет. Танцую от того, что есть. И ещё очень интересует теоретическая часть.

Владимир

Владимир

Всем привет!.

У меня есть NVME, на нём 2 раздела

первый раздел отдан как устройство кеша, а из второго сделан пул без избыточности.

Я хочу удалить устройство кеша, создать раздел под кеш меньшего размера, а не размеченное пространство закинуть в раздел из которого сделан второй пул без избыточности.

Мне не понятно как это сделать, причём раздел под кеш отдан первый раздел, то есть добавление рамера будет не привычным образом для меня в конец диска, а мне выходит надо перемещать начало.

Вообще возможна ли такая операция или проще пересоздать пул?\

Evgenii

Evgenii

Всем привет!.

У меня есть NVME, на нём 2 раздела

первый раздел отдан как устройство кеша, а из второго сделан пул без избыточности.

Я хочу удалить устройство кеша, создать раздел под кеш меньшего размера, а не размеченное пространство закинуть в раздел из которого сделан второй пул без избыточности.

Мне не понятно как это сделать, причём раздел под кеш отдан первый раздел, то есть добавление рамера будет не привычным образом для меня в конец диска, а мне выходит надо перемещать начало.

Вообще возможна ли такая операция или проще пересоздать пул?\

по моему, единственный вариант - добавить этот кусок в zfs пул в качестве отдельного диска

Владимир

Владимир

по моему, единственный вариант - добавить этот кусок в zfs пул в качестве отдельного диска

ну это самый простой вариант да, но мне не нравится что ZFS будет воспринимать его как отдельный vdev)

Evgenii

Evgenii

ну это самый простой вариант да, но мне не нравится что ZFS будет воспринимать его как отдельный vdev)

по другому никак, хоть байт переместишь, за который zfs отвечает - сломается

Evgenii

Evgenii

А добавление места спереди, будет фактически перемещением всех блоков устройства на N позиций, где N количество добавленных блоков

George

George

ну то есть такое вообще возможного, но проще пересоздать?

Возможно, но потребудет перемещения всего раздела (всех байт) к началу нового местоположения раздела. Вроде gparted такое умел, или руками очень аккуратно по смещениям ddшкой.

George

George

И проще пересоздать, ага. На будущее кеши в конце стоит создавать, а не в начале (в очередности разделов)

Владимир

Владимир

И проще пересоздать, ага. На будущее кеши в конце стоит создавать, а не в начале (в очередности разделов)

ну вот допустим я переместил, потом расширил, а дальше то чего, ZFS сам подхватит новый объём?

George

George

ну вот допустим я переместил, потом расширил, а дальше то чего, ZFS сам подхватит новый объём?

Autoexpand включить, если не подхватит, есть команда как его пнуть чтобы подхватил

Vladislav

Vladislav