George

George

Alexandr

Alexandr

Коллеги, подскажите пожалуйста, можно ли к сущесвующесу спешелу докинуть 2й диск чтобы он стал зеркалом 1го ?

Сергей

Сергей

Dima

Dima

Всем привет!

А напомните пжлст че делать, если в процессе resilver-a диска в raidz2 пуле вылетел и тот "новый" диск (FreeBSD если что), в итоге

NAME STATE READ WRITE CKSUM

disk8 DEGRADED 0 0 0

raidz2-0 DEGRADED 0 0 0

gpt/disk2_23 ONLINE 0 0 0

replacing-6 UNAVAIL 0 0 0

9357287876379815588 REMOVED 0 0 0 was /dev/gpt/disk2_24/old

5612102271103494021 REMOVED 0 0 0 was /dev/gpt/disk2_24

...

Fedor

Fedor

Dima

Dima

Точно нет. Просто диск б\у из старых был, не новый. Его просто контроллер выкинул, не смотрел че там он говорит - наверняка ему конец

Ivan

Ivan

Точно нет. Просто диск б\у из старых был, не новый. Его просто контроллер выкинул, не смотрел че там он говорит - наверняка ему конец

плохо что контроллер решает когда нужно извлечь диск

Dima

Dima

Это да. Это другая история. Диск я уже заменил, разметил. Вопрос тут сейчас в том, что сказать zpool , что бы он корректно убрал removed диск, и начал замену

Dima

Dima

Всем привет!

А напомните пжлст че делать, если в процессе resilver-a диска в raidz2 пуле вылетел и тот "новый" диск (FreeBSD если что), в итоге

NAME STATE READ WRITE CKSUM

disk8 DEGRADED 0 0 0

raidz2-0 DEGRADED 0 0 0

gpt/disk2_23 ONLINE 0 0 0

replacing-6 UNAVAIL 0 0 0

9357287876379815588 REMOVED 0 0 0 was /dev/gpt/disk2_24/old

5612102271103494021 REMOVED 0 0 0 was /dev/gpt/disk2_24

...

Отвечу себе же, может для истории. Так запустило ребилд заново:

zpool detach disk8 9357287876379815588

zpool replace disk8 gpt/disk2_24

Александр

Александр

Так получилось, что оба диска пула (зеркало) были сняты и увезены с выключенной машины без zpool export.

Александр

Александр

Теперь этот пул висит в списке, попытка его export завешивает машину через некоторое время - до ресета. destroy я еще не пробовал, но не ожидаю лучшего результата.

George

George

Александр

Александр

tarkhil@grandsql:~ % zpool status

pool: grandsql

state: ONLINE

status: Some supported features are not enabled on the pool. The pool can

still be used, but some features are unavailable.

action: Enable all features using 'zpool upgrade'. Once this is done,

the pool may no longer be accessible by software that does not support

the features. See zpool-features(7) for details.

scan: scrub repaired 0 in 0 days 00:20:55 with 0 errors on Tue Oct 6 03:24:00 2020

config:

NAME STATE READ WRITE CKSUM

grandsql ONLINE 0 0 0

mirror-0 ONLINE 0 0 0

gpt/grand1 ONLINE 0 0 0

gpt/grand0 ONLINE 0 0 0

errors: No known data errors

pool: insta

state: UNAVAIL

status: One or more devices could not be opened. There are insufficient

replicas for the pool to continue functioning.

action: Attach the missing device and online it using 'zpool online'.

see: http://illumos.org/msg/ZFS-8000-3C

scan: none requested

config:

NAME STATE READ WRITE CKSUM

insta UNAVAIL 0 0 0

mirror-0 UNAVAIL 0 0 0

10913095942752946567 UNAVAIL 0 0 0 was /dev/gpt/data0

3460244084970701044 UNAVAIL 0 0 0 was /dev/gpt/data1

Александр

Александр

я не так давно такой фантомный пул дропал через zpool destroy - учпешно

А вот попробую. Через полчаса, когда рабочий день закончится

Владимир

Владимир

Доброго дня. А могу ли я использовать 1 NVME накопитель для кешированиячтения записи определённых волюмов на ZFS(RAID1) пуле из двух HDD, и (я так догадываюсь что да) на сколько это хорошо или плохо? И можно ли подобное настроить прям с интерфейса проксмокса?

Олег

Олег

Доброго дня. А могу ли я использовать 1 NVME накопитель для кешированиячтения записи определённых волюмов на ZFS(RAID1) пуле из двух HDD, и (я так догадываюсь что да) на сколько это хорошо или плохо? И можно ли подобное настроить прям с интерфейса проксмокса?

Можно, с иньерыейса лучше вооюще ничего не делать

Сергей

Сергей

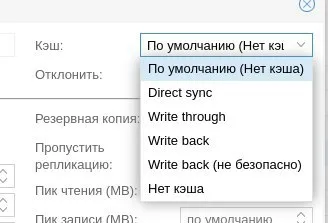

и после добавления NVME на кеш оно будет юзаться при включении кеша тут?

Нет. Для zfs кэширование записи имеет другой смысл. С помощью name можно ускорить fsync операции

Владимир

Владимир

Нет. Для zfs кэширование записи имеет другой смысл. С помощью name можно ускорить fsync операции

а можно по подробнее, а то для меня это выражение просто как набор буков пока)), сори за тупость)

Владимир

Владимир

какой вообще порядок действий если я хочу заюзать NVME на кеш для определённых VM, вернее будет сказать волюмов

Сергей

Сергей

а можно по подробнее, а то для меня это выражение просто как набор буков пока)), сори за тупость)

Начните отсюда:

https://habr.com/ru/post/504692/

https://habr.com/ru/post/423453/

Обращайте внимание на ZIL и SLOG, это то где можно применить ваш nvme

Владимир

Владимир

Спасибо, изучу сегодня. Меня вот ещё терзает мысль, NVME один, что будет когда он исчерпает ресурс), ничего не поломается?)) Про это есть в статье?

Владимир

Владимир

Современные пулы хранения могут пережить потерю кэша или журнала виртуального устройства — хотя они могут потерять небольшое количество грязных данных, если потеряют журнал vdev во время отключения питания или сбоя системы.

Владимир

Владимир

Начните отсюда:

https://habr.com/ru/post/504692/

https://habr.com/ru/post/423453/

Обращайте внимание на ZIL и SLOG, это то где можно применить ваш nvme

пока читаю первую статью, прям бомбически классно описывается, я многое уже знал, но не видел чтобы всё вот так в одном месте.

Алексей

Алексей

Владимир

Владимир

А как же мдадм?

Вы знатный троль, я как то писал тут что заюзал mdadm потому что для той задачи он реально подходил лучше и теперь Вы мне это будете напоминать?, я и сейчас повторю что для той задачи и с теми условиями мне лучше mdadm, у меня нет ZFS головного мозга и я не его религиозный фанатик чтобы юзать ZFS в уместных и не уместных местах.

Алексей

Алексей

Владимир

Владимир

а я вот читаю и такпонимаю о нём стоит думать)), у меня как раз наблюдается просадка в производительность на одном NVMe самсунге и походу оно как раз из-за него, а я не понимал в чём прикол

Сергей

Сергей

ashift - я так понимаю нельзя изменить? выставляется при добавлении vdev

При создании пула указывается.

Сергей

Сергей

Владимир

Владимир

При создании пула указывается.

в статье которую ты дал говорится что это ошибочное мнение), и оно указывается на vdev а не на пул

Владимир

Владимир

Свойство ashift устанавливается для каждого виртуального устройства vdev, а не для пула, как многие ошибочно думают — и не изменяется после установки.

Сергей

Сергей

в статье которую ты дал говорится что это ошибочное мнение), и оно указывается на vdev а не на пул

Я не настоящий 👨🏭 )

Владимир

Владимир

И сколько там ашифт?

12 если верно помню, но я пока занмаюсь другим проектом нет времени отвлекаться на тот

Владимир

Владимир

В реальном мире такой штраф бьёт по твёрдотельным накопителям Samsung EVO, для которых должен действовать ashift=13, но эти SSD врут о своём размере сектора, и поэтому по умолчанию устанавливается ashift=9. Если опытный системный администратор не изменит этот параметр, то этот SSD работает медленнее обычного магнитного HDD.

Владимир

Владимир

Начните отсюда:

https://habr.com/ru/post/504692/

https://habr.com/ru/post/423453/

Обращайте внимание на ZIL и SLOG, это то где можно применить ваш nvme

прочёл всё, крайне познавательно), такое надо прям в инфе о чате выкладывать)), или в закрепе))

Сергей

Сергей

прочёл всё, крайне познавательно), такое надо прям в инфе о чате выкладывать)), или в закрепе))

Там есть продолжение, но вроде его m1irko ещё не перевёл.

Владимир

Владимир

врде тоже годно

Я вот хочу в звол под контейнер вырубить кеширование в хелпе нашёл

zfs set --help

...

primarycache YES YES all | none | metadata

secondarycache YES YES all | none | metadata

...

Это выключаю и всё?

Олег

Олег

Там есть продолжение, но вроде его m1irko ещё не перевёл.

у меня продолжение с потерей таблицы разделов. Не зависит от кэша дисков, проявляется на Ubuntu 14

сделал снапшот, disk cache-none стоял - перезагрузка - потеря раздела, восстановление с снапшота-перезагрузка -все ок))) вот и думаю что за хрень))) Переделываюсь на 20Ubuntu

Ivan

Ivan

Владимир

Владимир

Есть #вопрос , а можете дать подходящий тест. Я хочу протестировать NVME на PCI с драйвером который поставился с проксмоксом и потом с драйвером с оф сайта. Можете подсказать как это будет сделать эффективнее? есть мнение что с драйвером с оф сайта задержки будет меньше, кеширование на звол который буду тестировать вырубил.

JIexa

JIexa