Mikhail

Mikhail

Заказал два таких:

https://www.dns-shop.ru/product/b0bf621ab9833330/960-gb-ssd-nakopitel-intel-d3-s4510-series-ssdsc2kb960g801/

уверен что вы в курсе, но на всякий случай

https://support.microsoft.com/en-us/help/4499612/intel-ssd-drives-unresponsive-after-1700-idle-hours

Nikolay

Nikolay

Mikhail

Mikhail

но ошибку вроде видели на всех дисках. беда в том что на этом сильно погорели, когда в один прекрасный день все ceph-ы сказали БУ. Там были и по терабайту и по 4

Dmitry

Dmitry

но ошибку вроде видели на всех дисках. беда в том что на этом сильно погорели, когда в один прекрасный день все ceph-ы сказали БУ. Там были и по терабайту и по 4

у ХП вроде такая же проблема была, не Интел ли им делал эти ССД?

Nikolay

Nikolay

ivdok

ivdok

> We recommend that you update to the latest firmware before the drive reaches 1,700 cumulative idle power-on hours.

Я помню, как HPE жарили за 32,768 часов MTBF, а тут рекорд

Mikhail

Mikhail

баг на xcv10100 у меня 10120 Отлегло от сердца :)

я могу ошибаться, но баг всё же железный, не в прошивке. В прошивке они сначала отключали сборщик мусора, который дедлочил, а потом вроде сделали какое-то ограничение. Я правда понимаю что во всех SSD есть свои костыли связанные с сборкой мусора, от этого никуда не убежишь. Но с другой стороны, диски уже обкатанные, везде используются, может быть даже не плохо на них подсесть )

Nikolay

Nikolay

я могу ошибаться, но баг всё же железный, не в прошивке. В прошивке они сначала отключали сборщик мусора, который дедлочил, а потом вроде сделали какое-то ограничение. Я правда понимаю что во всех SSD есть свои костыли связанные с сборкой мусора, от этого никуда не убежишь. Но с другой стороны, диски уже обкатанные, везде используются, может быть даже не плохо на них подсесть )

В той же статье написано что "This is a hardware issue" но так же что некоторые модели это не затрагивает -

Known hardware that is not affected: Hardware based on the Intel SSD D3-S4510 and Intel SSD D3-S4610 series drives in the 240 GB, 480 GB, and 960 GB capacities.

Mikhail

Mikhail

В той же статье написано что "This is a hardware issue" но так же что некоторые модели это не затрагивает -

Known hardware that is not affected: Hardware based on the Intel SSD D3-S4510 and Intel SSD D3-S4610 series drives in the 240 GB, 480 GB, and 960 GB capacities.

не, статье лучше не верить, ибо сам интел за март-май 2018 года менял позицию несколько раз.

George

George

а per zvol?

а в zfs2 планируется тротлить по dataset/zvol?

сейчас не видел активных проектов по троттлингу. Года 4 назад был PR, но заглох

tmf

tmf

сейчас не видел активных проектов по троттлингу. Года 4 назад был PR, но заглох

да, старые реквесты тоже видел, вроде там свелось всё к возможности реализации только через cgroups-v2, а пока что его не так много

ivdok

ivdok

https://habr.com/ru/post/523054/

Лютый баян. https://hackaday.com/2013/08/02/sprite_tm-ohm2013-talk-hacking-hard-drive-controller-chips/

ivdok

ivdok

в заголовке написан чей перевод

Ресь не про авторство, а про баян. Все, то хотел - много лет как перевели и прочитали

Roman

Roman

Привет. Может у кого есть опыт для следующей ситуации:

Имеется raidz2 на 12х8Тб хдд. Используется для хранения аудио в мп3. Файлы мелкие, 70% < 64 Кб. Сейчас их там уже ~400 000 000 (примерно на 3.5 Тб) и это я ещё не распаковал 15 Тб архивов таких же. Разбиты по директориям случайным образом, от 100 до 20 000 000 (это, что я точно видел), всего директорий 52600

Сжатие gzip включено (показывает 1.8), recordsize поставил 64, дедупликация (1.15), на всякий случай кэши на ссд (суммарно на 600 Гб)

Вопрос - насколько всё плохо, что ещё можно "подкрутить" (жалоб на производительность нет, всё отлично) или может это всё разобрать и перейти на S3 с цепхом?

George

George

George

George

George

George

В курсе

Гуд.

Если файлы сильно мелкие будут (4-8кб), то raidz накладные расходы по месту большие даст, тоже учтите

George

George

А так, если вам хватает перформанса с gzip сжатием и дедупликацией на raidz, то не думаю что стоит что-то трогать)

George

George

мне кажется на сколь-нибудь вменяемом наплыве посетителей всё встанет

Если озу не жалеть, то с прогретым арк всё ок

Ivan

Ivan

Если озу не жалеть, то с прогретым арк всё ок

это если все будут за примерно одним и тем же заходить. в таких вещах не стоит полагаться на кэш. он должен помогать, но так же ресурсов должно хватать на тот случай, если кэш справляться не будет.

George

George

Roman

Roman

ОЗУ не жалко и если нужно будет - докупим. Плюсом идут ссд в кэш, пока 600 Гб.

По нагрузке - сейчас на него сливается с 5 серваков по нфс непрерывно файлики в несколько потоков с каждого, никаких затупов на запись и отдачу

George

George

это если все будут за примерно одним и тем же заходить. в таких вещах не стоит полагаться на кэш. он должен помогать, но так же ресурсов должно хватать на тот случай, если кэш справляться не будет.

Статистика тут наше всё, всегда есть горячие и холодные данные, любую систему можно пробить на холодный кеш при желании

George

George

Ivan

Ivan

И умеет рано выходить на несжимаемых данных

А как это определяется ? Допустим recordsize 1m, половина несжимаемые данные, остальное 0, то нули подожмутся в итоге или нет ?

Roman

Roman

А как это определяется ? Допустим recordsize 1m, половина несжимаемые данные, остальное 0, то нули подожмутся в итоге или нет ?

Зфс понимает, что рекордсайз неполностью использован

George

George

А как это определяется ? Допустим recordsize 1m, половина несжимаемые данные, остальное 0, то нули подожмутся в итоге или нет ?

В нутра lz4 не лазил, не скажу как точно

Fedor

Fedor

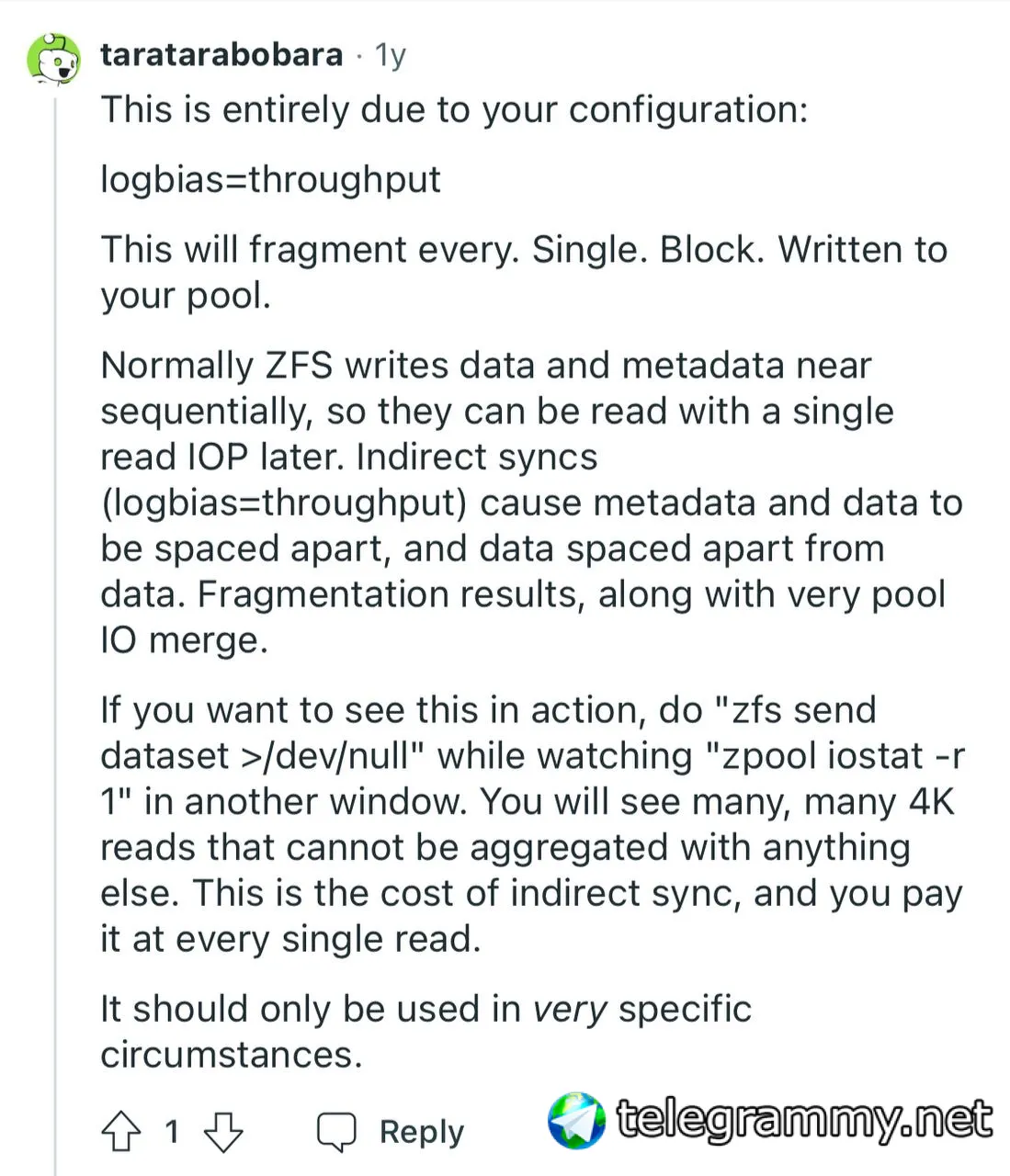

https://www.reddit.com/r/zfs/comments/ayqw1r/zfs_heavy_write_amplification_due_to_free_space/?utm_source=amp&utm_medium=&utm_content=comments_view_all

George

George

Понял :) если не летенси, хорошо б весь пул перезалить?)

Ну если нормально места держали свободного, то хватит переключить на латенси, если менять хочется

George

George

Кстати, префетч на зволах по этой же причине может работать неэффективно?

Со зволами отдельная песня обычно, на память не скажу даже

Vladislav

Vladislav

Алексей

Алексей