Сергей

Сергей

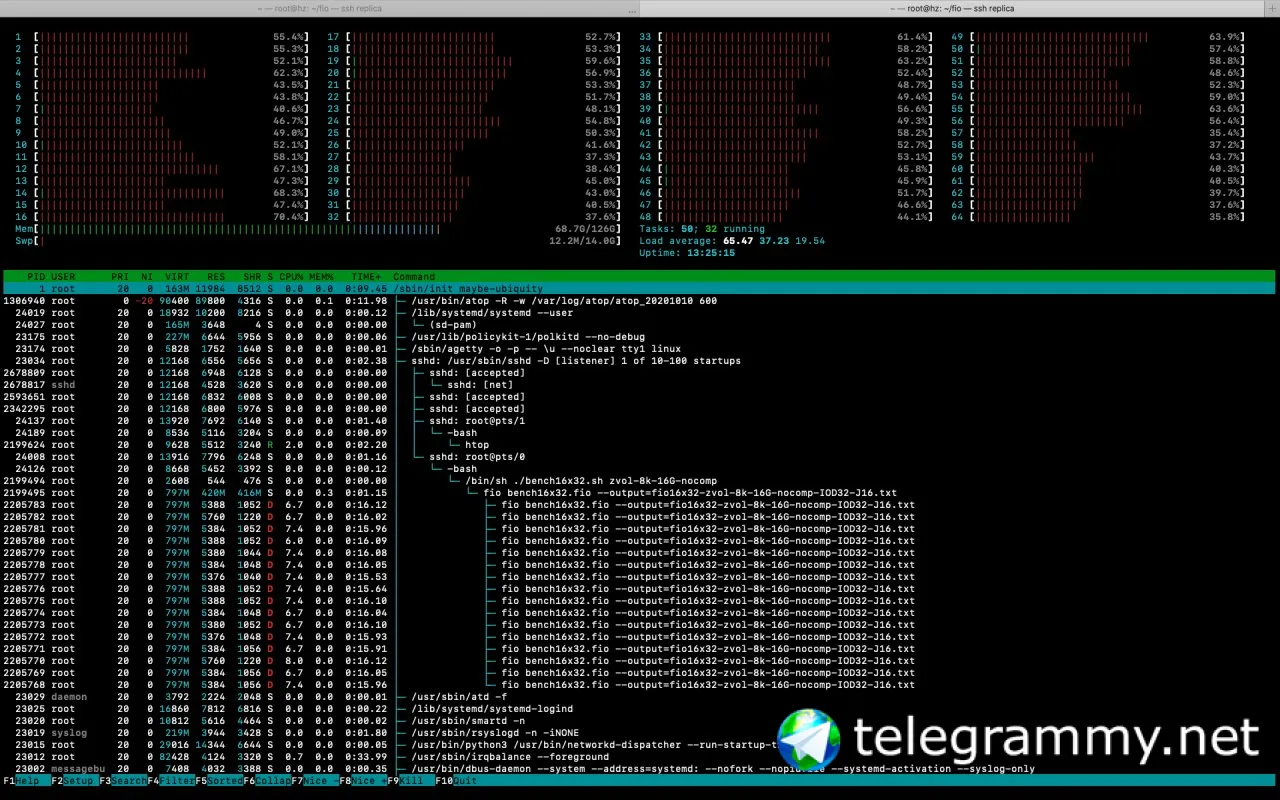

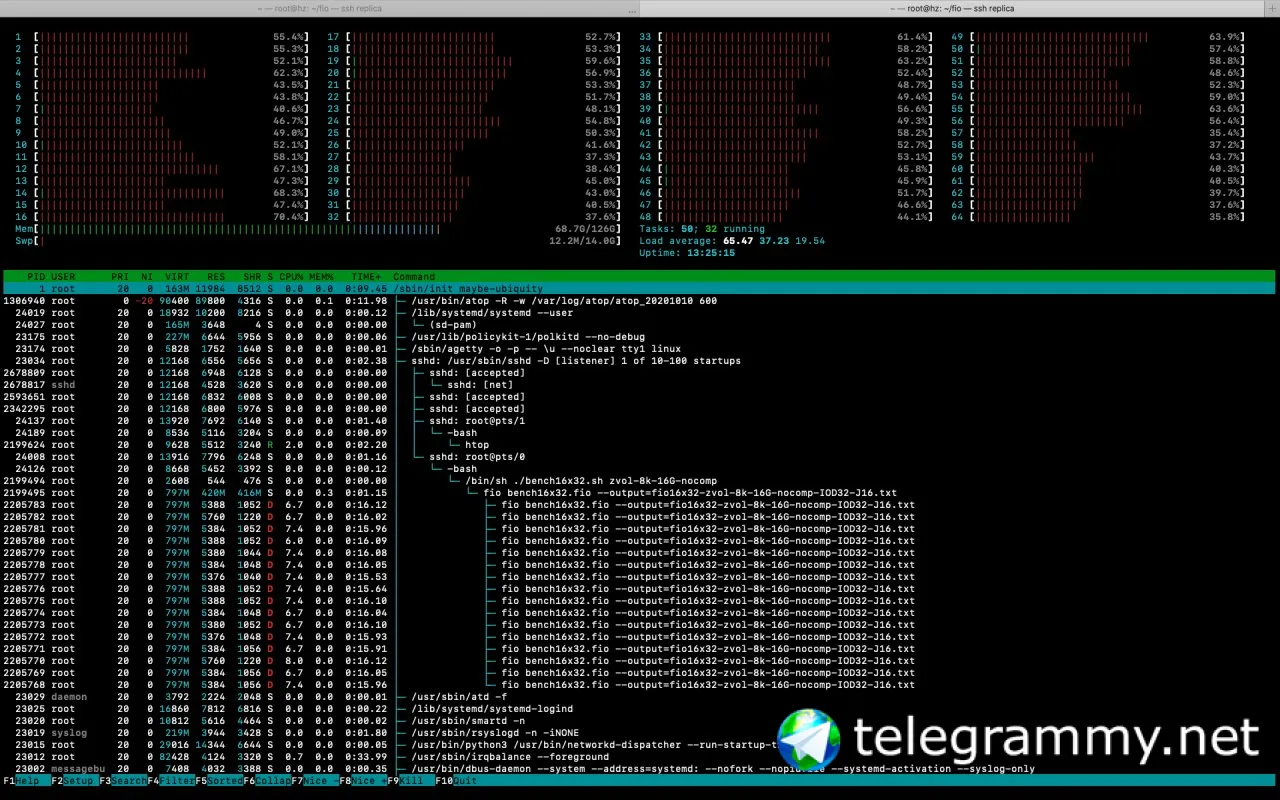

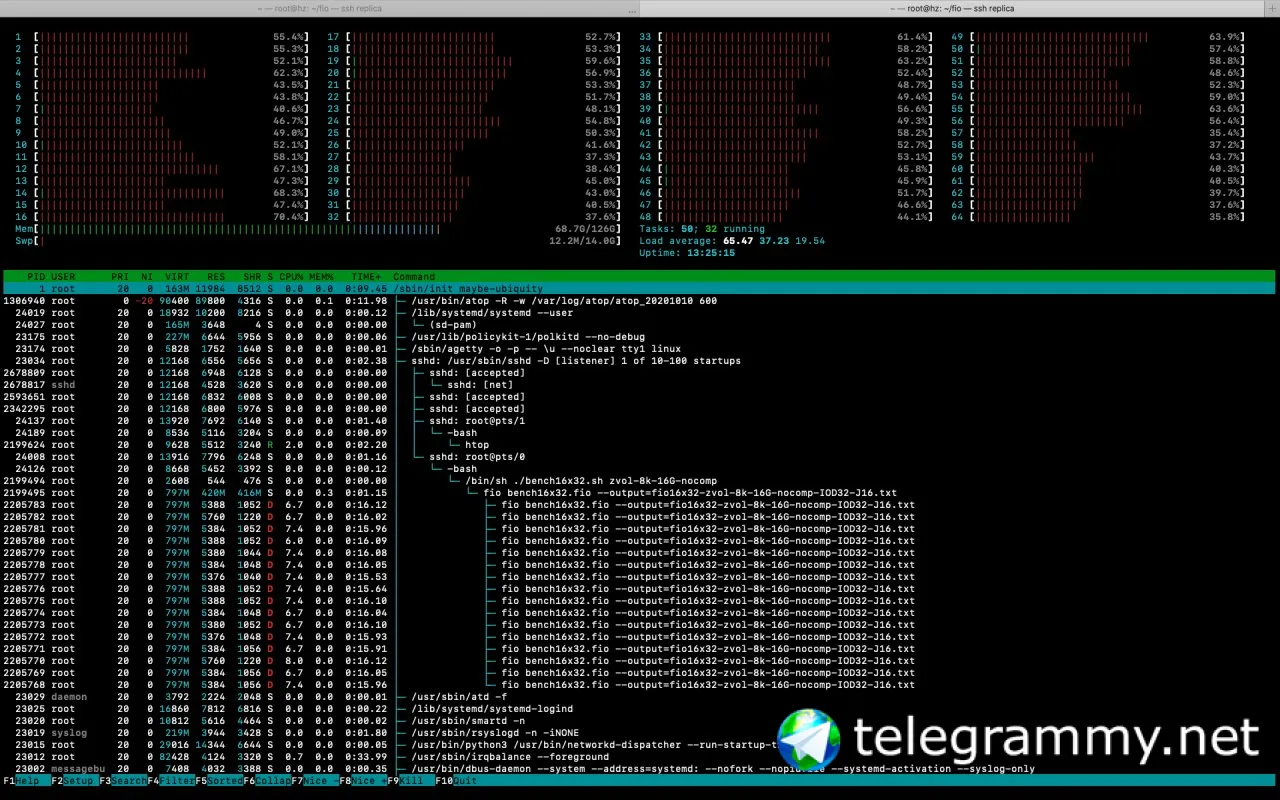

по окончанию теста:

root@hz:~/fio# arcstat

time read miss miss% dmis dm% pmis pm% mmis mm% arcsz c

12:35:23 0 0 0 0 0 0 0 0 0 60G 62G

результаты во вложении. Добавил ещё randread (первым тестом).

Igor

Igor

Alexander

Alexander

Ivan

Ivan

вот на всякий случай тесты на заполненном пуле.

Ivan

Ivan

интересный результат получился после отключения гипертрейдинга. на небольшой нагрузке производительность ухудшилась, а на тяжелой нагрузке улучшилась.

Ivan

Ivan

похоже помогает общий ядерный кэш при включенном ht, когда не нужен fsync.

Ivan

Ivan

наверно с включенными опциями безопасности ht покажет намного более слабые результаты, нежели без ht.

Roman

Roman

Alexandr

Alexandr

@neurox

Fedor

Fedor

Очень интересный вопрос, наверное, к @gmelikov

Возможно ли как-нибудь преобразовать звол в файл? :D

George

George

Evgenii

Evgenii

Dmitry

Dmitry

Fedor

Fedor

Dmitry

Dmitry

Его можно даже на веб сервер выложить и курлом лить прямо в приемник через recv

George

George

Fedor

Fedor

наподобие, да.

Fedor

Fedor

Но чтоб все данные не перекачивать :)

George

George

George

George

Или сразу в файликах храни

George

George

По перфомансу примерно пофиг

George

George

Ivan

Ivan

а что для улучшения однопотока покрутить можно ?

вот всё хорошо с многопотоком, а бывают в бд однопоточные операции, хотелось бы их ускорить.

Ivan

Ivan

George

George

есть слог. а однопоток около 100мб/с

ну так какой однопоток, какие диски под slog. Ну и сейчас 100% от raw скорости ждать не стоит, если хороший nvme, там есть что ускорять в коде

Ivan

Ivan

Ivan

Ivan

через zpool iostat на slog иногда видно запись до 400МБ/с, но это исключительно на большом количестве потоков.

Ivan

Ivan

Ivan

Ivan

там уже много было всего позаписано

Ivan

Ivan

так в тестах от Сергея rw

Ivan

Ivan

а мне хотяб что-то одно

George

George

Чтобы понимать накладные расходы фс, надо тем же профилем сам диск погонять, я про это

Ivan

Ivan

Ivan

Ivan

если про тот же тест говорить, то совсем печалька

George

George

George

George

Берёте fio, нужный вам конфиг и сам диск тестите (затрёт данные на нём, конечно же)

George

George

Получаете сырые цифры а сколько же железо даёт

George

George

И только с этими данными можно увидеть, сколько съедает zfs, и есть ли вообще место его тюнингу

George

George

А то ссд и нвме имеют свойство после например 100гб нагрузки резко становиться хуже

George

George

щупал я нвме, 3гбайт/сек пока он вообще пустой, записал хотябы 100гб - привет x4 просадка, кеши кончились/etc

Ivan

Ivan

например тестирую после ребута сначала zvol, потом раздел на ссд

Ivan

Ivan

Ivan

Ivan

это результат с полностью дефолтными настройками

George

George

Ivan

Ivan

на ссд лежит special,slog,swap и еще вот раздел для тестирования fio создал

Ivan

Ivan

пул - raid10 на 36 hdd (+ special + slog на этом ssd)

George

George

Судя по выводу, тут параллельно идёт синхронное чтение, на пулах с hdd оно съест сильно иопсы. Randrw ждёт чтение, slog не прогрузится

Ivan

Ivan

так мне поменять методу тестирования ?

в любом разе и чтение и rw и рандом и полследовательное оочень плохо себя показывают на zvol в однопотоке

George

George

George

George

А так да, кейс "прочитать блок (синхронно) и записать блок (синхронно)" на вашем пуле из hdd и слога на ссд будет упираться в хдд при пустом arc

George

George

Что логично

George

George

George

George

Бд по факту сильно параллелятся внутри, плюс обычно есть wal

Ivan

Ivan

Ivan

Ivan

вот таким скриптиком затетсировал

Ivan

Ivan

увы, на zvol в однопотоке производительность печальная по всем фронтам

Nikolay

Nikolay

это без slog ?

Ivan

Ivan

Nikolay

Nikolay

откуда они лезут

Fedor

Fedor

Это ещё в листинг каналов чат не был добавлен :)

Nikolay

Nikolay

в дискорде недавно в канале по js набежала толпа ботов и давай вличку спамить подобной хренью )

Fedor

Fedor

дискорд это же чатик для геймеров, не? :)

Nikolay

Nikolay

И для этого тоже ) на самом деле очень удобная вещь

Владимир

Владимир

Всем привет. В вмваре было вставлено 4 диска, на каждом из них по файлу образа которые прокинуты в виртуалку на вмваре из них был сборан RAIDZ1 и один диск начал поминрать. Вот такая у меня стартовая инфа, мне предоставлили эти диски по одному я снял с каждого дамб, превратил в блочное устройство, а раздел блочного утсройства примонтировал. Теперь у меян есть доступ к образам. Подскажите как мне теперь собрать обратно RAIDZ1?

George

George

Владимир

Владимир

ну расширение у них vmdk

George

George

по идее просто zpool import сделать, указав через -d на файлы с сырой инфой из этих образов

Сергей

Сергей

Сергей

Сергей

Igor

Igor

Alexander

Alexander

Сергей

Сергей

Ivan

Ivan

Ivan

Ivan

Roman

Roman

Fedor

Fedor

George

George

Evgenii

Evgenii

Dmitry

Dmitry

George

George

Ivan

Ivan

George

George

Ivan

Ivan

George

George

Ivan

Ivan

George

George

Ivan

Ivan

Ivan

Ivan

George

George

Ivan

Ivan

Ivan

Ivan

George

George

George

George

George

George

Ivan

Ivan

George

George

George

George

George

George

Ivan

Ivan

George

George

George

George

George

George

George

George

Ivan

Ivan

Nikolay

Nikolay

Владимир

Владимир

George

George