кстати, а зачем ироник ваще? почему не маас и потом раскатать все каким-то ансиблом паппетом?

Да потому что ансибли и паппеты медленные, а маас в сравнении с айроником ущербный. Эт ты раскатаешь ОС, а потом 180 хостов полезут в интернеты обновляться) Или к папет мастеру за инструкциями)

Или ансибль неделю будет скрипеть плейбуками с какого-нить деплой сервера)

✠ FLASh ✠

✠ FLASh ✠

не, наоборот, у меня голый баре метал будет 180 шт, вообще без всего, я на паре митапов слыхал, что ироник может к ipmi подрубаться, и настраивать операционку и тд.

То есть задача не опенстэк по сути даже размернуть, а именно автоматизировать развёртывание. Типа серваки есть, я на ноуте роник запустил он сам в сетке всё нашёл, в зависимости от конфига сервера применил настройки, а я уже далее ансиблом поставил софт и тд

Ироник может по ипми работать с бареметалом - да, но с сетками проблема будет и остальное надо будет настраивать ансиблом руками крюками

J

J

не, наоборот, у меня голый баре метал будет 180 шт, вообще без всего, я на паре митапов слыхал, что ироник может к ipmi подрубаться, и настраивать операционку и тд.

То есть задача не опенстэк по сути даже размернуть, а именно автоматизировать развёртывание. Типа серваки есть, я на ноуте роник запустил он сам в сетке всё нашёл, в зависимости от конфига сервера применил настройки, а я уже далее ансиблом поставил софт и тд

Ironic тебе все равно придется на отдельном сервере раскатывать и не на одном, в ощем то, скорее всего. Но мыслишь в нормальном направлении.

✠ FLASh ✠

✠ FLASh ✠

Да потому что ансибли и паппеты медленные, а маас в сравнении с айроником ущербный. Эт ты раскатаешь ОС, а потом 180 хостов полезут в интернеты обновляться) Или к папет мастеру за инструкциями)

Или ансибль неделю будет скрипеть плейбуками с какого-нить деплой сервера)

ну как сказать медленные) если провижн в айронике зафейлился, то репровижн занимает дохуилиард времени тоже. Это долгая басня капец.

Старый

Старый

Ironic норм будет катать любые образы)

Сообственно, самую сложность вижу в настройке сети. Насколько там все сложно будет, @erzentd?

там будет bgp+evpn+vxlan, 180 железок, 6 конфигураций, сетка 3 типов, это 4 интерфейса по 10г+ 2 инетрфейса 1г для менеджента(1 ipmi +1 инет), вторые серваки будут иметь 2 интерфейса по 40г, и ещё 1 типа будет иметь 2 по 100г

J

J

там будет bgp+evpn+vxlan, 180 железок, 6 конфигураций, сетка 3 типов, это 4 интерфейса по 10г+ 2 инетрфейса 1г для менеджента(1 ipmi +1 инет), вторые серваки будут иметь 2 интерфейса по 40г, и ещё 1 типа будет иметь 2 по 100г

Ну вот смари. evpn он тебе сам не настроит. Для evpn и BGP тебе надо либо вместе с метаданными конфиги для них отдавать либо уже после деплоя ОС настраивать внешним средством типа ансибля, да

✠ FLASh ✠

✠ FLASh ✠

Я б забил на айроник и взял что-то что просто раскатает мне по ипми быстренько образы. Остальное конфигурить через ансибл.

Старый

Старый

J

J

конфиг придёт по dhcp после настройки бондов

Конфиг BGP и EVPN?

Я про это. Базовые насройки бондов, ip адресов и прочего можно и через cloud-init\glean сделать.

Михаил

Михаил

Это у тебя Juju бандла нормального не было, вот и бесишься.

какая разница для чего писать yaml?!

J

J

я не троллю, если ты не заметил

Пока хз что тебе рассказать)

Мне конкретные вопросы задавай какие-нибудь)

Старый

Старый

А, ну тогда фигня делов.

Все чо надо эт чтобы бонды настраивались.

просто документация очень обьёмная, непонятно с чего начинать, почти везде управление вм, управление образами, управление гипервизорами.

А мне в 1 рожу надо будет сделать всё, от freeipa с базами, до развёртывания

J

J

просто документация очень обьёмная, непонятно с чего начинать, почти везде управление вм, управление образами, управление гипервизорами.

А мне в 1 рожу надо будет сделать всё, от freeipa с базами, до развёртывания

Начни с установки одного голого Ironic вообще без остальных сервисов.

Либо через bifrost:

https://docs.openstack.org/bifrost/latest/

Либо вручную:

https://docs.openstack.org/ironic/latest/install/install.html

Ну и вот документация как использовать его в отдельностоящем режиме.

https://docs.openstack.org/ironic/latest/install/standalone.html

Но она странноватая, поэтому на нее не полагайся полностью. Ну а как ironic поставшь и немного с ним повозишься вручную, там можно прикрутить уже и еще кой-чо.

J

J

Играться можно с виртуалками. У Ironic есть драйверы и интерфейсы для взаимодействия с виртуалбоксом и libvirt вместо реальных IPMI, iLo и прочей чепухи.

J

J

@erzentd, ну и погляди статьи StackHPC по использованию опенстековских сервисов для управления голым железом. Там у них много сложного наверчено, но статьи дают представление куда смотреть и что вообще можно делать на голом железе с опенстеком.

Вот, к примеру.

https://www.stackhpc.com/ironic-idrac-ztp.html

Старый

Старый

@erzentd, ну и погляди статьи StackHPC по использованию опенстековских сервисов для управления голым железом. Там у них много сложного наверчено, но статьи дают представление куда смотреть и что вообще можно делать на голом железе с опенстеком.

Вот, к примеру.

https://www.stackhpc.com/ironic-idrac-ztp.html

спасибо, просто глаза разбегаются, очень много инфы, а попутно ещё сверху базы на пб

Inna

Inna

Всем привет, подскажите идеи или может кто-то сталкивался с таким:

вольюм был удален

openstack volume show не находит его

в бд cinder запись о нем как о удаленном

gnocchi resource show показывает дату в поле ended_at.

Но метрики продолжают приходить. Какой из сервисов ceilometer собирает метрики дисков и где он их берет? Pike, бэкенд ceph

оказалось, в cinder.conf параметр по умолчанию volume_usage_audit_period = month, а в кроне задание, собирающее метрики, было без указания start-time и end-time, поменяла его с

/usr/bin/cinder-volume-usage-audit --send_actions

на

/usr/bin/cinder-volume-usage-audit --start_time="`/usr/bin/date "+\%Y-\%m-\%d \%H:\%M:\%S" -d "-5min"`" --end_time="`/usr/bin/date "+\%Y-\%m-\%d \%H:\%M:\%S"`" --send_actions -d 1>> /var/log/cinder/cinder-volume-usage-audit.log

или можно было задать volume_usage_audit_period = hour, час минимальное значение

Alex

Alex

Всем ку, народ подскажите плз, как/где посмотреть на каких конкретно лунах расположены вольюмы из тенанта ?

J

J

Всем ку, народ подскажите плз, как/где посмотреть на каких конкретно лунах расположены вольюмы из тенанта ?

От бекэнда зависит, думаю.

✠ FLASh ✠

✠ FLASh ✠

но можно посмотреть куда все складываться будет в cinder.conf и в openstack volume show <volume-id>

Vladimir Kuznetsov

Vladimir Kuznetsov

Anton

Anton

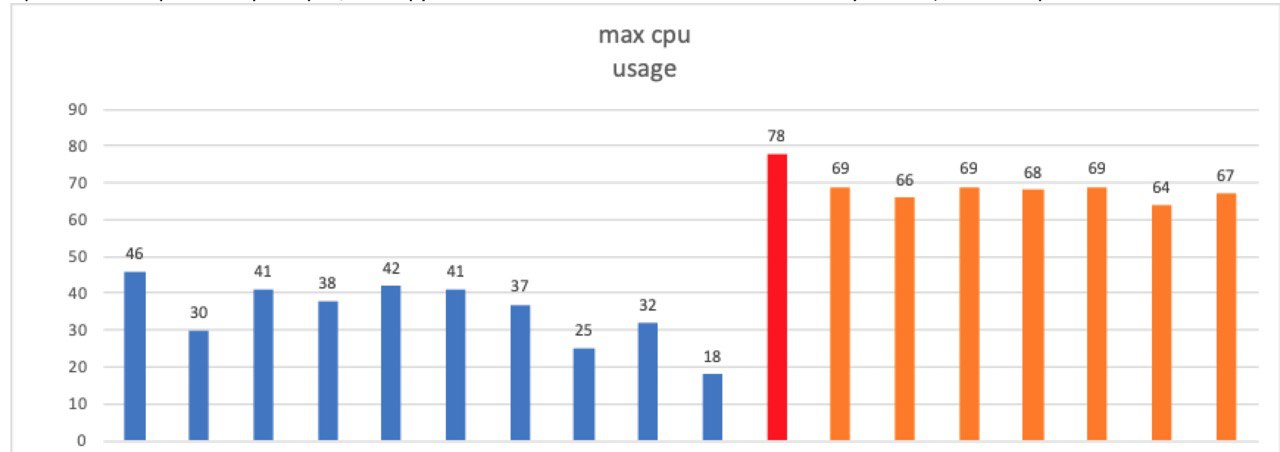

при утилизации гиперов ( данные с заббикса и ovirt консоли ) максимальная утилизация была ~70%

J

J

J

J

2.27 – текущий коэфициент переподписки на kvm ( 2034 vcpu/ 896 cpu )

Это как так ты считаешь?

Ты смотри по конкретным гипервизорам.

Anton

Anton

Это как так ты считаешь?

Ты смотри по конкретным гипервизорам.

по всему кластеру посчитал кол-во CPU и кол-во vCPU на машинах

Sergey

Sergey

да

Можете отключить на лету - либо через sysctl опцию, если ядро свежее, либо по простому циклом:

echo 0 > /sys/devices/system/cpu/cpu${i}/online;

Или сделать по другому - перепривязать cpu affinity для qemu процессов только на реальные ядра (только numad отключите, если используете)

taskset -acp 0-6 ${qemu_pid}

После этого - посмотрите на результат, если понравится, то включайте на постоянку 😊

J

J

не по серверно, а со всего кластера

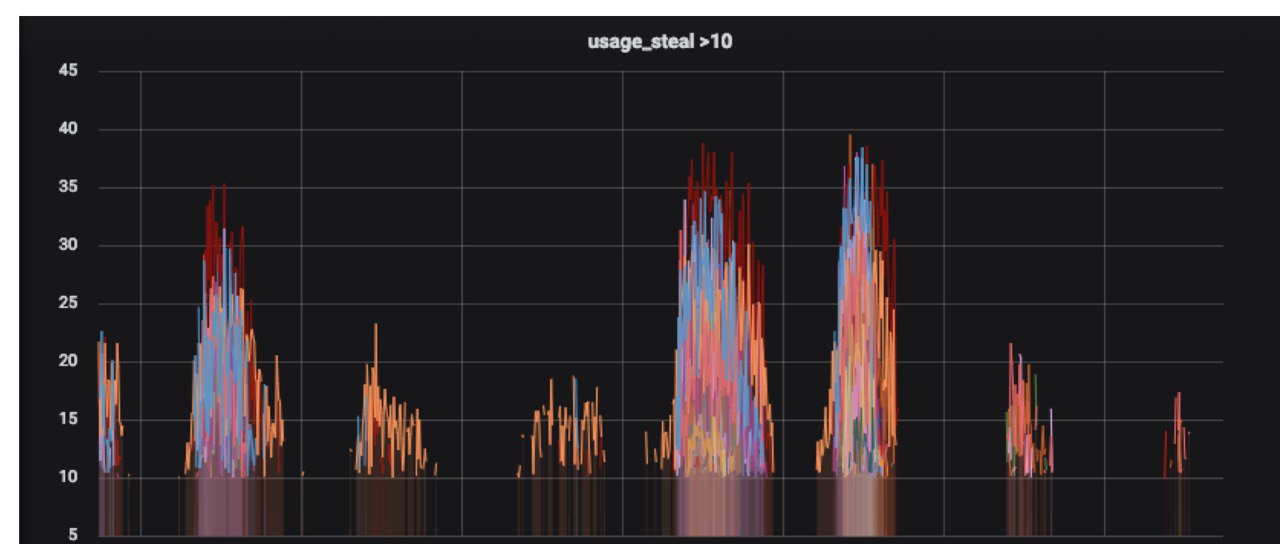

steal time и другие метрики процессора со всего кластера это ж как средняя темпеатура по больнице)

Нужно тебе найти на каких гипервизрах и каких конкретно виртуалках дела обстоят безобразнее всего.

J

J

Кстати, idle и iowait на хостовых системах погляди заодно, так можно будет понять дело в том что процессора не хватает или в том что все в io упирается.

Mikhail

Mikhail

@ddpechkin , @nwton_ru , привет. а чем гипертрединг то может так сильно влиять на гипервизор?

Sergey

Sergey

пример "на пальцах":

хост с 2 реальными ядрами и ещё 2 гипертрейдинговых, всего 4 ядра, выполняется 2 виртуалки (по 1 ядру в полку, можете md5 для /dev/zero например посчитать в один поток)

1) если процессы qemu выполняются каждый на своём физическом ядре, то всё хорошо, на хосте top покажет 50% загруженность по cpu, в виртуалках тоже всё хорошо

2) если процессы qemu попытаются выполниться на sibling ядрах - принадлежат одному физическому, реальный и виртуальный гипертрейдинговый, то на хосте всё останется по прежнему 50% загрузка, а внутри виртуалок появится steal time

сделайте тест - запустите пару виртуалок, посмотрите вывод lscpu на хосте про вашу систему и реальные ядра и попробуйте назначить через taskset привязку cpu affinity на разные физические ядра, а затем на сиблинговые, поймёте сразу.

Aleksandr

Aleksandr

@ddpechkin , @nwton_ru , привет. а чем гипертрединг то может так сильно влиять на гипервизор?

на всех системах работающих с большим колвом прерываний / высоким И/О советуют не только отключать HT но и строить такие системы на одном ЦПУ. Про C-states я вообще молчу

Mikhail

Mikhail

пример "на пальцах":

хост с 2 реальными ядрами и ещё 2 гипертрейдинговых, всего 4 ядра, выполняется 2 виртуалки (по 1 ядру в полку, можете md5 для /dev/zero например посчитать в один поток)

1) если процессы qemu выполняются каждый на своём физическом ядре, то всё хорошо, на хосте top покажет 50% загруженность по cpu, в виртуалках тоже всё хорошо

2) если процессы qemu попытаются выполниться на sibling ядрах - принадлежат одному физическому, реальный и виртуальный гипертрейдинговый, то на хосте всё останется по прежнему 50% загрузка, а внутри виртуалок появится steal time

сделайте тест - запустите пару виртуалок, посмотрите вывод lscpu на хосте про вашу систему и реальные ядра и попробуйте назначить через taskset привязку cpu affinity на разные физические ядра, а затем на сиблинговые, поймёте сразу.

понятно. для закрепления - планировщик задач в linux-е разве не пытается исключать sibling-и? я не готов спорить, но недавно наблюдал картину на двухсокетной системе по 20 ядер что логические ядра от 0 до 19 и от 40 до 59 были заняты на 80%, а остальные на 20%.

Mikhail

Mikhail

на всех системах работающих с большим колвом прерываний / высоким И/О советуют не только отключать HT но и строить такие системы на одном ЦПУ. Про C-states я вообще молчу

ам... а как же affinity прерываний и всё такое? c C0 вроде вопросов нет :)

Sergey

Sergey

Asgoret

Asgoret

Vladimir

Vladimir

NS 🇷🇺

NS 🇷🇺

Dmitry

Dmitry