спасибо

Но, кстати, интересный косяк.

Спасибо что принес.

Danila

Danila

Если кратко, то после краша не хватает прав в пуле сефа на блеклист клиента. Их почему-то нет, скорее связанно с апгрейдом сефа.

Да. ceph auth caps client.nova-compute mon 'allow r, allow command "osd blacklist"' osd 'allow rwx' - решило проблему. Проверил на 10 вм и на двух гиперах, с жетским отключением элва.

После включения вм - все в работоспособность состоянии.

Danila

Danila

проврьте ceph логи qemu клиентов после этого на предмет ошибок типа access denied

Первым делом полез ) Все ок.

Dmitry

Dmitry

Коллеги, доброй ночи.

Версия - Ocata - никто не сталкивался с тем, что при unshelve виртуалки скедулер ведет себя странно и при расчетах прибавляет requested значения (обратил внимание только на free_ram и instances) в host_state и начинает capabilities хостов считать уже с новыми значениями? 🙂

Andrey

Andrey

Нет. Но чем-то проблема напоминает скедулинг в ~icehouce, который не учитывает уже занимаемые виртуалкой ресурсы (заметно при одном доступном компуте).

UserHost

UserHost

Ребята, вопрос про designate dns, какие он дает преимущества от встроенного модуля openstack?

PTR record можно прописать без designate?

Inna

Inna

Ребята, вопрос про designate dns, какие он дает преимущества от встроенного модуля openstack?

PTR record можно прописать без designate?

Позволяет пользователям рулить своими зонами и птр, в горизонте например есть нормальный плагин

Dmitry

Dmitry

Victor

Victor

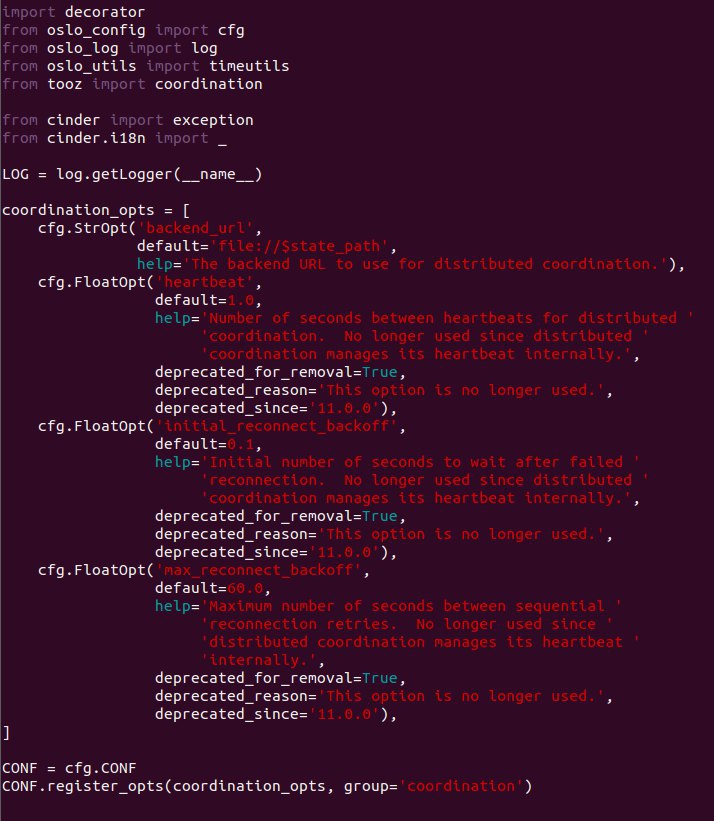

коллеги, подскажите, а есть ли у кого-то опыт\знания про cinder volume HA? теги что-то вроде tooz, zookeeper.. просто сколько не гуглю, складывается впечатление, что это все еще в разработке. блюпринты есть давным давно, тонна наработок тоже есть, а законченного, или как минимум, описанного решения найти не могу

J

J

коллеги, подскажите, а есть ли у кого-то опыт\знания про cinder volume HA? теги что-то вроде tooz, zookeeper.. просто сколько не гуглю, складывается впечатление, что это все еще в разработке. блюпринты есть давным давно, тонна наработок тоже есть, а законченного, или как минимум, описанного решения найти не могу

ну его и нету, вроде.

Можно поэкспериментировать поставив для Tooz бекэндом zookeeper, но я тоже не оч понимаю чо как)

Примеров на этот счет нет.

J

J

коллеги, подскажите, а есть ли у кого-то опыт\знания про cinder volume HA? теги что-то вроде tooz, zookeeper.. просто сколько не гуглю, складывается впечатление, что это все еще в разработке. блюпринты есть давным давно, тонна наработок тоже есть, а законченного, или как минимум, описанного решения найти не могу

Но должно быть не очень сложно)

Вот глянь.

https://docs.openstack.org/tooz/latest/user/drivers.html

J

J

как раз вопрос как синдер с tooz'ом сдружить 🙂

А он же, как я понимаю, и так уже ипользуется, но с лок файлами в качестве бекэнда.

J

J

ага, понял, спсаибо! буду тестить

Расскажи потом обязательно. Или вместе чо-нить глянуть можно.

Я все хотел поковыряться, но то лень то другие дела)

Victor

Victor

Расскажи потом обязательно. Или вместе чо-нить глянуть можно.

Я все хотел поковыряться, но то лень то другие дела)

ага, у меня эта задачка тоже уже полгода висит 🙂 но всё же надо

UserHost

UserHost

Позволяет пользователям рулить своими зонами и птр, в горизонте например есть нормальный плагин

А без него не получается управлять днс записями, without designate zone?

Просто возник вопрос ,зачем он нужен если без него и так получается прописать ptr record, srv records

J

J

J

J

Да, верно

Ну эт то же самое что xml конфиги в либвирте писать руками и ovs порты настраивать.

C designate у тебя и удобный веб интерфейс и cli есть чтобы записи добавлять, к тому же, A и PTR записи автоматом для neutron портов можно прописывать.

J

J

Это в первую очередь не для операторов openstack, а для пользователей в проектах.

Завел ты, скажем, подразделению какому-то проект, вот пусть они сами и прописывают себе записи и чо хотят делают. А тебя уже дергать не будут)

UserHost

UserHost

Ну эт то же самое что xml конфиги в либвирте писать руками и ovs порты настраивать.

C designate у тебя и удобный веб интерфейс и cli есть чтобы записи добавлять, к тому же, A и PTR записи автоматом для neutron портов можно прописывать.

И по фунциональности тоже все поддерживает, что и ручками пишем?! Благодарю за разъяснения, попробую понять где его применить. Поскольку начальство просит изучить и внедрить))

Жаль нет подробного списка сравнения,некий comparison chart как у вендоров сетевого оборудования

J

J

Ох, посоны, чо-то не пойму куда смотреть)

nova-api через раз возвращает на service list то нормальный список, то список где сервисы продублированы по два раза, с одними и теми ж id и uuid.

J

J

--debug не помогает?

Вип не переезжает между операциями (отвечает один и тот же nova-api)?

Ага.

Я вырубил на haproxy все остальные.

J

J

Кароч, дело, позоже, в том что я случайно добавил четвертый кролик в инфраструктуру при последнем расширении.

И вот какаое дело, убираю его из конфигов nova-api-os-compute и норм.

J

J

Подробнее ща уже не расскажу, ибо контейнер тот удалил.

Если кто-то пояснит почему так, будет круто.

Denis

Denis

Привет 👋! Подскажите пожалуйста, как расчитать итоговую емкость ceph-a? Не могу что-то нагуглить. На storage-ноде хочется поставить 12*8 ТБ

Andrey

Andrey

Выглядит полезно, спасибо)

Я сам себе хочу принести, бизнес требует, но перед тем как углубляться в тесты хотелось бы услышать истории о использовании от реальных людей. Насколько я вижу проект всё еще обособлен от нейтрона, и это меня сильно напрягает

Dmitry

Dmitry

Я сам себе хочу принести, бизнес требует, но перед тем как углубляться в тесты хотелось бы услышать истории о использовании от реальных людей. Насколько я вижу проект всё еще обособлен от нейтрона, и это меня сильно напрягает

Может быть интеграция с нейтроном совсем похоронит проект ;)

Dmitry

Dmitry

Чего й то?

Боюсь представить, как он синтегрируется в эту махину по имени нейтрон :) как все это будет трэкаться, синкаться...

J

J

Боюсь представить, как он синтегрируется в эту махину по имени нейтрон :) как все это будет трэкаться, синкаться...

Да а чо там делать то?

С ovs нормально будет работать точно.

J

J

Привет 👋! Подскажите пожалуйста, как расчитать итоговую емкость ceph-a? Не могу что-то нагуглить. На storage-ноде хочется поставить 12*8 ТБ

Ты поясни)

Хочешь цеф всего на одном сервере делать?

J

J

На трех 😊

Вот у тебя три сервера, в каждом 12 * 8 Тб?

Сразу вот чо скажу, 8Тб диски это уже плохая идея.

J

J

А если поставить 2"400 гиг ссд нвме кеш?

Ну все равно, конечно, нежелательно, но если у тебя уже есть те диски, то, конечно, хороший вариант. Но только если делать bcache, без цефовского cache tier и без модных рейдовых наворотов.

J

J

Итоговая емкость в твоем случае будет 12*3*8 = 288Тб

А там уже все зависит от того какие пулы и как будешь создавать. В классическом случае - с трехкратной репликацией просто дели на три.

Если будешь использовать erasure coding, там будет зависеть от соотношения полезных данных к EC кодам.

Denis

Denis

Итоговая емкость в твоем случае будет 12*3*8 = 288Тб

А там уже все зависит от того какие пулы и как будешь создавать. В классическом случае - с трехкратной репликацией просто дели на три.

Если будешь использовать erasure coding, там будет зависеть от соотношения полезных данных к EC кодам.

Резервирование нужно конечно. Рэйд0 не привлекает 😊 А какая степень EC имеет смысл?

J

J

Резервирование нужно конечно. Рэйд0 не привлекает 😊 А какая степень EC имеет смысл?

Ну там по-простому считается.

Берешь два числа. Первое - количество кусков на который будет резаться объект при записи, второе - количество кодовых кусков. И вот их то количество это, считай, количество дисков которые можно потерять без потери данных.

J

J

В примере выше избыточность будет 41,7 процента где-т) Количество кусков с данными делишь на общее количество кусков, и кодовых и с данными. То есть 7/12.

ну и так далее.

J

J

Так что, щас не заморачивайся, мне кажется, предварительными расчетами полезной емкости. По ходу разберешься и подберешь оптимальную схему хранения. Тем более, всего три сервера.

Pavel

Pavel

Yuf

Yuf

NS 🇷🇺

NS 🇷🇺

Михаил

Михаил