Alexey

Alexey

Хрень потому что шардинг , я не зря спросил как он внутри хранит. Хрень потому что что индексы в сиквеле. Хрень потому не прометеус, там все это по человечески решено

J

J

Хрень потому что шардинг , я не зря спросил как он внутри хранит. Хрень потому что что индексы в сиквеле. Хрень потому не прометеус, там все это по человечески решено

Прометеусом не пользовался, поэтому аргумент "это не прометеус" мне ваще странным кажется.

Alexey

Alexey

Прометеусом не пользовался, поэтому аргумент "это не прометеус" мне ваще странным кажется.

По пробуйте, думаю потом вопросов не возникнет

Alexey

Alexey

Не убедил.

Больше похоже на синдром утенка, уж извини)

Ну да ладно)

Проблема в том что я опять увидел не гибкий Геморой. Куча виртуалок, очередь метрик - все дорогуша перестраивай все нах. А ты начал с мелкого инстанса - ну не повезло, надо было сразу настраиваться на режим по завоеванию мира.

J

J

В общем спасибо за инфу, буду курить доки.

А, ты думал, он сами метрики тоже кладет в реляционную базу?)

Aleksey

Aleksey

а до гланса то запрос доходит?

единственное что вижу так вот только вот это на стороне хорайзона:

https://hastebin.com/texodilifu.rb

Aleksey

Aleksey

единственное что вижу так вот только вот это на стороне хорайзона:

https://hastebin.com/texodilifu.rb

хотя вот ещё что есть в глансе

https://hastebin.com/ilegovamox.go

но что-то мне подсказывает это как раз из-за того что файла нет

Georgii

Georgii

Ребят ещё вопрос, уже малость холиварный. Лицензирование виндов (очень не хочется hyperv тачки в кластере иметь). Все так же осталось в windows среде - виртуальное ядро равно сокету и процессору в винде ? Или что то поменялось и к KVM винда стала более лояльна ?

Можещь покрывать только лицензиями ms datacenter, считать по сокетам где запущены компноды

Georgii

Georgii

Может кто подсказать - решил horizon вынести с /dashboard в корень /

Но после этого после логина под admin стало перекидываться на страницу api.

Все их за того что в /etc/httpd/conf.d/wsgi-keystone.conf прописано Alias /identity /usr/bin/keystone-wsgi-public

<Location /identity>

Andrey

Andrey

вот я то не понимаю - по умолчанию api не должны на 80 порту работать ?

Апи на своих портах работают

Georgii

Georgii

Апи на своих портах работают

Так я про то же, непонятно зачем это в конфиге apache по умочанию

Georgii

Georgii

И по правильному это надо убрать, зачем клиент должен видеть

{"versions": {"values": [{"status": "stable", "updated": "2017-02-22T00:00:00Z", "media-types": [{"base": "application/json", "type": "application/vnd.openstack.identity-v3+json"}], "id": "v3.8", "links": [{"href": "http://cloud.com/identity/v3/", "rel": "self"}]}, {"status": "deprecated", "updated": "2016-08-04T00:00:00Z", "media-types": [{"base": "application/json", "type": "application/vnd.openstack.identity-v2.0+json"}], "id": "v2.0", "links": [{"href": "http://cloud.om/identity/v2.0/", "rel": "self"}, {"href": "https://docs.openstack.org/", "type": "text/html", "rel": "describedby"}]}]

Andrey

Andrey

Не, стоп. Это просто каталог ендпойнтов, он и так доступен клиенту, ничего секретного тут нет. Колдуйте с апачем

Georgii

Georgii

Не, стоп. Это просто каталог ендпойнтов, он и так доступен клиенту, ничего секретного тут нет. Колдуйте с апачем

Так он отдаётся http://horizon/identity. Можно его отсюда убрать на порт keystone?

Inna

Inna

Может кто подсказать - решил horizon вынести с /dashboard в корень /

Но после этого после логина под admin стало перекидываться на страницу api.

Все их за того что в /etc/httpd/conf.d/wsgi-keystone.conf прописано Alias /identity /usr/bin/keystone-wsgi-public

<Location /identity>

а тут поправлено? /etc/openstack-dashboard/local_settings:

# WEBROOT is the location relative to Webserver root

# should end with a slash.

WEBROOT = '/dashboard/'

Inna

Inna

Так он отдаётся http://horizon/identity. Можно его отсюда убрать на порт keystone?

http://controller:5000/identity у меня только так отдает апи, а без порта нет

Georgii

Georgii

а тут поправлено? /etc/openstack-dashboard/local_settings:

# WEBROOT is the location relative to Webserver root

# should end with a slash.

WEBROOT = '/dashboard/'

Конечно, ставил webroot ='/'

Ту дело в том что по умолчанию после авторизации перекидывает на страницу с проектами которая имеет вид http://horizon/dashboard/identity

Inna

Inna

Georgii

Georgii

Ну и если убрать dassboard то страница с проектами будет иметь то же имя что и страница с ендпоинтами

Ruslan

Ruslan

Kira Kira joined the group

Судя по жопе - ждать спам

Спам, ага. В клаудру такие же задницы и сиськи.

Александр

Александр

Комрады, всем привет! Недавно начал изучать openstack, подскажите, как чайнику, где "физически" находится floating ip? В смысле на каком интерфейсе и у кого он должен находится? Сам инстанс про флоатинг-адрес не знает, для него это работает как нат, я правильно понимаю? Кто осуществляет это самое натирование? В чьем iptables или в чьем namespace он должен быть?

Александр

Александр

Александр

Александр

Комрады, всем привет! Недавно начал изучать openstack, подскажите, как чайнику, где "физически" находится floating ip? В смысле на каком интерфейсе и у кого он должен находится? Сам инстанс про флоатинг-адрес не знает, для него это работает как нат, я правильно понимаю? Кто осуществляет это самое натирование? В чьем iptables или в чьем namespace он должен быть?

Находиться он может либо на network controller если централизованный роутер,либо на compute node при дистрибутед режиме

Александр

Александр

У нас используется HA dvr с openvswitch. На ноде, где активен роутер, в неймспейсе snat белый адрес только - шлюз для внешней сети. А в неймспейсе qrouter есть только шлюз для серой сетки проекта. Не считая HA интерфейсов, типа 169.254.бла.бла.

Александр

Александр

В iptables на compute-нодах и на контроллере и в неймспейсах нет упоминаний адреса, который я ищу (floating-ip адрес).

Александр

Александр

На compute-node и на контроллере в неймспейсе fip тоже нет упоминаний про этот адрес, который я ищу, ни в iptables, ни в ip addr.

NS 🇷🇺

NS 🇷🇺

Комрады, всем привет! Недавно начал изучать openstack, подскажите, как чайнику, где "физически" находится floating ip? В смысле на каком интерфейсе и у кого он должен находится? Сам инстанс про флоатинг-адрес не знает, для него это работает как нат, я правильно понимаю? Кто осуществляет это самое натирование? В чьем iptables или в чьем namespace он должен быть?

посмотри внимательно на фип неймспейсы на компутах

NS 🇷🇺

NS 🇷🇺

Александр

Александр

посмотри внимательно на фип неймспейсы на компутах

На compute-нодах в неймспейсе fip есть только один белый адрес, и это floatingip_agent_gateway.

J

J

Andrey

Andrey

На compute-node и на контроллере в неймспейсе fip тоже нет упоминаний про этот адрес, который я ищу, ни в iptables, ни в ip addr.

Глупый вопрос - фип то подключен? Работает?

Анатолий

Анатолий

просто опенстек досталось как бремя одно время удалось его поддерживать сейчас работать с ним толком не дает.

Анатолий

Анатолий

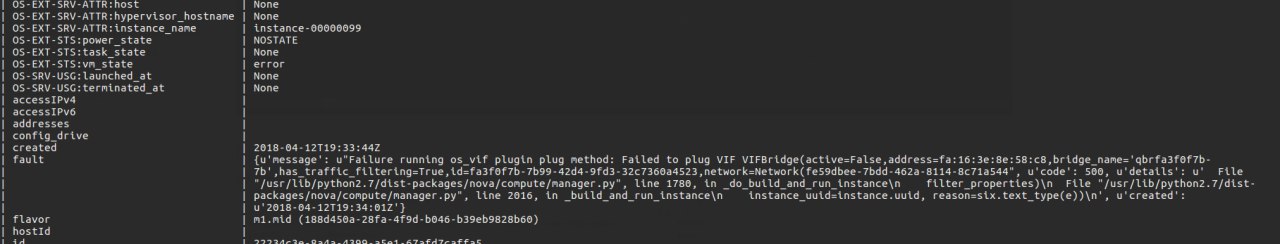

вот машина которая отвалилась

https://paste.laravel.io/cebf2008-2922-4284-a7b3-853f156adf6c

J

J

вот машина которая отвалилась

https://paste.laravel.io/cebf2008-2922-4284-a7b3-853f156adf6c

Нене, надо логи neutron и nova смотерть, а не просто в выводе клиента.

Александр

Александр

Глупый вопрос - фип то подключен? Работает?

Всё работает, сеть функционирует, доступ к инстансу есть. Хотим разобраться.

Анатолий

Анатолий

Всё работает, сеть функционирует, доступ к инстансу есть. Хотим разобраться.

Саша привет, недумал что тут встретимся)

Александр

Александр

Саша привет, недумал что тут встретимся)

Здорово, Толян) openstack объединяет) точнее объединяют его траблы))

Анатолий

Анатолий

Нене, надо логи neutron и nova смотерть, а не просто в выводе клиента.

подскажите файлы куда он это пишет. у nova их много.

J

J

подскажите файлы куда он это пишет. у nova их много.

логи nova-api нужно смотреть с контроллеров, nova-compute с гипервизора где манипуляции проводятся.

Плюс логи linux bridge агента с гипервизора и логи neutron сервера с контроллера.

Анатолий

Анатолий

снова заработало создание и эвакуация... ладно попробую спровоцировать повторение данных ошибок.

быть может через какое то время это повторится

Inna

Inna

снова заработало создание и эвакуация... ладно попробую спровоцировать повторение данных ошибок.

быть может через какое то время это повторится

привет, может проблема где-то на одной компьют-ноде? посмотри логи neutron-openvswitch-agent и nova-compute на проблемной компьют-ноде.

Анатолий

Анатолий

Анатолий

Анатолий

привет, может проблема где-то на одной компьют-ноде? посмотри логи neutron-openvswitch-agent и nova-compute на проблемной компьют-ноде.

Привет Инна, сразу тебя не узнал.

Inna

Inna

да, кстати, с floating ip, нашли его в iptables qrouter-неймспейса на компьют-ноде, плохо смотрели >_<

J

J

На compute-нодах в неймспейсе fip есть только один белый адрес, и это floatingip_agent_gateway.

Смотреть нужно на гипервизоре где расположена виртуалка в пространстве qrouter.

10.98.97.0 приватная self-service сеть

10.1.89.0 - тестовая сеть из которой назначается floating ip

Вроде видно все.

Maxim

Maxim