Anonymous

Anonymous

А то у меня как раз часть пользователей сидит в хорайзоне весь день и мышкой тычется. Их кеш спасет

Evgeny

Evgeny

подскажите как можно поднять производительность DHCP агента (предположительно в нем проблема) - выражается что при поднятии пачки инстансов некоторые не успевают получить DNS имя и вместо test1 например получается что хост с именем host-10-254-39-46

NS 🇷🇺

NS 🇷🇺

Igor

Igor

Но инфа об имени берётся из описания порта, а порт создаётся с правильным именем + имена в dnsmasq через несколько минут становятся правильными

Igor

Igor

Есть презентация про internal dns name resolving , вроде бы там сервиса метаданных нету или я что то путаю

Andrey

Andrey

самый простой путь - отсрочить dhcp запросы в образе, или даже сделать проверку - если hostname приехал дефолтовый то спать и повторить попытку через минуту

Evgeny

Evgeny

увеличение количества воркеров метадата не помогло, еще есть настройка в dhcp агенте num_sync_threads - по умолчанию 4 - может быть в этом дело?

J

J

Ребята, мож кому в голову сразу придет что проверить, ну а нет так нет)

Решил я на ноуте лабу освежить и склонировал из мастера openstack-ansible. Поставил все и вот какая беда:

glance-api при добавлении образа возвращает 201, образ в статусе queued и на этом все.

Никаких попыток обратиться к glance-registry - ни в логах ни в дампах трафика. Будто glance-api просто забивает на запрос и не обращается никуда ваще. Может найдется пара идей на что посмотреть?

Artem

Artem

J

J

А я говорил уже, что использовать чужие плейбуки так себе затея?)

Говорил, но свой личный написанный в одиночку чот не показал)

Михаил

Михаил

Коллеги, привет

Может-быть кому-то будет интересно https://hh.ru/vacancy/22942643

уже месяц ищут или больше

J

J

BTW, разобрался с той проблемой с glance. CLI клиент норм заливал образы, а через horizon не получалось. В итоге то дело оказалось в том что haproxy для Glance был с автоматически сгенерированным самоподписным сертификатом который я забыл руками в браузер добавить. И при попытке браузера напрямую прицепиться к glance-api и залить файл браузер сам себя на хуй слал из-за того что сертификат самоподписный и нет возможности его проверить.

Alexander

Alexander

Насколько я знаю, там уже кого-то взяли и расширяют команду

да все кого взяли в этом чате. пусть + поставят

Andrey

Andrey

И при попытке браузера напрямую прицепиться к glance-api такой хуйни вроде быть не должно, все через хапрокси должно работать... странная конфигурация

J

J

И при попытке браузера напрямую прицепиться к glance-api такой хуйни вроде быть не должно, все через хапрокси должно работать... странная конфигурация

Не так выразился)

Через него и работало.

J

J

А ваще чот думаю что зря мастер брал, а не стабильную ветку. В репозитории для pip он тоже тянет из мастеров каждого проекта поэтому щас в horizon, к примеру, происходит примерно похожее вот на это:

https://bugs.launchpad.net/horizon/+bug/1637072

J

J

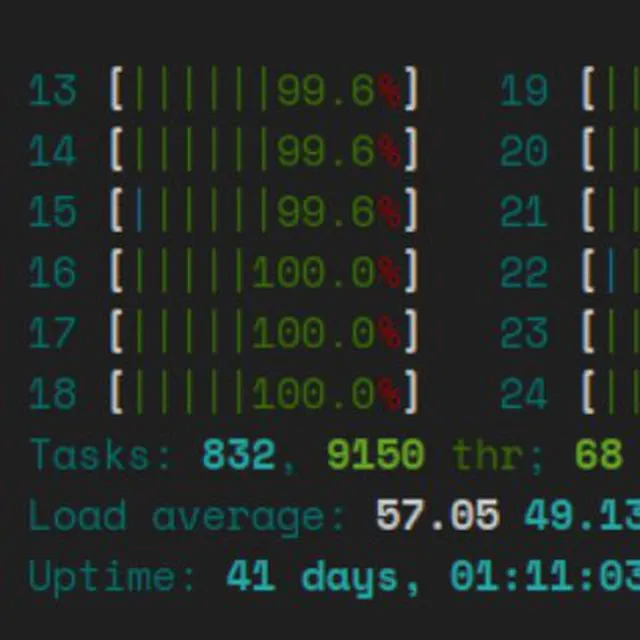

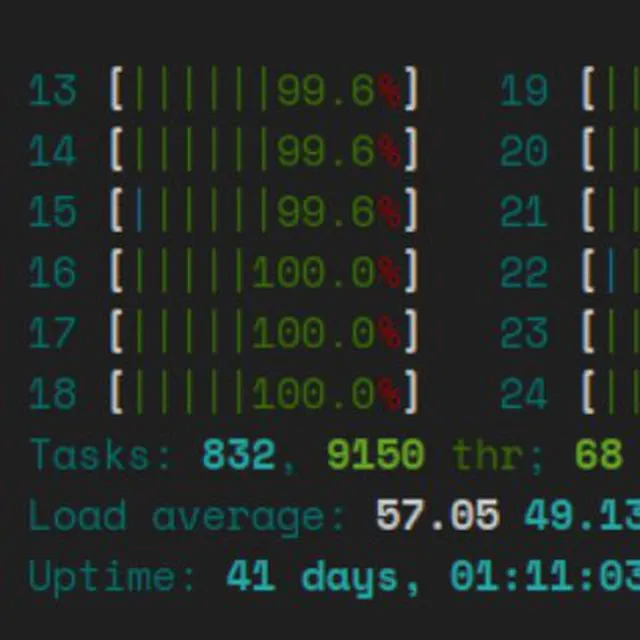

Да ладн, это профанация, а не беседа.

Коллега даже не рассказал же нам как тестировал, на каком оборудовании и все такое.

Dorian

Dorian

К Вопросу о перформансу линукс бриджа:

UDP

[root@aka ~]# iperf -c 192.168.122.1

—----------------------------------------------------------

Client connecting to 192.168.122.1, TCP port 5001

TCP window size: 85.0 KByte (default)

—----------------------------------------------------------

[ 3] local 192.168.122.179 port 37756 connected with 192.168.122.1 port 5001

[ ID] Interval Transfer Bandwidth

[ 3] 0.0-10.0 sec 41.4 GBytes 35.6 Gbits/sec

TCP

[root@aka ~]# iperf -uc 192.168.122.1

—----------------------------------------------------------

Client connecting to 192.168.122.1, UDP port 5001

Sending 1470 byte datagrams, IPG target: 11215.21 us (kalman adjust)

UDP buffer size: 208 KByte (default)

—----------------------------------------------------------

[ 3] local 192.168.122.179 port 33916 connected with 192.168.122.1 port 5001

[ ID] Interval Transfer Bandwidth

[ 3] 0.0-10.0 sec 1.25 MBytes 1.05 Mbits/sec

[ 3] Sent 893 datagrams

[ 3] Server Report:

[ 3] 0.0-10.0 sec 1.25 MBytes 1.05 Mbits/sec 0.000 ms 0/ 893 (0%)

J

J

Dorian

Dorian

[root@aka ~]# iperf -uc 192.168.122.1 -b 1000Mbit

—----------------------------------------------------------

Client connecting to 192.168.122.1, UDP port 5001

Sending 1470 byte datagrams, IPG target: 11.22 us (kalman adjust)

UDP buffer size: 208 KByte (default)

—----------------------------------------------------------

[ 3] local 192.168.122.179 port 56252 connected with 192.168.122.1 port 5001

[ ID] Interval Transfer Bandwidth

[ 3] 0.0-10.0 sec 1.22 GBytes 1.05 Gbits/sec

[ 3] Sent 891647 datagrams

[ 3] Server Report:

[ 3] 0.0-10.0 sec 1.22 GBytes 1.05 Gbits/sec 0.000 ms 0/891647 (0%)

Andrey

Andrey

[root@aka ~]# iperf -uc 192.168.122.1 -b 1000Mbit

—----------------------------------------------------------

Client connecting to 192.168.122.1, UDP port 5001

Sending 1470 byte datagrams, IPG target: 11.22 us (kalman adjust)

UDP buffer size: 208 KByte (default)

—----------------------------------------------------------

[ 3] local 192.168.122.179 port 56252 connected with 192.168.122.1 port 5001

[ ID] Interval Transfer Bandwidth

[ 3] 0.0-10.0 sec 1.22 GBytes 1.05 Gbits/sec

[ 3] Sent 891647 datagrams

[ 3] Server Report:

[ 3] 0.0-10.0 sec 1.22 GBytes 1.05 Gbits/sec 0.000 ms 0/891647 (0%)

поиграйся с iperf3, у меня впрочем вообще никогда не получалось заставить его UDP нормально мерить

J

J

В udp Нет никаких congestion control алгоритмов. За скорость отправки отвечает само приложение. А в iperf нет никаких умных реализаций для этого. Поэтому и требуется вручную указывать целевую пропускную способность к которой он будет стремиться.

Dorian

Dorian

Accepted connection from 192.168.122.1, port 3153

[ 5] local 192.168.122.179 port 5201 connected to 192.168.122.1 port 20199

[ ID] Interval Transfer Bandwidth Jitter Lost/Total Datagrams

[ 5] 0.00-1.00 sec 112 MBytes 938 Mbits/sec 0.002 ms 6/80286 (0.0075%)

[ 5] 1.00-2.00 sec 119 MBytes 1000 Mbits/sec 0.003 ms 0/85585 (0%)

[ 5] 2.00-3.00 sec 119 MBytes 1000 Mbits/sec 0.002 ms 0/85605 (0%)

[ 5] 3.00-4.00 sec 119 MBytes 1.00 Gbits/sec 0.001 ms 0/85629 (0%)

[ 5] 4.00-5.00 sec 119 MBytes 1000 Mbits/sec 0.002 ms 0/85588 (0%)

[ 5] 5.00-6.00 sec 119 MBytes 1.00 Gbits/sec 0.003 ms 0/85663 (0%)

[ 5] 6.00-7.00 sec 119 MBytes 1.00 Gbits/sec 0.002 ms 33/85760 (0.038%)

[ 5] 7.00-8.00 sec 119 MBytes 999 Mbits/sec 0.002 ms 0/85560 (0%)

[ 5] 8.00-9.00 sec 119 MBytes 1000 Mbits/sec 0.002 ms 33/85614 (0.039%)

[ 5] 9.00-10.00 sec 119 MBytes 999 Mbits/sec 0.002 ms 0/85548 (0%)

[ 5] 10.00-10.04 sec 0.00 Bytes 0.00 bits/sec 0.002 ms 0/0 (0%)

- - - - - - - - - - - - - - - - - - - - - - - - -

Polina

Polina

Fox

Fox

Radik

Radik

Александр

Александр

Ilya

Ilya