p

p

project: {"arr.doc1.field1": 0}

помогло, спасибо! да, описал не очень правильно, извиняюсь

yopp

yopp

Коллеги, подскажите. Удаление данных с помощью bulk вешает lock на базу ?

https://docs.mongodb.com/manual/faq/concurrency/#what-locks-are-taken-by-some-common-client-operations

yopp

yopp

Напомню: bulk это просто способ передачи команд в монгу. Вместо цикла один запрос — один ответ на каждую, они группой передаются на сервер и там исполняются. Получается много запросов — один ответ. Сами команды выполняются в монге как обычно.

Vlad

Vlad

Добрый день. Ради теста на одной из реплик кластера восстановили ошибочные данные в бд local. После этого автоматически нода неподнимается с сыпет ошибкой:

mongod.27017[28513]: [initandlisten] Fatal assertion 40466 TooManyMatchingDocuments: More than singleton document found in namespace: local.replset.minvalid at src/mongo/db/repl/replication_consistency_markers_impl.cpp 87

Можно ли восстановить косячную ноду через удалении коллекции или в таких случаях только восстановление из бекапа?

Локально на ноду можно зайти без опций репликации.

Yurii

Yurii

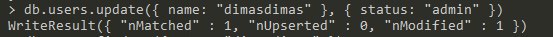

правда юзер с этим именем исчез после этого...

https://docs.mongodb.com/manual/reference/method/db.collection.update/#update-parameter

Dmitry

Dmitry

vitalii

vitalii

let user_tracksSchema = new mongoose.Schema({

id: {

type: String,

required: true,

unique: true

},

playlist:[{

playlistName: {

type:String

},

tracks:[{

trackName: {default: "Noname", type: String},

artistName: String,

albumName: String,

duration_ms: String,

preview_url: String

}]

}]

});

не могу запушить треки в плейлист по названию , кто знает в чем проблема .

user_tracks.findOneAndUpdate({$and:[{id: req.decoded._id},{"playlist.playlistName":"default"}]},{$push:{"tracks.trackName":"myFirstTrack"}},(err,doc)=>{

res.json({status:200,tracks:doc});

});

SvPupok

SvPupok

коллеги, простите великодушно, запамятовал, как в js скрипте можно обьявить чтение с secondary нод репликасета? с телефона просто неудобно гуглить(

Bandikoot

Bandikoot

все, вспомнил, rs.slaveOk()

это вроде должно включить только возможность чтения с секондари. чтобы задать наверняка есть .readPref(secondary), который к курсору применяется

SvPupok

SvPupok

SvPupok

SvPupok

из головы вылетело именно как обьявлять возможность чтения, а readPreference - эт само собой

Bandikoot

Bandikoot

из головы вылетело именно как обьявлять возможность чтения, а readPreference - эт само собой

хоп-слейвок

мнемоническое запоминание, ну)

Ilya

Ilya

Всем добрый день, подскажите с таким вопросом:

Есть документ вида:

{

_id: ObjectID

name: string

....,

items: [

{

name: string

type: string

size: int

},

...

]

}

как видно у него есть массив вложенных документов items, в нем могут быть несколько тысяч.

как при выборке ограничить элементы в items?

на сайте монги советуют использовать аггрегации, но с ними проблема начинается в том что необходимо испольховать skip и limit, и в этом случае запрос начинает работать очень медленно

Javed

Javed

Yurii

Yurii

Всем добрый день, подскажите с таким вопросом:

Есть документ вида:

{

_id: ObjectID

name: string

....,

items: [

{

name: string

type: string

size: int

},

...

]

}

как видно у него есть массив вложенных документов items, в нем могут быть несколько тысяч.

как при выборке ограничить элементы в items?

на сайте монги советуют использовать аггрегации, но с ними проблема начинается в том что необходимо испольховать skip и limit, и в этом случае запрос начинает работать очень медленно

тебе надо пагинацию, что ты skip и limit используешь, или просто последние несколько штук?

Ilya

Ilya

нет $unwind не пробывал, если его сделать и отфильровать то в результате будут только те items которые попали в условие?

Yurii

Yurii

нет $unwind не пробывал, если его сделать и отфильровать то в результате будут только те items которые попали в условие?

ну я не знаю, как ты делаешь, тут же нет твоей агрегации. Вообще оно должно быть как-то так

db.collection.aggregate([

{$match: {_id: someId}},

{$unwind: "items"},

{$skip: 0},

{$limit: 50}

])

Yurii

Yurii

эээ дак что в этом случае дал unwind ?

у нас появилось количество = длине массива items одинаковых документов (кроме поля items), у которых items - уникальный объект, а не массив

Ilya

Ilya

есть документ у которого в items тысячи вложенных документов,

мне надо вывести этот же документ но с чтобы в items остались только те корые удовлетворяют условию

Yurii

Yurii

есть документ у которого в items тысячи вложенных документов,

мне надо вывести этот же документ но с чтобы в items остались только те корые удовлетворяют условию

хотя опять же, условие - просто пагинация или какие-то дополнительный фильтры?

Yurii

Yurii

возвращайся тогда сюда:

db.collection.aggregate([

{$match: some_criteria },

{$skip: skip_qty },

{$limit: limit_qty }

{$project: {

items: {$filter: {

input: "$items"

as: "item",

cond: { do_some_cond_with_$$item }

}},

project_all_need_fileds: 1

}}

])

https://docs.mongodb.com/manual/reference/operator/aggregation/filter/

Yurii

Yurii

в таком случае ты делаешь сначала пагинацию по документах, а потом фильтруешь внутринности items по переденным критериям

Ilya

Ilya

в общем работает, но опять та же самая проблема как только добавляешь skip - сразу скорость запроса проседает =(

Дмитрий

Дмитрий

Т.е. если у вас есть итерационное или предсказуемое поле его можно сформировать и скорость вывода уведичится

Ilya

Ilya

Т.е. если у вас есть итерационное или предсказуемое поле его можно сформировать и скорость вывода уведичится

можно поподробнее? индексы сделаны на те поля по которым match делается

я так понял что в аггрегациях skip всегда будет вносить задержку?

Дмитрий

Дмитрий

Да. Всегда. Для моего скип - это инородное. Она сначала делает агрегацию, а потом ее пагинирует. А вот если в условия пгрегации засунуть к примеру инкриментальный ид - будет значительно быстрее. Тогда агрегация будет скажем с 0 до 10

Дмитрий

Дмитрий

Забудьте все что знали о реляции) агрегация - берет всегда весь массив документов. Дополнительная выборка - всегда + 1 операция

Ilya

Ilya

ну вообще мне просто не понятно было почему project вобычном find не может нормально отфильтровать подмассив документов

Yurii

Yurii

https://dzone.com/articles/fast-paging-with-mongodb

один из вариантов сделать быстрее скип -

.find({'_id'> last_id})

Дмитрий

Дмитрий

ну вообще мне просто не понятно было почему project вобычном find не может нормально отфильтровать подмассив документов

Может. Почему. Просто там два запроса по факту. Субдокументы - отдельная коллекция

Ilya

Ilya

https://dzone.com/articles/fast-paging-with-mongodb

один из вариантов сделать быстрее скип -

.find({'_id'> last_id})

это к сожалению не подойдет в текущей постановке задачи

Ilya

Ilya

Может. Почему. Просто там два запроса по факту. Субдокументы - отдельная коллекция

Мы такую фишку сделали на функции js - типа сначала делаем запрос, а потом уже сам массив items фильтруем в js руками, и он работает очень быстро, но я хотел понять можно ли средствами самой монги обойтись без хранимых функций

yopp

yopp

Может. Почему. Просто там два запроса по факту. Субдокументы - отдельная коллекция

Ни какая это не отдельная коллекция

yopp

yopp

Если вы хотите skip/limit по вложенным документам с условием по вложенным документам — быстро не будет.

Дмитрий

Дмитрий

Ни какая это не отдельная коллекция

Разве? Я думал иначе. Киньтесь ссылкой про субдокументы. Как они устроены. Буду овен. Признателен

Ilya

Ilya

Если вы хотите skip/limit по вложенным документам с условием по вложенным документам — быстро не будет.

стоп еще раз скип и лимит нужен по верхнему документу, по вложенным нужен только фильтр

yopp

yopp

стоп еще раз скип и лимит нужен по верхнему документу, по вложенным нужен только фильтр

Тогда полностью сформулируйте задачу

yopp

yopp

Разве? Я думал иначе. Киньтесь ссылкой про субдокументы. Как они устроены. Буду овен. Признателен

https://docs.mongodb.com/manual/core/document/

pinelover

pinelover

Vadim

Vadim