Ребята привет, помогите побороть проблему, не могу понять в чем "прикол". При запросе к БД вида "value"=>'3A002E001657345630373420' ищет запись, а такую "value"=>'31002E000857345630373420' - уже нет - хотя эти записи 100% есть. Руками в Robomongo могу найти, но скриптом, почему-то вторую запись не так воспринимает...

проверьте, используете ли вы find_one вместо find.

Сергей

Сергей

т.к. запрос динамический и в него приходят переменные из других мест и там результаты долеки от одной строки

Игорь

Игорь

подскажите, если у меня запрос find по двум полям.

запрос

find({$and: [

{$or: [

{'category': {$in: [16, 17, 18, 19]}},

{'kind': {$in: [21373754,21373763,21373768]}} ] },

{'kind': {$nin: [23,24,25,26]}} ] } )

В ощем случае, то что поле используеться и в $in и потом $nin

как-то повлияет на посторение индекса?

сейчас создал индекс kind, category.

Oleg

Oleg

Ребята, привет. Подскажите, какой правильный и безопасный путь сжатия места в реплика сете, после дропания данных на всех мемберах

Игорь

Игорь

explain в помощь

explain показывает "inputStage" : {

"stage" : "IXSCAN",

Nick

Nick

Как описать в схеме монгуса массив объектов?

зайти в доки по могусу и почитат ькак описывается массив объектов, там на это сделан отдельный упор

Сергей

Сергей

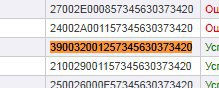

покажите запросы которые отправляете

{

'mfr_step' => 'mfr_needles',

'mcu_id' => '390032001257345630373420'

}

Вот такой find_query в логе

yopp

yopp

Сергей

Сергей

короч выполните свой запрос с одним полем mcu_id в монгошелле

и что в нем смотреть? Есть ли тот, что не получаю при конкретном mcu_id?

Nick

Nick

и что в нем смотреть? Есть ли тот, что не получаю при конкретном mcu_id?

эм, а в чем ваша пробелма тогда?

yopp

yopp

:( а как же быть тогда? очень больно уже с 500гб на каждом мембере

Не понимаю тогда что ты хочешь

Сергей

Сергей

db.getCollection('data').find({'mfr_step': 'mfr_needles', 'mcu_id' : '360033001657345630373420'}).sort({process_time: -1})

Игорь

Игорь

Такая ситуация. Есть массив значений поля, по которому нужно извлечь документы. Массив большой, несколько десятков тысяч значений. Оператор $in невероятно долго это выполняет, даже с индексом. Как лучше сделать?

Nick

Nick

вот берете свою основную задачу, и пытаетесь перестроит ьструктуру данных чтобы стало удобно работать и не зависеть от индексов

Игорь

Игорь

ну тут даже не в индексах дело. есть коллекция. В ней миллион документов. У документа есть поле offer с уникальным значением для каждого документа. Приходит запрос, в нем массив данных с конкретными значеними поля оффер. Допустим 100 000.

Игорь

Игорь

да, все документы у которых поле offer совпадает со значением в массиве. Грубов говоря, у товара есть уникальный id, есть массив с id этих товарав. Их 100 000, в коллекции миллион. Мне нужны только эти 100 000, которые запросили

Игорь

Игорь

То есть у монго нет эффективного средства для подобной выборки? Хотел сделать на стороне базы, в принципе и на клиенте можно, но не хотелось лишний раз такие объемы извлекать туда-сюда

Nick

Nick

причем скорость получения всех данных ориентировочно будет значительно быстрее если использовать натуральный порядок в БД даже против использования индексов

Dmitry

Dmitry

Выгружать миллион и делать на клиенте это тупик все равно. + траффик по сети. Оно минут 20 только выгружаться будет а потом память кончится. Это все равно нужно делать через запрос + paging

Dmitry

Dmitry

возможно можно добавить доп поле и просчитывать его в worker или сразу сохранять и по нему фильтровать

Игорь

Игорь

В общем $in справился, как ни странно. Нашел в коде утечку памяти из-за которой запрос начинла есть, как не всебя оперативку.

Игорь

Игорь

тестировал на локальной машине, со скромными ресурсами. По коллекции с 800 000 записями сложный запрос

find({$and: [

{$or: [

{'category': {$in: [выбирает все 800 000 значений]}},

{'offer': {$in: [сто тысяч значений]}} ] },

{'offer': {$nin: [сорок тысяч значений]}} ] } )

условие categry $in дополнительно выбирает всю коллецию целиком для усложнения нагрузки.

тестирую через скрипт, время ответа базы к скрипту менее секунды. Плюс комп сейчас ОЧЕНЬ скромный по ресурсам, прям совсем

Nickolay

Nickolay

Alexander

Alexander

Eugene

Eugene