Ну потому что может там nvme, а не сасы нашпинделях :)

Хрен! С нвме делл г13 не умеет грузиться. Проверено...

Vladimir

Vladimir

Всем привет! Подскажите, пожалуйста, кто-то использует cinder driver для внешних СХД без поддержки Active/Active High Availability Support, например, NFS, 3Par? Как в этом случае обеспечивается отказоустойчивость для cinder-volume клиента? Как быть если нода с cinder-volume сдохла, или ей нужен мейнтенанс и тп? Спасибо!

Artemy

Artemy

Такие внешние СХД вообще не нуждаются в синдер-волюме. Синдер делает только оркестрацию, и даже если он полностью умрет СХД продолжит успешно обслуживать ВМ.

Artemy

Artemy

Поэтому такие волюмы можно смело запускать и редеплоить в любой момент, поскольку он по сути не имеет стейта, и все его данные это конфиг и база синдера

Vladimir

Vladimir

спасибо тебе. а как предполагается его редеплоить? это же как то должно быть автоматизировано

Artemy

Artemy

Ну если переложить анекдот про сову и ежиков, то я сова, мое дело стратегия. А вообще зависит от того чем вы деплоите. В ВК например можно просто прописать это в ансибле и прокатить по новому хосту в течение нескольких минут

NS 🇷🇺

NS 🇷🇺

спасибо тебе. а как предполагается его редеплоить? это же как то должно быть автоматизировано

тысячу раз уже писали, прописываем backend_host и вуаля

NS 🇷🇺

NS 🇷🇺

и как оцениваете стабильность NFS драйвера? он там не шибко часто обновляется...

А чему там обновляться то?

Artemy

Artemy

Там такой же почти драйвер и под smb, можно налепить и под что угодно другое, вообще не вопрос. Отличие только в маунте

Dmitry

Dmitry

Прорваться в сообщество нетривиальная задача. Всем спасибо за содействие.

Продолжая тему вопроса от Володи хочу задать еще пару вопросов.

Если запускать cinder-volume на нескольких хостах с не active-active драйвером прийдется потом переписывать вольюмы на другой хост после окончательной смерти одного из них?

Нормальная практика держать несколько cinder-volume с одним backend_host, или так работать не будет?

J

J

Прорваться в сообщество нетривиальная задача. Всем спасибо за содействие.

Продолжая тему вопроса от Володи хочу задать еще пару вопросов.

Если запускать cinder-volume на нескольких хостах с не active-active драйвером прийдется потом переписывать вольюмы на другой хост после окончательной смерти одного из них?

Нормальная практика держать несколько cinder-volume с одним backend_host, или так работать не будет?

А вот гляди.

https://docs.openstack.org/cinder/latest/contributor/high_availability.html

J

J

Несколько cinder volume в режиме кластера будут работать, если прописать в конфиг имя кластера.

По истории погляди)

Artemy

Artemy

Прорваться в сообщество нетривиальная задача. Всем спасибо за содействие.

Продолжая тему вопроса от Володи хочу задать еще пару вопросов.

Если запускать cinder-volume на нескольких хостах с не active-active драйвером прийдется потом переписывать вольюмы на другой хост после окончательной смерти одного из них?

Нормальная практика держать несколько cinder-volume с одним backend_host, или так работать не будет?

Или ты используешь кластеризованный синдер и ничего переименовывать не надо, или просто добавляешь бакэнд на другой хост и указываешь ему backend_host от старого бакэнда.

Dmitry

Dmitry

Понятно, у меня в голове кластерный режим и active-active слились и теперь мешают понимаю как работает с active/passive.

NS 🇷🇺

NS 🇷🇺

Анатолий

Анатолий

добрый день, пытаюсь создать compute_instance с помощью терраформа (1.48.0), при этом сетевые настройки хочу конфигурировать через cloud-init (rendered template), создал следующие конструкты:

openstack_networking_router_v2

openstack_networking_network_v2

openstack_networking_subnet_v2 (с cidr вместо pool)

openstack_networking_router_interface_v2

при попытке указать openstack_compute_instance_v2 в network в качестве имени сети имя subnet'а, получаю: Error trying to get network information from the Network API: Could not find any matching network for name xxx-net.

Похоже, subnet указать нельзя? Во многих примерах вижу создание отдельного порта (SIC!) для каждой VM. Подскажите пожалуйста, как в итоге лучше сделать, чтобы сетевые настройки я всё таки мог задавать именно в user_data и действительно ли нужно создавать порты для каждой VM (т.е. они не выделяются автоматически)?

NS 🇷🇺

NS 🇷🇺

Анатолий

Анатолий

не нужно создавать, можно указывать нетворк

вы имеете в виду openstack_networking_network_v2? тогда как os узнает, в какой subnet машину включить? я не очень понимаю эту двухуровневость network-subnet, как мне показалось, network это какой-то общий конструкт, куда мапятся subnet'ы, а в них уже мапятся инстансы

NS 🇷🇺

NS 🇷🇺

вы имеете в виду openstack_networking_network_v2? тогда как os узнает, в какой subnet машину включить? я не очень понимаю эту двухуровневость network-subnet, как мне показалось, network это какой-то общий конструкт, куда мапятся subnet'ы, а в них уже мапятся инстансы

у вас в сети несколько сабнетов?

Илья | 😶☮️🐸

Илья | 😶☮️🐸

вы имеете в виду openstack_networking_network_v2? тогда как os узнает, в какой subnet машину включить? я не очень понимаю эту двухуровневость network-subnet, как мне показалось, network это какой-то общий конструкт, куда мапятся subnet'ы, а в них уже мапятся инстансы

в какой subnet включить вм решает ipam

Анатолий

Анатолий

указываете network и будет счастье

хм, действительно, в примерах порты создаются именно в network, а не subnet, но как быть в случае 2-х и более subnet'ов в сети и настройке сети через cloud-init?

Анатолий

Анатолий

в какой subnet включить вм решает ipam

а ipam поймёт, куда включать, если я со стороны os сеть не конфигурирую?

NS 🇷🇺

NS 🇷🇺

хм, действительно, в примерах порты создаются именно в network, а не subnet, но как быть в случае 2-х и более subnet'ов в сети и настройке сети через cloud-init?

в случае двух и более сабнетов прописывать надо будет порт, который предварительно создаете

Pavel

Pavel

в опенстеке, вм не отделима от сети. сейчас хорошо хотя бы не считают что вм дохлая если не запросила ip по dhcp. В митаке вм стрелял если не было запроса

Анатолий

Анатолий

в опенстеке, вм не отделима от сети. сейчас хорошо хотя бы не считают что вм дохлая если не запросила ip по dhcp. В митаке вм стрелял если не было запроса

я верно понимаю, что в os конфигурировать сеть именно через cloud-init не очень хорошая практика?

Илья | 😶☮️🐸

Илья | 😶☮️🐸

я верно понимаю, что в os конфигурировать сеть именно через cloud-init не очень хорошая практика?

скорее это не нужно делать

Илья | 😶☮️🐸

Илья | 😶☮️🐸

у вас есть метадата, там вся инфа о портах, cloud-init должен настроить всё правильно. Но на некоторых образах линупсов это работает через задницу и поднимает только первый порт (таблицы маршрутизации не могло настроить)

NS 🇷🇺

NS 🇷🇺

Pavel

Pavel

я верно понимаю, что в os конфигурировать сеть именно через cloud-init не очень хорошая практика?

Смотря для чего. если например нужно бридж в вм созадать и на него уже повесить ip то можно, или например через метадату получить ip и сконфигуриовть что-то специфичное.

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Проблема в том, что ты сеть гибко не настроишь без SDN контроллера

А он обязателен будет, без него никуда

Анатолий

Анатолий

короче, с сетью через cloud-init какой-то трэш, так что решил делать через fixed_ip_v4 в блоке network instance'а, а остальное (пользователи, ключи, скрипты) - через init, работает нормально

Анатолий

Анатолий

+ ещё в какой-то версии init'а были косяки https://askubuntu.com/questions/1405294/ubuntu-20-04-cloud-init-wont-configure-network, так что решил не отлавливать

NS 🇷🇺

NS 🇷🇺

короче, с сетью через cloud-init какой-то трэш, так что решил делать через fixed_ip_v4 в блоке network instance'а, а остальное (пользователи, ключи, скрипты) - через init, работает нормально

А какой практичный кейс то хотели решить настройкой сети через клаудинит?

Анатолий

Анатолий

А какой практичный кейс то хотели решить настройкой сети через клаудинит?

практический кейс - удобство (субъективное, конечно), т.е. единая точка конфига всего (сети, пользователей, etc) независимо от платформы, но что-то пошло не так. в vcd тоже сеть через init не конфигурится. сама задача - это деплой условного контроллера и условных engine'ов с fio на борту с конфигом гостей, разливкой джоб fio, тестами и сбором данных для аналитики.

Анатолий

Анатолий

собсна, сам велосипед по сторадж бенчмаркингу я нарисовал, как и рецепт tf для vcd, а с os у меня беда просто из-за незнания логических конструктов тенанта

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Господа-чуваки, хочу перенести часть ворклоада в кубернетесы, а тут по счастливому совпадению есть немного опенстака. Магнум из коробки норм ? Много ли боли при запуске и настройке до адекватного вида ? Буквально 3-4 неймспейса нужно задеплоить чтоб лоад балансинг и вот эти вот все современные штуки

AcidMan

AcidMan

Господа-чуваки, хочу перенести часть ворклоада в кубернетесы, а тут по счастливому совпадению есть немного опенстака. Магнум из коробки норм ? Много ли боли при запуске и настройке до адекватного вида ? Буквально 3-4 неймспейса нужно задеплоить чтоб лоад балансинг и вот эти вот все современные штуки

не норм. хотя на 3-4 неймспейса может и достаточно будет. ну и надо понимать, что оно там почти не развивается.

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Григорій

Григорій

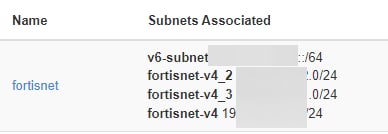

Добрый день, есть сеть без роутера и в ней 4 сабнета с дхцп, подскажите пожалуйста можно ли их как-то изолировать друг от друга эти сабнеты?

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Добрый день, есть сеть без роутера и в ней 4 сабнета с дхцп, подскажите пожалуйста можно ли их как-то изолировать друг от друга эти сабнеты?

да, на роутере можете отключить inter-vlan маршрутизацию)

J

J

Так тоже думал, думал может есть другой способ, спасибо

На виртуальных машинах фильтровать ARP или выключать вообще ARP Learning и статические записи.

Но вряд ли такое подойдет, да?)

NS 🇷🇺

NS 🇷🇺

да вообще не понятно зачем делать несколько сабнетов в одном нетворке. Ну только на случай, если обсчитались и адресов не хватило

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Григорій

Григорій

На виртуальных машинах фильтровать ARP или выключать вообще ARP Learning и статические записи.

Но вряд ли такое подойдет, да?)

Да в целом как вариант, можно рассмотреть)

Stanley

Stanley

Ilya

Ilya

John Roe

John Roe