Maksimus Ulibikus

Maksimus Ulibikus

Если Cloud image ровный, он через cloud init продавит ip без всякого dhcp.

Я пробовал cirros. В нём хоть можно залогиниться, а в cloud образах не могу зайти, так как изз-за неработы сети он не принимает

#cloud-config

password: qwerty

chpasswd: { expire: False }

ssh_pwauth: True

Maksimus Ulibikus

Maksimus Ulibikus

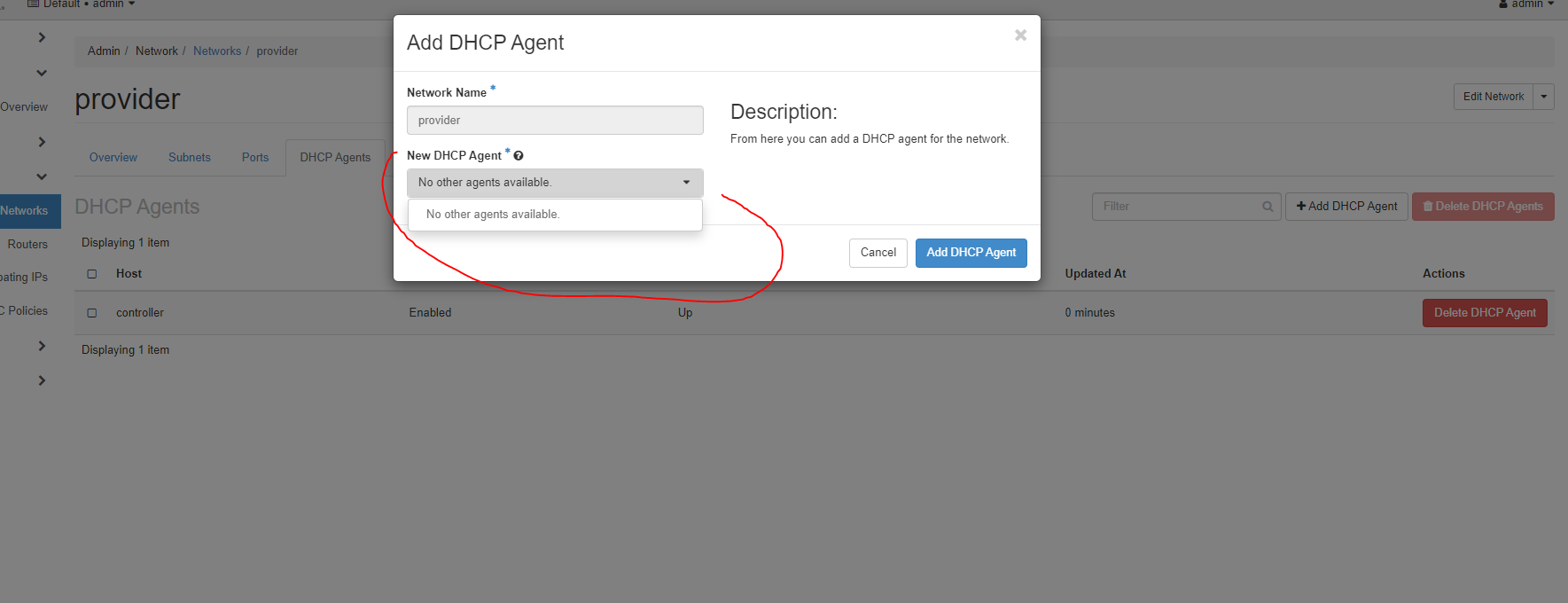

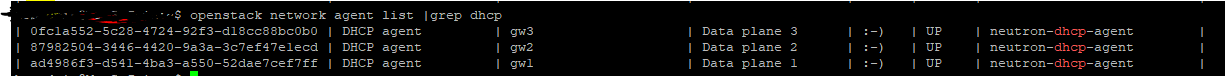

Вручную не хочет. Есть только один агент от контроллера. При попытке добавит агента от compute ...

Yuriy

Yuriy

Но я так понял, потому что neutron-dhcp-agent.service не запущен на compute

Он и не должен, особенно если у тебя не DVR.

Maksimus Ulibikus

Maksimus Ulibikus

Выдал инстансу фейс, но толку

<interface type='bridge'>

<mac address='fa:16:3e:f5:1b:0c'/>

<source bridge='brq1583ae9f-11'/>

<target dev='tapeb57b0a0-3a'/>

<model type='virtio'/>

<mtu size='1500'/>

<address type='pci' domain='0x0000' bus='0x00' slot='0x03' function='0x0'/>

</interface>

Maksimus Ulibikus

Maksimus Ulibikus

Что нова пишет в лог при развертывании инстанса?

Если не затруднит посмотреть вот логи с compute nova во время создания инстанса https://pastebin.com/kv8cgGn3

Maksimus Ulibikus

Maksimus Ulibikus

А вот такая байда говорит о проблемах с метадатой?

[[0;32m OK [0m] Started Wait for Network to be Configured.

Starting Initial cloud-init job (metadata service crawler)...

[ 47.510765] cloud-init[712]: Cloud-init v. 22.1-14-g2e17a0d6-0ubuntu1~18.04.3 running 'init' at Mon, 06 Jun 2022 09:10:11 +0000. Up 17.43 seconds.

[ 47.512787] cloud-init[712]: ci-info: +++++++++++++++++++++++++++++++++++++++Net device info+++++++++++++++++++++++++++++++++++++++

[ 47.514303] cloud-init[712]: ci-info: +--------+------+------------------------------+---------------+--------+-------------------+

[ 47.515740] cloud-init[712]: ci-info: | Device | Up | Address | Mask | Scope | Hw-Address |

[ 47.517194] cloud-init[712]: ci-info: +--------+------+------------------------------+---------------+--------+-------------------+

[ 47.518624] cloud-init[712]: ci-info: | ens3 | True | 10.10.85.11 | 255.255.255.0 | global | fa:16:3e:96:d4:58 |

[ 47.520146] cloud-init[712]: ci-info: | ens3 | True | fe80::f816:3eff:fe96:d458/64 | . | link | fa:16:3e:96:d4:58 |

[ 47.521579] cloud-init[712]: ci-info: | lo | True | 127.0.0.1 | 255.0.0.0 | host | . |

[ 47.523000] cloud-init[712]: ci-info: | lo | True | ::1/128 | . | host | . |

[ 47.524430] cloud-init[712]: ci-info: +--------+------+------------------------------+---------------+--------+-------------------+

[ 47.525793] cloud-init[712]: ci-info: +++++++++++++++++++++++++++++++Route IPv4 info++++++++++++++++++++++++++++++++

[ 47.527085] cloud-init[712]: ci-info: +-------+-----------------+------------+-----------------+-----------+-------+

[ 47.528340] cloud-init[712]: ci-info: | Route | Destination | Gateway | Genmask | Interface | Flags |

[ 47.529640] cloud-init[712]: ci-info: +-------+-----------------+------------+-----------------+-----------+-------+

[ 47.530878] cloud-init[712]: ci-info: | 0 | 0.0.0.0 | 10.10.85.1 | 0.0.0.0 | ens3 | UG |

[ 47.532230] cloud-init[712]: ci-info: | 1 | 10.10.85.0 | 0.0.0.0 | 255.255.255.0 | ens3 | U |

[ 47.533502] cloud-init[712]: ci-info: | 2 | 169.254.169.254 | 10.10.85.2 | 255.255.255.255 | ens3 | UGH |

[ 47.534747] cloud-init[712]: ci-info: +-------+-----------------+------------+-----------------+-----------+-------+

[ 47.536022] cloud-init[712]: ci-info: +++++++++++++++++++Route IPv6 info+++++++++++++++++++

[ 47.537030] cloud-init[712]: ci-info: +-------+-------------+---------+-----------+-------+

[ 47.538039] cloud-init[712]: ci-info: | Route | Destination | Gateway | Interface | Flags |

[ 47.539049] cloud-init[712]: ci-info: +-------+-------------+---------+-----------+-------+

[ 47.540095] cloud-init[712]: ci-info: | 1 | fe80::/64 | :: | ens3 | U |

[ 47.541153] cloud-init[712]: ci-info: | 3 | local | :: | ens3 | U |

[ 47.542222] cloud-init[712]: ci-info: | 4 | ff00::/8 | :: | ens3 | U |

[ 47.543259] cloud-init[712]: ci-info: +-------+-------------+---------+-----------+-------+

[ 47.544287] cloud-init[712]: 2022-06-06 09:10:41,314 - util.py[WARNING]: No active metadata service found

[[0;32m OK [0m] Stopped Wait for Network to be Configured.

Maksimus Ulibikus

Maksimus Ulibikus

Yuriy

Yuriy

J

J

Fedor

Fedor

меня расстроили цены на длительный перелёт неведомыми собаками и куча работы на работе, я даже не заморачивался. хорошо вам потусить, надеюсь, кто-нить в этом году платит за ивенты))

Den

Den

А кто приехал на саммит? Давайте посчитаемся 😀

Мне такого счастья не довелось. Но человек от нас там должен быть :)

P

P

А кто приехал на саммит? Давайте посчитаемся 😀

Это про Берлинский? Меня цена билета слегка разочаровала :)

Ilya

Ilya

А вот такая байда говорит о проблемах с метадатой?

[[0;32m OK [0m] Started Wait for Network to be Configured.

Starting Initial cloud-init job (metadata service crawler)...

[ 47.510765] cloud-init[712]: Cloud-init v. 22.1-14-g2e17a0d6-0ubuntu1~18.04.3 running 'init' at Mon, 06 Jun 2022 09:10:11 +0000. Up 17.43 seconds.

[ 47.512787] cloud-init[712]: ci-info: +++++++++++++++++++++++++++++++++++++++Net device info+++++++++++++++++++++++++++++++++++++++

[ 47.514303] cloud-init[712]: ci-info: +--------+------+------------------------------+---------------+--------+-------------------+

[ 47.515740] cloud-init[712]: ci-info: | Device | Up | Address | Mask | Scope | Hw-Address |

[ 47.517194] cloud-init[712]: ci-info: +--------+------+------------------------------+---------------+--------+-------------------+

[ 47.518624] cloud-init[712]: ci-info: | ens3 | True | 10.10.85.11 | 255.255.255.0 | global | fa:16:3e:96:d4:58 |

[ 47.520146] cloud-init[712]: ci-info: | ens3 | True | fe80::f816:3eff:fe96:d458/64 | . | link | fa:16:3e:96:d4:58 |

[ 47.521579] cloud-init[712]: ci-info: | lo | True | 127.0.0.1 | 255.0.0.0 | host | . |

[ 47.523000] cloud-init[712]: ci-info: | lo | True | ::1/128 | . | host | . |

[ 47.524430] cloud-init[712]: ci-info: +--------+------+------------------------------+---------------+--------+-------------------+

[ 47.525793] cloud-init[712]: ci-info: +++++++++++++++++++++++++++++++Route IPv4 info++++++++++++++++++++++++++++++++

[ 47.527085] cloud-init[712]: ci-info: +-------+-----------------+------------+-----------------+-----------+-------+

[ 47.528340] cloud-init[712]: ci-info: | Route | Destination | Gateway | Genmask | Interface | Flags |

[ 47.529640] cloud-init[712]: ci-info: +-------+-----------------+------------+-----------------+-----------+-------+

[ 47.530878] cloud-init[712]: ci-info: | 0 | 0.0.0.0 | 10.10.85.1 | 0.0.0.0 | ens3 | UG |

[ 47.532230] cloud-init[712]: ci-info: | 1 | 10.10.85.0 | 0.0.0.0 | 255.255.255.0 | ens3 | U |

[ 47.533502] cloud-init[712]: ci-info: | 2 | 169.254.169.254 | 10.10.85.2 | 255.255.255.255 | ens3 | UGH |

[ 47.534747] cloud-init[712]: ci-info: +-------+-----------------+------------+-----------------+-----------+-------+

[ 47.536022] cloud-init[712]: ci-info: +++++++++++++++++++Route IPv6 info+++++++++++++++++++

[ 47.537030] cloud-init[712]: ci-info: +-------+-------------+---------+-----------+-------+

[ 47.538039] cloud-init[712]: ci-info: | Route | Destination | Gateway | Interface | Flags |

[ 47.539049] cloud-init[712]: ci-info: +-------+-------------+---------+-----------+-------+

[ 47.540095] cloud-init[712]: ci-info: | 1 | fe80::/64 | :: | ens3 | U |

[ 47.541153] cloud-init[712]: ci-info: | 3 | local | :: | ens3 | U |

[ 47.542222] cloud-init[712]: ci-info: | 4 | ff00::/8 | :: | ens3 | U |

[ 47.543259] cloud-init[712]: ci-info: +-------+-------------+---------+-----------+-------+

[ 47.544287] cloud-init[712]: 2022-06-06 09:10:41,314 - util.py[WARNING]: No active metadata service found

[[0;32m OK [0m] Stopped Wait for Network to be Configured.

Привет ! проблема похоже общая и связана она с тем, что не доходят пакетики от ВМки до сервера, где живут сервисы (агенты) метаданных и DHCP. Перетащив DHCP агент на компьюту, ты возможно обеспечил сетевую доступность между ВМкой и DHCP агентом. Неработоспособность сервиса метаданных - это очень вероятно продолжение (следствие) этой же проблемы с тем, что пакетики не доходят.

Ilya

Ilya

На первом этапе траблшуттинга нужно посмотреть, что при запуске ВМки, пакеты с запросом DHCP ,будут видны на контроллере, где живёт DHCP агент. Если пакетиков не видно - иди на компьюту где стартует ВМка и проверь что видишь исходящие пакетики на сетевой карте компьюты с DHCP. Если видишь данные пакеты - значит проблема в сетевой связности между компьютой и контроллером. Если исходящих пакетов на компьюте нет - значит что-то с настройками виртуальной сетевой инфры на компуте (тапка ВМки воткнута не в тот бридж и т.д.)

Stanley

Stanley

а я правильно понимаю, что видосики с саммита онлайн не транслируют?

Может кого попросить хотя бы интересные моменты сюда постить?

Dmitry

Dmitry

Всем привет. Подскажите, в опенстек, как компут апи проводит валидацию , с какой ос образ и как юзер дату пробрасывать? Клауд инит там или что-то виндовое

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Stanley

Stanley

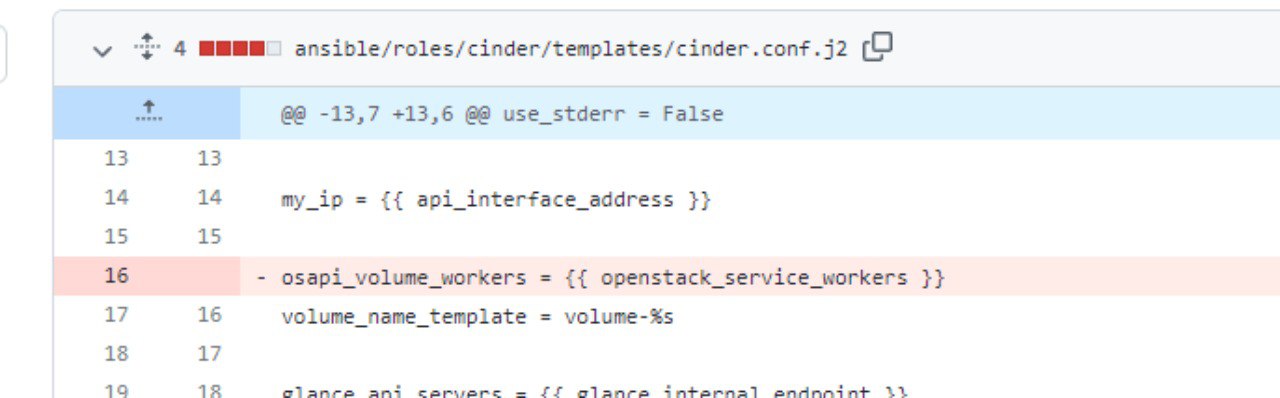

В июньском соммите из Колла выпилили параметр osapi_volume_workers. Кто либо знает почему? Коммент какой то невнятный (или я его не понял).

NS 🇷🇺

NS 🇷🇺

В июньском соммите из Колла выпилили параметр osapi_volume_workers. Кто либо знает почему? Коммент какой то невнятный (или я его не понял).

а не смотрели, может они на конфигурацию контенеров это пложили, это же параметр, если явно не указан, расчитывается стеком

Stanley

Stanley

а не смотрели, может они на конфигурацию контенеров это пложили, это же параметр, если явно не указан, расчитывается стеком

Я особо не копал, но возможно. Просто увидел, что выпилили, стало интересно почему. Хотел уже этому Мише из Праги гневное письмо писать. :)

Fedor

Fedor

В июньском соммите из Колла выпилили параметр osapi_volume_workers. Кто либо знает почему? Коммент какой то невнятный (или я его не понял).

This patch is removing api related configuration

from service's config files as we are using

apache mod_wsgi and this configuration is not

used.

Stanley

Stanley

This patch is removing api related configuration

from service's config files as we are using

apache mod_wsgi and this configuration is not

used.

Именно этот коммент я и не понял. :)

Stanley

Stanley

коллектив имеет в виду, скорее всего, что теперь апач множит треды, а не питон

А, вот уже понятней. Но как то странно, оставлять параметр в Йоге, но выпиливать из Колла

Fedor

Fedor

А, вот уже понятней. Но как то странно, оставлять параметр в Йоге, но выпиливать из Колла

почему? это ж опенсорс, вдруг ты не хочешь ставить апачу?

Stanley

Stanley

а не смотрели, может они на конфигурацию контенеров это пложили, это же параметр, если явно не указан, расчитывается стеком

А где можно глянуть про "рассчитывается стеком"? В доке: By default, the Block Storage API service runs in one process

Stanley

Stanley

почему? это ж опенсорс, вдруг ты не хочешь ставить апачу?

Видимо наоборот, вынужден ставить апач, если я правильно смог в осознании коммента к коммиту. Хорошо, ушел копать дальше, а то мне все же непонятны некоторые моменты...

NS 🇷🇺

NS 🇷🇺

А где можно глянуть про "рассчитывается стеком"? В доке: By default, the Block Storage API service runs in one process

по дефолту он у тебя запускает то ли равное кол-во процессоров, толи половину

Stanley

Stanley

по дефолту он у тебя запускает то ли равное кол-во процессоров, толи половину

Вот увидеть бы это в виде доки. Потому что пока вижу только что дефолт = 1

Stanley

Stanley

Пока пил чай, покопал доку на mod_wsgi. Может работать в виде демона и если я правильно понимаю, то Федор прав и теперь будут пулять через него. Нюансы в том, что во первых, проект еще сильно в стадии развития, а во вторых, появляется еще один слой настройки самого демона mod_wsgi (если там демон, конечно же). Пока выглядит странно, но может и правда быстрее, лучше, сильнее...

Fedor

Fedor

Пока пил чай, покопал доку на mod_wsgi. Может работать в виде демона и если я правильно понимаю, то Федор прав и теперь будут пулять через него. Нюансы в том, что во первых, проект еще сильно в стадии развития, а во вторых, появляется еще один слой настройки самого демона mod_wsgi (если там демон, конечно же). Пока выглядит странно, но может и правда быстрее, лучше, сильнее...

вы про какой проект? mod_wsgi старый как хрен пойми что

Stanley

Stanley

вы про какой проект? mod_wsgi старый как хрен пойми что

Воу, воу. :) я всего лишь опираюсь на оф доку. Где написано про стадию развития

NS 🇷🇺

NS 🇷🇺

Вот увидеть бы это в виде доки. Потому что пока вижу только что дефолт = 1

Ну ебушки воробушки, прям в cinder.conf

NS 🇷🇺

NS 🇷🇺

Number of workers for OpenStack Volume API service. The default is equal to

# the number of CPUs available. (integer value)

#osapi_volume_workers = <None>

Al

Al

Господа. Требуется помощь.

Имеются тестовые кластеры CEPH pacific и openstack yoga развернутый через kolla.

Сейф разворачивался отдельно и является прототипом другого кластера, который исправно работает с более старой версией опенстека.

Пробелам следующая: при поднятии инстанса из образа он ни вкакую не хочет бутиться с рбд. В логах всех чисто. Авторизация в ceph проходит успешно. Причем вольютмы выключенной ВМ успешно монтируются через rbd map в контейнере libvirt-a. Содержимое доступно. Ключи в libvirt-e тоже верные и пользователь имеет право к пулу с образом.

Для диагностики даже руками создал тестовую ВМ в kvm в контейнере одного из compute.

https://pastebin.com/AMc6SjXJ

В запущенной ВМ проверяю подключенные диски:

# virsh qemu-monitor-command --hmp test info blockstats

: rd_bytes=0 wr_bytes=0 rd_operations=0 wr_operations=0 flush_operations=0 wr_total_time_ns=0 rd_total_time_ns=0 flush_total_time_ns=0 rd_merged=0 wr_merged=0 idle_time_ns=0

# virsh qemu-monitor-command --hmp test info block

libvirt-1-format: json:{"driver": "raw", "file": {"pool": "volumes", "image": "volume-6a8cc678-a5a9-4185-9f62-b109ecf6b708", "server.0.host": "10.163.1.226", "server.1.host": "10.163.1.232", "server.2.host": "10.163.1.233", "driver": "rbd", "server.0.port": "6789", "server.1.port": "6789", "server.2.port": "6789", "user": "cinder"}} (raw)

Attached to: /machine/peripheral/virtio-disk0/virtio-backend

Cache mode: writeback, direct

Не желает бутить вольюм с RBD. В консоли ВМ имеем всегда:

Booting from Hard Disk…

Boot failed: could not read the boot disk

По логам ceph, опенстека, либвирта все чисто. При запуске руками qemu с заранее вытащенным master-key-ем тоже самое.

Подскажите куда копать дальше, куда смотреть. Уже больше нет идей где найти проблему.

Al

Al

Да. Имеет. Образы успешно создаются глансом в сейфе. При создании ВМ успешно делается создается образ ВМ.

NS 🇷🇺

NS 🇷🇺

Да. Имеет. Образы успешно создаются глансом в сейфе. При создании ВМ успешно делается создается образ ВМ.

Посмотрите а содержит ли образ в гленс реально данные

Ilya

Ilya

John Roe

John Roe