Fedor

Fedor

Я не залетный, просто тема общая + из свежего

с этим в linkmeup или ntwrk, опенстек на циске по-моему в России так никто и не построил

Aleksandr

Aleksandr

с этим в linkmeup или ntwrk, опенстек на циске по-моему в России так никто и не построил

Да, только ещё есть UCS

Vyacheslav

Vyacheslav

Andrey

Andrey

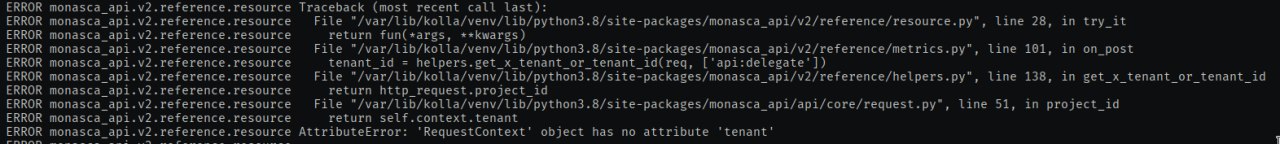

Подскажите, что делать c эластиком, который колла поставила.

Эластик стоит на контролах со всеми остальными сервисами на одном диске. Когда места на диске мало, то эластик переводит индекс в read-only и куратор не может удалить старые индексы. Когда место освобождается, то эластик сам не возвращает в read-write и уже эластик забивает диск.

Приходится руками разрешать удаление и потом куратор может чистить.

curl -X PUT -H "Content-Type: application/json" http://172.....:9200/_all/_settings -d '{"index.blocks.read_only_allow_delete": null}'

elasticsearch-6.8.20.jar:6.8.20

Ошибки куратора

2022-03-04 16:50:32,974 INFO Closing 6 selected indices: ['flog-2022.02.22', 'flog-2022.02.27', 'flog-2022.02.24', 'flog-2022.02.26', 'flog-2022.02.25', 'flog-2022.02.23']

2022-03-04 16:50:33,008 ERROR Failed to complete action: close. <class 'curator.exceptions.FailedExecution'>: Exception encountered. Rerun with loglevel DEBUG and/or check Elasticsearch logs for mor

e information. Exception: AuthorizationException(403, 'cluster_block_exception', 'blocked by: [FORBIDDEN/12/index read-only / allow delete (api)];')

Как гарантированно можно удалять старые индексы?

Убрать вот прям сейчас эластик не могу на сторонний сервер.

Artemy

Artemy

Правильный вопрос подразумевает половину ответа. Если у вас не хватает диска - вам нужно поставить диск большего размера.

J

J

Andrey

Andrey

Предлагаю политики поправить чтоб делался rollover интересующих тебя индексов по времени\объему.

Куратор делает это, но проблема в read-only или совет про другое?

Andrey

Andrey

Правильный вопрос подразумевает половину ответа. Если у вас не хватает диска - вам нужно поставить диск большего размера.

Я это понимаю и сразу написал в последней строке, не могу я этого сейчас сделать.

J

J

Куратор делает это, но проблема в read-only или совет про другое?

Совет про то что у тебя не хватает места и политику ролловера индексов надо пересмотреть так чтобы не доводить до заканчивающегося места.

Andrey

Andrey

Совет про то что у тебя не хватает места и политику ролловера индексов надо пересмотреть так чтобы не доводить до заканчивающегося места.

rollover - это альтернатива куратору для удаления старых индексов?

J

J

rollover - это альтернатива куратору для удаления старых индексов?

Это фишка index lifecycle management.

https://www.elastic.co/guide/en/elasticsearch/client/curator/current/about-features.html

Вообще я как следует не смогу посоветовать, наверное, потому что у меня opendistro от амазона. Он немножко другой)

Рамиль

Рамиль

ilp имеет возможности куратора и еще плюшечки. если у вас еластик не ниже 6.8, то лучше использовать ilp

J

J

Ну и коллой не пользовался никогда, поэтому хз как именно там куратор настраивается.

Ваще через политики все довольно нехитро выглядит.

https://www.elastic.co/guide/en/elasticsearch/reference/current/ilm-put-lifecycle.html

Andrey

Andrey

Рамиль

Рамиль

именно 6.8

ну вот и хорошо))

https://www.elastic.co/guide/en/elasticsearch/reference/6.8/getting-started-index-lifecycle-management.html

Andrey

Andrey

ilp имеет возможности куратора и еще плюшечки. если у вас еластик не ниже 6.8, то лучше использовать ilp

Накинуть политику можно на существующий индекс?

Yuf

Yuf

ilm стабильный завезли в 6.8. до этого все использовали куратор или самопал

У нас на 7 елк тоже нормально не прошло. Пришлось вернутся обратно на куратор. Может его приготовить не смогли.

Andrey

Andrey

У нас на 7 елк тоже нормально не прошло. Пришлось вернутся обратно на куратор. Может его приготовить не смогли.

И меня послал эластик, при создании полиси.

96eae59ecc096eb98e63cbe

96eae59ecc096eb98e63cbe

Pavel

Pavel

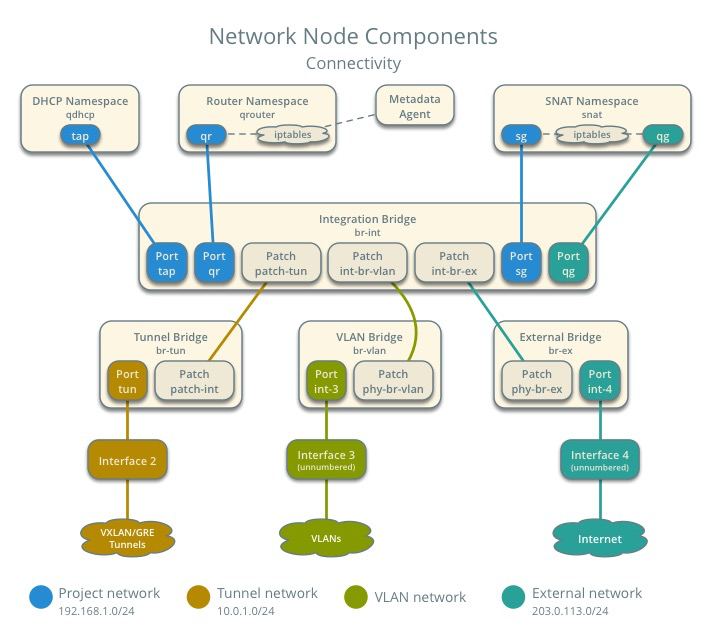

Народ, поскажите по нейтрон-овёс:

1. l3_ha = False

2. DVR включен

3. Создаём свежий роутер, втыкаем в тенант сетку + external

Смотрим

neutron l3-agent-list-hosting-router 90abf7cf-949e-4c0c-b456-cc8c7ef49279

+--------------------------------------+-------+----------------+-------+----------+

| id | host | admin_state_up | alive | ha_state |

+--------------------------------------+-------+----------------+-------+----------+

| eebc25da-e9e8-4b0c-8e7d-9f401563a5a3 | gtw02 | True | 🙂 | |

Валидно, зашедулилось на один l3 агент на одной neutron network ноде, `ha_state = None`

Смотрим неймспейсы:

(lon1) root@cfg01:~$ salt "gtw*" cmd.run "ip netns ls | grep 90abf7cf-949e-4c0c-b456-cc8c7ef49279"

gtw03.privatecloud.lon1.prod.customer.com:

qrouter-90abf7cf-949e-4c0c-b456-cc8c7ef49279 (id: 464)

gtw02.privatecloud.lon1.prod.customer.com:

qrouter-90abf7cf-949e-4c0c-b456-cc8c7ef49279 (id: 379)

snat-90abf7cf-949e-4c0c-b456-cc8c7ef49279 (id: 378)

gtw01.privatecloud.lon1.prod.customer.com:

qrouter неймспейс и порты создались на двух

Вопрос - wtf? Какой механизм создает qrouter ns на лишней ноде?

Pavel

Pavel

Сам вопрос растёт от того что мы приближаемся к лимиту 1500 портов на нетворк нод, после которого ovsdb начинает себя плохо вести (выявлено нагрузочным тестированием)

Илья | 😶☮️🐸

Илья | 😶☮️🐸

J

J

А DVR разве не для того, чтобы роутеры жили везде, а не только на network node?

Так тут получается что на двух network серверах.

По идее то без HA должен быть один qrouter там где делается snat и по одному на каждом гипервизоре где виртуалкам он нужен.

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Так тут получается что на двух network серверах.

По идее то без HA должен быть один qrouter там где делается snat и по одному на каждом гипервизоре где виртуалкам он нужен.

Странные странности. Я склонялся что DVR как раз чтобы избавиться от netwrork серверов и подубавить точек отказа у сети

Pavel

Pavel

Странные странности. Я склонялся что DVR как раз чтобы избавиться от netwrork серверов и подубавить точек отказа у сети

ты от network нод избавиться не можешь, там снат

J

J

Странные странности. Я склонялся что DVR как раз чтобы избавиться от netwrork серверов и подубавить точек отказа у сети

Так и есть.

Но в DVR SNAT для приватных сетей всес еще централизованный.

Pavel

Pavel

The DVR architecture augments the classic architecture by providing direct connectivity to external networks on compute nodes. For instances with a floating IP address, routing between project and external networks resides completely on the compute nodes to eliminate single point of failure and performance issues with classic network nodes.

Routing also resides completely on the compute nodes for instances with a fixed or floating IP address using project networks on the same distributed virtual router.

However, instances with a fixed IP address still rely on the network node for routing and SNAT services between project and external networks.

Илья | 😶☮️🐸

Илья | 😶☮️🐸

J

J

я пойду тогда врубать трейслог на нетворк нодах 🙂

Дык сразу надо было, наверн)

Разве что, ты забыл и у тебя нетворк нода еще и гипервизор)

Pavel

Pavel

Неужели нету никаких фич, чтобы DVR вовсе не требовал network серверов ?

contrail называется, кек

J

J

Неужели нету никаких фич, чтобы DVR вовсе не требовал network серверов ?

Угу.

contrail умеет, мож и еще чо-то.

dragonflow давно хотели сделать, но хз вообще в каком там состоянии проект)

Pavel

Pavel

Den

Den

NS 🇷🇺

NS 🇷🇺

Owl

Owl

Monsieur

Monsieur