Нигде не пишутся.

На роутере включается snat и всё.

Я сделаль.

Stepan T.

Stepan T.

Проблема была в следующем. Я в роутер руками добавлял порт с IP из сети, которую мне выдал сетевой админ. А нужно было этого не делать, а нажать на кнопку создать шлюз. Он подставляет порту роутера адрес из диапазона IP указанных в разделе про DHCP, там происходит какая-то магия и трафик из виртуалки начинает ходить в интернет.

Aleksey

Aleksey

многие же делают https терминейшен на каком-нибудь прокси, а на самих сервисах https не настраивают ?

Aleksey

Aleksey

у меня сейчас странное поведение, я похоже уперся в osapi_max_limit = 1000 после чего второй запрос почему-то идёт уже на http

Stepan T.

Stepan T.

многие же делают https терминейшен на каком-нибудь прокси, а на самих сервисах https не настраивают ?

Reverse proxy. На базе NGINX или HAProxy обычно.

Aleksey

Aleksey

похоже должно решиться через #public_endpoint = <None>

по крайней мере по коду они именно его проверяют

Andrey

Andrey

Пытаюсь ограничить агрегат, взял команду из доки.

Что-то пошло не так. Есть какие идеи?

openstack: '--os-placement-api-version=1.2 resource provider aggregate set --aggregate ea1c8d76-4526-4439-8fe7-f3ab2adfe9bf 77f6400f-e62b-4976-84c2-36a3bac4e57f' is not an openstack command. See 'openstack --help'.

Клиент

openstack --version

openstack 5.5.0

Стек Victoria

NS 🇷🇺

NS 🇷🇺

Andrey

Andrey

Задача какая,я чёт не понял

Хочу в агрет разрешить(запретить) ходить тенанту.

https://docs.openstack.org/nova/latest/admin/aggregates.html#tenant-isolation-with-placement

Я не могу понять, почему клиент не знает команды resource provider

Такое ощущение, что нужно доставить пакет для работы клиента.

J

J

Разобрался

pip install osc-placement

Ну да.

Сам опенстек клиент это ж обертка вокруг кучи отдельных клиентов.

Maksimus Ulibikus

Maksimus Ulibikus

Всем привет.

На controller создал 3 сабинтерфейса

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

inet 127.0.0.1/8 scope host lo

valid_lft forever preferred_lft forever

inet6 ::1/128 scope host

valid_lft forever preferred_lft forever

2: ens224: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc mq state UP group default qlen 1000

link/ether 00:50:56:b6:d6:36 brd ff:ff:ff:ff:ff:ff

inet 192.168.10.198/24 brd 192.168.10.255 scope global noprefixroute ens224

valid_lft forever preferred_lft forever

inet6 fe80::250:56ff:feb6:d636/64 scope link

valid_lft forever preferred_lft forever

3: ens256: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc mq state UP group default qlen 1000

link/ether 00:50:56:b6:9b:e6 brd ff:ff:ff:ff:ff:ff

4: ens256.192@ens256: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue master brqda043c80-50 state UP group default qlen 1000

link/ether 00:50:56:b6:9b:e6 brd ff:ff:ff:ff:ff:ff

inet6 fe80::250:56ff:feb6:9be6/64 scope link

valid_lft forever preferred_lft forever

5: ens256.175@ens256: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue master brq713e3b97-0e state UP group default qlen 1000

link/ether 00:50:56:b6:9b:e6 brd ff:ff:ff:ff:ff:ff

inet6 fe80::250:56ff:feb6:9be6/64 scope link

valid_lft forever preferred_lft forever

6: ens256.172@ens256: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue master brqb1b506d5-57 state UP group default qlen 1000

link/ether 00:50:56:b6:9b:e6 brd ff:ff:ff:ff:ff:ff

inet6 fe80::250:56ff:feb6:9be6/64 scope link

valid_lft forever preferred_lft forever

На контроллере в /etc/neutron/plugins/ml2/linuxbridge_agent.ini

[linux_bridge]

physical_interface_mappings = vlan175:ens256.175,vlan172:ens256.172,vlan192:ens256.192

На compute в /etc/neutron/plugins/ml2/linuxbridge_agent.ini:

[linux_bridge]

physical_interface_mappings = vlan175:enp1s0f1

Дебаг везде включен, ни одного ERROR нет. Не могу сообразить где искать проблему.

J

J

J

J

Удали все сабинтерфейсы, оставь одну физическую сеть типа flat и поверх неё создавай в нейтроне уже сети с vlan инкапсуляцией.

Maksimus Ulibikus

Maksimus Ulibikus

И ты не написал в чем проблема, собственно.

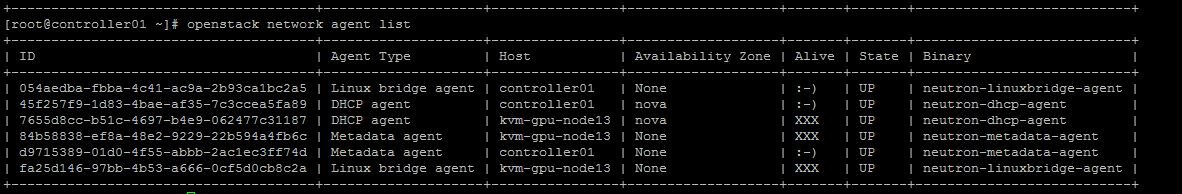

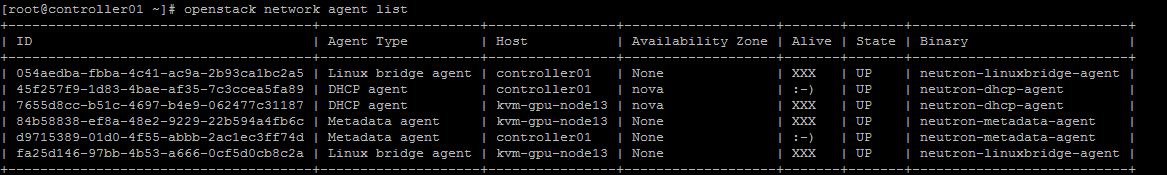

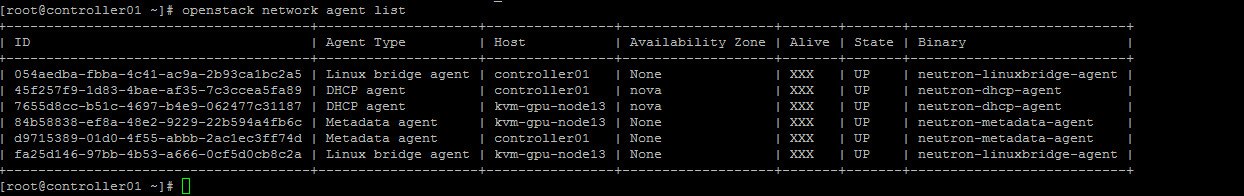

Проблема в том, что статус в Alive XXX

Zloi

Zloi

Народ, пытаюсь развернуть kolla-ansible\openstack:victoria .. пречек проходит.. а вот на деплое заваливается ..

TASK [nova-cell : Waiting for nova-compute services to register themselves]

Zloi

Zloi

сам еонтейнер постоянно

kolla/ubuntu-source-nova-compute:victoria "dumb-init --single-…" 7 minutes ago Restarting (0) 36 seconds ago

Zloi

Zloi

в лога контейнера

INFO:main:Setting permission for /var/lib/nova/.cache/python-entrypoints/21282ebccbea194e79535516ed75c603d02503ec025a68798a00326ffa2318f6

++ cat /run_command

+ CMD=nova-compute

+ ARGS=

+ sudo kolla_copy_cacerts

+ [[ ! -n '' ]]

+ . kolla_extend_start

++ [[ ! -d /var/log/kolla/nova ]]

+++ stat -c %a /var/log/kolla/nova

++ [[ 2755 != \7\5\5 ]]

++ chmod 755 /var/log/kolla/nova

++ . /usr/local/bin/kolla_nova_extend_start

+++ [[ ! -d /var/lib/nova/instances ]]

+ echo 'Running command: '\''nova-compute'\'''

+ exec nova-compute

Running command: 'nova-compute'

Maksimus Ulibikus

Maksimus Ulibikus

Так смотри логи агентов чо они там пишут.

Удалил сабинтерфейсы.

В /etc/neutron/plugins/ml2/linuxbridge_agent.ini

[linux_bridge]

physical_interface_mappings = provider:ens256

В /etc/neutron/plugins/ml2/ml2_conf.ini

[ml2]

type_drivers = flat,vlan

tenant_network_types =

mechanism_drivers = linuxbridge

extension_drivers = port_security

[ml2_type_flat]

flat_networks =

[ml2_type_vlan]

network_vlan_ranges = ens256:192:192,ens256:172:172,ens256:175:175

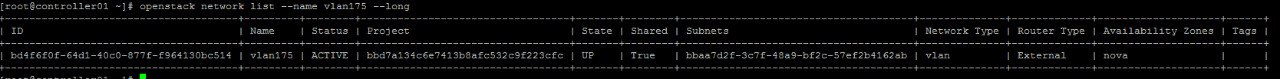

Пробую:

openstack network create --share --external \

--provider-physical-network provider \

--provider-network-type vlan \

--provider-segment 175 provider

Получаю ошибку:

Error while executing command: BadRequestException: 400, Invalid input for operation: network_type value 'vlan' not supported.

Не пойму, почему vlan не поддерживается, если type_drivers = flat,vlan

Maksimus Ulibikus

Maksimus Ulibikus

Перезагрузил ноду, теперь при попытки создать Invalid input for operation: physical_network 'provider' unknown for VLAN provider network

Maksimus Ulibikus

Maksimus Ulibikus

Перезагрузил ноду, теперь при попытки создать Invalid input for operation: physical_network 'provider' unknown for VLAN provider network

С этим разобрался. Надо указывать имя интерфейса:

openstack network create --no-share --internal \

--provider-physical-network ens256 \

--provider-network-type vlan \

--provider-segment 192 vlan192

Но что-то с Linux bridge agent. ALIVE в статусе XXX

Ask

Ask

Коллеги, можно ли применить один и тот же флевор к вм уже созданном, просто изменив методанные?ресайз требует другого флевор. Приходиться на левый флевор переключаться, а потом обратно.

Vyacheslav

Vyacheslav

Maksimus Ulibikus

Maksimus Ulibikus

Ребята, кто-нибудь может помочь. Второй день не получается разобраться с VLANами.

На controller:

NIC ens256 на транковом порту (vlan 172, 175, 192)

[root@controller01 ~]# cat /etc/sysconfig/network-scripts/ifcfg-ens256

TYPE=Ethernet

PROXY_METHOD=none

BROWSER_ONLY=no

IPV6INIT=no

NAME=ens256

BOOTPROTO=none

UUID=51bee429-7742-3453-925f-779824a7e3b1

DEVICE=ens256

ONBOOT=yes

AUTOCONNECT_PRIORITY=-999

IPV6_DISABLED=yes

/etc/neutron/plugins/ml2/ml2_conf.ini

[ml2]

type_drivers = flat,vlan

tenant_network_types =

mechanism_drivers = linuxbridge

extension_drivers = port_security

[ml2_type_flat]

flat_networks = ens256

[ml2_type_vlan]

network_vlan_ranges = ens256:172:192

[securitygroup]

enable_ipset = true

/etc/neutron/plugins/ml2/linuxbridge_agent.ini

[linux_bridge]

physical_interface_mappings = ens256:ens256

[vxlan]

enable_vxlan = false

[securitygroup]

enable_security_group = true

firewall_driver = neutron.agent.linux.iptables_firewall.IptablesFirewallDriver

На compute:

NIC enp1s0f1 на access порту vlan175.

[root@kvm-gpu-node13 ~]# cat /etc/sysconfig/network-scripts/ifcfg-enp1s0f1

TYPE=Ethernet

PROXY_METHOD=none

BROWSER_ONLY=no

BOOTPROTO=none

IPV6INIT=no

NAME=enp1s0f1

UUID=b50257dd-3d41-3684-932e-4d70e3823f47

DEVICE=enp1s0f1

ONBOOT=yes

/etc/neutron/plugins/ml2/ml2_conf.ini

[linux_bridge]

physical_interface_mappings = ens256:enp1s0f1

[vxlan]

enable_vxlan = false

[securitygroup]

enable_security_group = true

firewall_driver = neutron.agent.linux.iptables_firewall.IptablesFirewallDriver

В итоге ALIVE в статусе XXX

Vyacheslav

Vyacheslav

When resizing, instances must change flavor. Ошибку выдает.

В два захода делай - меняй на случайный и возвращай на нужный

Ask

Ask

В два захода делай - меняй на случайный и возвращай на нужный

Понял, ну в общем я это и описал. Значит нельзя сразу. Надеялся, что есть некий ключ форсирования

Aleksey

Aleksey

Aleksey

Aleksey

если надо добавить в уже созданную vm

ну я к тому что если в конечном итоге данные добавляются в мету ВМ, то может проще мету поменять, для существующих, а новые пусть через флейвор

Vyacheslav

Vyacheslav

вангую что базюлька + hard reboot

ну тут был вариант сделать flavor с такой property и без базы решить

Aleksey

Aleksey

ну тут был вариант сделать flavor с такой property и без базы решить

ну 2й ресайз не нравится, базюлька с хард ребутом не нравится….

ещё скажите что вам не нравится OpenStack

J

J

ну тут был вариант сделать flavor с такой property и без базы решить

Так и сделать. Флейвор создать и на него ресайзнуть)

Но это в любом случае потребует цикла выключения\включения

J

J

Без выключения\включения в любом случае никак, нужно чтоб qemu-kvm процесс виртуалки перезапустился с новыми аргументами.

Vyacheslav

Vyacheslav

.

.

Всем доброго времени суток, есть какие нибудь надеждные opensource billing solutions для стэка? Мне для презентации нужно

Я и твой кот

Я и твой кот

А готовых опенсорсных и при этом бесплатных, вроде, нет.

Но это ж опенсорс. @tmkfp , всегда можно написать свой опенсорсный биллинг.

Andrey

Andrey

Вм не создается в одном тенанте, получаю “No valid host was found”

Не могу понять на каком фильтре меня выкидыват. Может не туда смотрю

Логи из nova-scheduler

https://pastebin.com/jnS3JrQZ

J

J

Но это ж опенсорс. @tmkfp , всегда можно написать свой опенсорсный биллинг.

Поэтому никто и не жалуется)

Andrey

Andrey

Вм не создается в одном тенанте, получаю “No valid host was found”

Не могу понять на каком фильтре меня выкидыват. Может не туда смотрю

Логи из nova-scheduler

https://pastebin.com/jnS3JrQZ

Проблема была связана с ограничение агрегата для тенанта. Добавил в два агрегата

openstack aggregate set --property filter_tenant_id='d7b9000ada4a467e8c0d7728574e13aa'

и получил то что получил.

С одним агрегатом работает. Я наверное что-то не понял в работе. Надо перечитать доку и на стенд идти.

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Как можно ограничить кол-во одновременно создаваемых вм?

для проекта урезать как вариант

Andrey

Andrey

Для всех сразу?

Да, вроде был параметр для шудулера, чтобы порциями создавались, а не сразу 100вм

Andrey

Andrey

Может кто сталкивался?

Создаю 50 вм с локальными дисками(nova) и у меня гланс начинает мандить.

1469 ERROR glance.location [……. - default default]

Glance tried all active locations to get data for image 79f3789c-f708-41ba-b9bc-38745c392f79 but all have failed.

Гланс на цефе. Такая проблему нету если вм создаются цефе.

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Может кто сталкивался?

Создаю 50 вм с локальными дисками(nova) и у меня гланс начинает мандить.

1469 ERROR glance.location [……. - default default]

Glance tried all active locations to get data for image 79f3789c-f708-41ba-b9bc-38745c392f79 but all have failed.

Гланс на цефе. Такая проблему нету если вм создаются цефе.

а коннект к цефу не теряется в момент создания ?

Andrey

Andrey

а коннект к цефу не теряется в момент создания ?

Такая же мысль, но как проверить не знаю. Думаю образ начинает скачиваться на множетво компутов одновременно и тут может вылезти не хорошее.

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Как образ попадает на компут, когда диски делает нова?

ну так-то образ на компуте может закэшироваться, механизмы для этого есть

Алексей

Алексей

Pavel

Pavel