по чесноку не видел чудаков которые в lxc опенстэк запускали ))) видел которые в непривелигерованном lxc кубер запускали ))) сам ядро для этого патчил в рамблере -)

Ну так то это особо ничем не отличается от подхода когда разные сервисы по разным хостам разносят. lxc дедам и ортодоксам удобнее и привычнее, потому что это "machine container", типа полноценный линукс внутри контейнера и без всяких слоёв и сложной архитектуры сети.

Ну ты глянь openstack-ansible

https://docs.openstack.org/openstack-ansible/latest/

По LXC контейнеру на КАЖДЫЙ сервис это перебор, конечно. А в остальном - почему б и нет.

Aleksandr

Aleksandr

Ну так то это особо ничем не отличается от подхода когда разные сервисы по разным хостам разносят. lxc дедам и ортодоксам удобнее и привычнее, потому что это "machine container", типа полноценный линукс внутри контейнера и без всяких слоёв и сложной архитектуры сети.

Ну ты глянь openstack-ansible

https://docs.openstack.org/openstack-ansible/latest/

По LXC контейнеру на КАЖДЫЙ сервис это перебор, конечно. А в остальном - почему б и нет.

вместо него юзают kolla-ansible -)) поднять в lxc девстэк я тоже так делал, что бы не мусорить в основе -) но это чусто девелоперское

J

J

вместо него юзают kolla-ansible -)) поднять в lxc девстэк я тоже так делал, что бы не мусорить в основе -) но это чусто девелоперское

Ну да. С тем чтоб деплоить в докере только одна неприятность, что если тебе нужно чо-то поправить в паре питоновских модулей в потрохах опенстека, то придется пересобирать образ контейнера целиком, а не просто файлики в контейнерах обновлять.

Aleksandr

Aleksandr

Aleksandr

Aleksandr

я когда последний раз былокодил для опенстэка тоже LXC с убунтой поднимал, что бы не париться с венвами и что у меня федора. это рили удобно -)))

J

J

я когда последний раз былокодил для опенстэка тоже LXC с убунтой поднимал, что бы не париться с венвами и что у меня федора. это рили удобно -)))

Ну вот, щас на смену LXC каноникал LXD сделал. В целом хорошо сделали и здорово, таким и должен был быть LXC.

Но чо-то мерзавцы свернули не туда и щас вместо легковесного "контейнерного гипервизора" начали пилить свою замену libvirt, похоже)

Aleksandr

Aleksandr

Ну вот, щас на смену LXC каноникал LXD сделал. В целом хорошо сделали и здорово, таким и должен был быть LXC.

Но чо-то мерзавцы свернули не туда и щас вместо легковесного "контейнерного гипервизора" начали пилить свою замену libvirt, похоже)

lxd это гошная надстройка с рест апи над lxc -) они даже в https://github.com/lxc/lxd

J

J

lxd это гошная надстройка с рест апи над lxc -) они даже в https://github.com/lxc/lxd

Ага. А lxc надстройка на д cgroups + netns + user namespaces.

Как бы то ни было, удобная штука.

J

J

это да -) ну докер более удобно это упаковал -) вот и взлетел а на его основе кубер -)

Ну потому что оказалось что людям в основном нужны app контейнеры, а не полноценная система.

Интересный парадокс, как так. Спрос на виртуальные машины не падает чо-то, даже на линуксовые или bsdшные, не говоря о винде. То есть, полноценная изолированная ОС все еще нужна народу. А вот спроса на machine контейнеры почти нет, всем подавай контейнерные оркестраторы и app контейнеры.

J

J

А то каждый год "Опенстек и вирутализацию хоронили, порвали два баяна".

А спрос на виртуалки и IaaS все никак не упадет.

Й

Й

А то каждый год "Опенстек и вирутализацию хоронили, порвали два баяна".

А спрос на виртуалки и IaaS все никак не упадет.

Так и не похоронят жи. Зачем это все "добро" тащить в оркестратор контейнеров? Оно есть и здорово и все этим пользуются. Просто, без этой прослойки тяжко от слова совсем. Говорю как хлебнувший менеджмент кубера поверх бареметал. Сплошные боль и страдания

Й

Й

Просто контейнеры наконец-то добрались до сути вот этой всей матрёшки из абстракций которая всем и была нужна - до приложений. Они помогают изолировать приложение! а не ос, драйверы и прочую машинерию которая разработчикам и нафик "не нужна". Имхо вот поэтому эта тема так взлетела и не падает

Михаил

Михаил

Aleksey

Aleksey

Jain

Jain

Да норм кубер поверх бареметал.

Я вот тоже плюсану. Деплоил, деплою и буду деплоить куб на бареметал. Стабильно, и что самое главное: на 100% предсказуемо.

Aleksey

Aleksey

Й

Й

А можно кейсов с проблемами кубера на баре?

Отсутствие вменяемых сторейджей, балансеров, фаерволов, менеджмент сетей и ip адресов. Все вышеназванное вы колхозите сами. Возможно, что-то можно прикупить у провайдера, но оно будет чуть-чуть не таким как вы ожидали и снова вам придется писать какие-то костыли/обертки чтобы вписать это в свою инфру

Aleksey

Aleksey

Отсутствие вменяемых сторейджей, балансеров, фаерволов, менеджмент сетей и ip адресов. Все вышеназванное вы колхозите сами. Возможно, что-то можно прикупить у провайдера, но оно будет чуть-чуть не таким как вы ожидали и снова вам придется писать какие-то костыли/обертки чтобы вписать это в свою инфру

- Балансеры для чего?

- Локал стор, ну или любая другая sds или хранилка? Мы что только не подключали, даже с дорадой работало.

- что есть менеджмент сетей? В смысле что надо самому в компанейском ипам сетки нарезать?

Aleksey

Aleksey

И да, фаервол? Между подами? Таки есть cilium и прочее чтобы политиками фильтровать трафик между подами.

Aleksey

Aleksey

Речь о трафике из мира

Ну таки ингрессы. Какой хочешь такой и пользуешь. Мы вот траефик прикрутили.

Jain

Jain

С calico можно не только Policy для подов писать. Для хостов тоже все работает. Стандартный deny-all м потом allowиться только то, что нужно из/в мир по портам, ИП, итд

Й

Й

- Балансеры для чего?

- Локал стор, ну или любая другая sds или хранилка? Мы что только не подключали, даже с дорадой работало.

- что есть менеджмент сетей? В смысле что надо самому в компанейском ипам сетки нарезать?

Про сети - я не знаю как можно вообще сравнивать SDN и бареметал, без запинывания бареметала)

Jain

Jain

У меня сотни нод бареметал на кубе. Я не заметил разницы написание Rules для Juniper SRX или calico

Aleksey

Aleksey

Я же говорю, что колхозить все добро нужно самому) Велосипедостроение оно такое. Все нужно самому

Ну извините, ещё и ямлы за вас писать?

Aleksey

Aleksey

Вы же сами спросили. Я ответил. К чему тут переход на личности?

Ок, спасибо. Не хотел на личности, просто показались не убедительными доводы

Й

Й

Ок, спасибо. Не хотел на личности, просто показались не убедительными доводы

Все Ок) Я и не прентендую на истину в последней инстанции. Я поделился своей болью от железок и радостью спрыгивания с этого добра в облако

NS 🇷🇺

NS 🇷🇺

Ну таки ингрессы. Какой хочешь такой и пользуешь. Мы вот траефик прикрутили.

Не ингресом единым )

Й

Й

Ок, мне тоже интересно стало. А чем облака вам помогут в конфигурации?

Единым API и всеми теми штуками о которых я говорил выше, которые управляются при помощи этого API. Опять таки благодаря унификации на рынке больше спецов

Nikita

Nikita

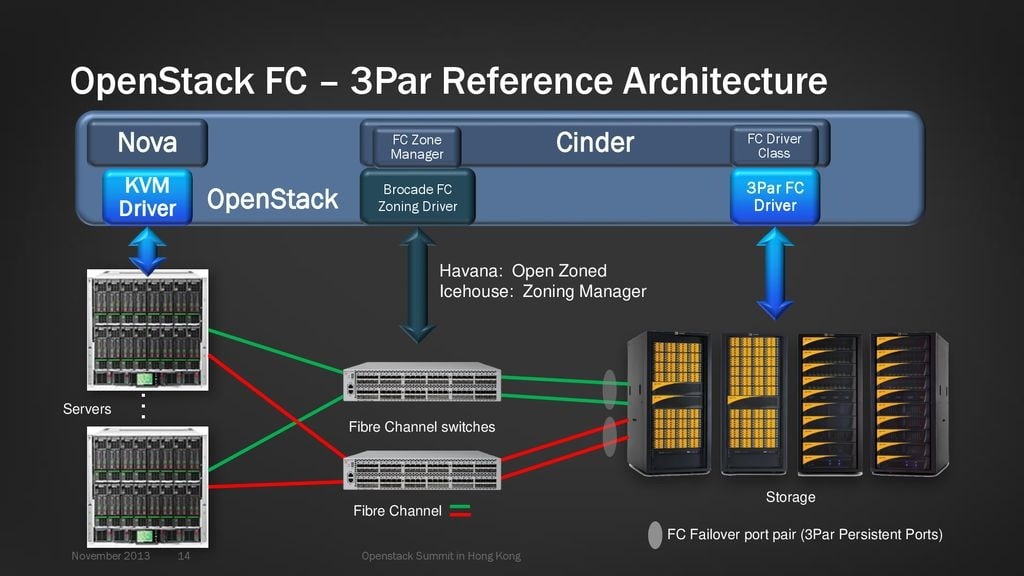

Доброго времени суток! Решил познакомиться с оупенстеком и встал вопрос, а реально ли подружить сие творение с SAN? Например, с файберченелом или ISCSI. Так же встает вопрос о том, что такое cinder? В одних местах изображают его как файловое хранилище под клиентские виртуалки, в другом случае как координатор для файловых хранилищ по типу NFS/ISCSI.

Nikita

Nikita

Извиняюсь, если вопросы глупые. Только начал знакомиться с оупенстеком и вопросов больше, чем ответов

Nikita

Nikita

А синдер в таком случае выступает как прокси для SAN? Или просто стоит в сторонке и работает как координатор?

Aleksandr

Aleksandr

это мененджер томов. он в случае с тапокй он ходит в тапку с ней там договаривается и отдает томы в ВМ. если локальный LVM то нарежает на хосте LVM и отдает их. В общем там много чего cinder умеет

Pavel

Pavel

чтобы массовый рестар небыл болью нужно задавать размер очереди на обработку.

в нашем кластере я создавал 400 циросов. все создались (диски на полке)

Pavel

Pavel

в опенстеке есть жопа с контролем поледовательности выполенния задач из рабита. можно получть что задача на удаление пришла позже чем на создание

Это лишь пример там чудес валом при сильной нагрузке

Aleksandr

Aleksandr

одни два проца 64рам другие 4 проа 512

нет такая дичь нормально отрабатывает, ты написал правильно ссут в уши

J

J

ну т.е. все работает нормально, а мне просто пытаются нассать в уши?

Да.

Это от того что не понимают как работает все и не хотят разбираться.

J

J

Вообще удивительно, конечно, когда коллеги такое рассказывают. Первый вопрос который я бы задал в ответ на эти басни: "почему?". И продолжал бы это слово повторять пока ответ не дошел бы до сути)

NS 🇷🇺

NS 🇷🇺

нет такая дичь нормально отрабатывает, ты написал правильно ссут в уши

да не ссут ему в уши. Умирает у тебя нода с 512 памятью и свободна только одна на 64, где вм будут подниматься - правильно, нигде

Ilya

Ilya

да не ссут ему в уши. Умирает у тебя нода с 512 памятью и свободна только одна на 64, где вм будут подниматься - правильно, нигде

В ситуации near full и не такое бывает, если ещё все CPU переподписать чтобы в полочку под 99% и на шаренном стородже near full

Aleksandr

Aleksandr

да не ссут ему в уши. Умирает у тебя нода с 512 памятью и свободна только одна на 64, где вм будут подниматься - правильно, нигде

это несколько другой кейс, но так то да. С такой формулировкой согласен, но по этому в резерве всегда должны быть самые жирные ноды.

Ilya

Ilya

обычно когда compute-нода умирает

Даже жирная компьют нода не создаст сверхсильной нагрузки. В целом Openstack спокойно держит на небольших кластерах подъем сотен виртуалок. Если не держит - с кластером что-то не так

NS 🇷🇺

NS 🇷🇺

ну тут не проблема ОС, та же проблема и на варе будет

это будет везде, в двухлитровую банку три литра борща не перелить, сорян

Alexander

Alexander