Andrey

Andrey

всем привет, пятничного вопроса господа =)

чет я запамятовал, напомните плиз

block_device_allocate_retries

относится к api, conductor или scheduler в какой контейнер запихать параметр?

сколько раз компьюте тыкаться за вольюмом, перед тем как разочароваться в синдере ?

NS 🇷🇺

NS 🇷🇺

сколько раз компьюте тыкаться за вольюмом, перед тем как разочароваться в синдере ?

сколько компьют ждет готовности диска тыкая в синдер палкой

greytiger

greytiger

Рамиль

Рамиль

Попробовал с новой версией CF и Bosh Bootloader (bbl) развернуть тестовый bosh lite на Google Cloud Platform. GCP это одна из двух платформ для bosh lite (вторая это AWS). Bosh lite это упрощенная версия, где поднимается на одной большой машине весь CF, все нужные инстансы запускаются в одном экземпляре в KVM-машине на этом же хосте.

Пришлось только поменять машину с 8 CPU на 4 CPU - бесплатный тариф дает только 8CPU, из них на jumpbox ушел 1. На все ушло минут 30 активной работы, и пары часов времени всего.

Работает идеально.

Со своей стороны порекомендую только, что операции с GCP лучше всего делать прямо в веб-консоли гугла

Yes, I am

Yes, I am

Привет всем,

может кто в последние время разворачивал magnum и сталкивался с такой проблемой, что установка кластера заканчивается с ошибкой по таймауту. А в heat стеке не может установится kube_masters и внутри висит на вот этом шаге:

https://opendev.org/openstack/magnum/src/branch/stable/train/magnum/drivers/k8s_fedora_atomic_v1/templates/kubemaster.yaml#L820

по описанию похожи очень два вот этих бага, все, что там рекомендую пробовал, результат не меняется вообще никак

https://bugs.launchpad.net/kolla-ansible/+bug/1846476

https://bugs.launchpad.net/magnum/+bug/1744362

Jain

Jain

добрый день, а кто нибудь устанавливал и подключал Manila CSI в кубере? Там есть какаято внятная дока? Делаю все как написанно тут. Но в логах есть только Still connecting to unix:///csi/csi.sock https://github.com/kubernetes/cloud-provider-openstack/blob/master/docs/manila-csi-plugin/using-manila-csi-plugin.md

Danil

Danil

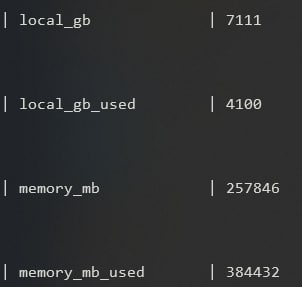

В какую сторону копать, если я начал внезапно получать "No Valid host", а в scheduler вот такое:

"Filter results: ['RetryFilter: (start: 1, end: 1)', 'AvailabilityZoneFilter: (start: 1, end: 1)', 'ComputeFilter: (start: 1, end: 0)']"

В прошлый раз были проблемы с RamFilter, их починил, а с ComputeFilter непонятно что смотреть. Из доп. признаков еще тачка с рут диском 0Гб создается, а с >0 не создается. Но место везде перепроверил - все ок

Eugen

Eugen

openstack host list

openstack hypervisor list

считает ли OpenStack, что вообще есть свободные ресурсы?

Eugen

Eugen

openstack host list

openstack hypervisor list

считает ли OpenStack, что вообще есть свободные ресурсы?

openstack hypervisor list --long

J

J

В какую сторону копать, если я начал внезапно получать "No Valid host", а в scheduler вот такое:

"Filter results: ['RetryFilter: (start: 1, end: 1)', 'AvailabilityZoneFilter: (start: 1, end: 1)', 'ComputeFilter: (start: 1, end: 0)']"

В прошлый раз были проблемы с RamFilter, их починил, а с ComputeFilter непонятно что смотреть. Из доп. признаков еще тачка с рут диском 0Гб создается, а с >0 не создается. Но место везде перепроверил - все ок

Еще можешь глянуть какое значение в конфиге новы у параметра:

reserve_disk_resource_for_image_cache

Eugen

Eugen

а что еще пишется в /var/log/nova-scheduler.log про ComputeFilter ? По какой причине не подходит хост:

(hostname, hypervisorname) ... fails because ...

J

J

Но вообще эти все compute, ram и disk фильтры считаются устаревшими и placement начиная с queens, что ли, считает ресурсы и выдает кандидатов. А потом уж этих кандидатов nova-sceduler через оставшиеся фильтры прогоняет.

Danil

Danil

а что еще пишется в /var/log/nova-scheduler.log про ComputeFilter ? По какой причине не подходит хост:

(hostname, hypervisorname) ... fails because ...

ничего не пишет, попробую дебаг включить

Aleksey

Aleksey

Приветы, есть тут кто хорошо cinder раскурил? Я вот что-то не могу понять, по вот этому workflow аттачинг волюма происходит без возвращения attachment_id.

https://github.com/openstack/cinder/blob/77c6f1010c4760da84b548a338663f2c99873d1c/doc/source/contributor/attach_detach_conventions.rst

Правильно ли я понимаю что возвращение attachment_id появилось только в workflow v2 и оно не везде реализовано? Например я сейчас бьюсь с glance_store.

Aleksey

Aleksey

ну видимо все так, в glance_store используется первая верси workflow и она мягко говоря хреново работает с multiattachment

Ilya

Ilya

Всем привет! В ближайшую пятницу планируется подкаст об OpenStack: https://linkmeup.ru/blog/597.html

Михаил

Михаил

Всем привет! В ближайшую пятницу планируется подкаст об OpenStack: https://linkmeup.ru/blog/597.html

Сетевики добрались до опенстека

Dmitriy

Dmitriy

Всем привет! В ближайшую пятницу планируется подкаст об OpenStack: https://linkmeup.ru/blog/597.html

Простите, а как записаться?

Михаил

Михаил

Блин, подкаст же, точно:) Т.е. можно в любой момент потом послушать, да?

Запись выложат позже

Eugen

Eugen

можно еще вопросов поназадавать https://docs.google.com/forms/d/15AlSOXmb-fsmiyB0VHmJ6WxGopp1gMWOOXi8l-NgoX8/viewform ))

Ilya

Ilya

Блин, подкаст же, точно:) Т.е. можно в любой момент потом послушать, да?

Но можно вопросов накидать - там ссылка есть

Dmitriy

Dmitriy

Но можно вопросов накидать - там ссылка есть

Да, вижу, спасибо. airship — предмет для обсуждения?

Михаил

Михаил

Anton

Anton

"linkmeup - это проект про IT, которым занимается группа энтузиастов, не нашедших лучшего применения своему свободному времени. "

Михаил

Михаил

ЛОЛ, вот Миш скажи мне, у тебя заело на сетевиках? =)

А чего? Только мне чтоль страдать? Я теперь пожизненный цефовод, вы сетевики. Карма такая

Anton

Anton

А чего? Только мне чтоль страдать? Я теперь пожизненный цефовод, вы сетевики. Карма такая

=) Ну нет =) Я грязный архитектор

Aleksey

Aleksey

вот сейчас опять люди понаприходят, дойдем до 1к и опять бот прийдет и останется 300 живых 😁

Ilya

Ilya

Я и твой кот

Я и твой кот

Да, вижу, спасибо. airship — предмет для обсуждения?

Не совсем. Затронем, но по airship должен будет выйти отдельный выпуск.

Андрей

Андрей

вот сейчас опять люди понаприходят, дойдем до 1к и опять бот прийдет и останется 300 живых 😁

А кто тебе тут ещё нужен?

Anton

Anton

Все мы знаем, что пятница время для шутеек.

В этот раз нам будет не до смеха (но это не точно), встречаем выпуск sysadmins#28 OpenStack

И да, всем кто любит сабж можно пройти и приобщиться к прекрасному миру опенсорса @openstack_ru.

https://linkmeup.ru/blog/597.html

Продолжаем эксперименты с календарём

Свой коварный вопрос можно и нужно задавать здесь

Fedor

Fedor

можно еще вопросов поназадавать https://docs.google.com/forms/d/15AlSOXmb-fsmiyB0VHmJ6WxGopp1gMWOOXi8l-NgoX8/viewform ))

Там предлагается сразу ответить))

Danil

Danil

ничего не пишет, попробую дебаг включить

Я забил на какое-то время, теперь вернулся к теме. На данный момент после включения дебаг логов похоже, что почему-то scheduler то ли не видит, то ли не включает в выборку все ноды кроме одной, которая до этого была руками задизейблена.

В host_manager.py докопался до функции "_get_computes_for_cells", которая действительно возвращает только один хост, видит что он выключен и рапортует, что хостов нет. Сейчас я пытаюсь понять почему она не видит свободные хосты

Есть подозрение, что это связано со следующими строчками. Всего у меня 3 хоста сейчас, и в логе я вижу

oslo_concurrency.lockutils [req-3c77b138-d6f8-465b-a5e0-d18be8d5818d 26f288d0831a4dcbb4c6ccc1aa30258c 968fc03383e14cc2aa30b8bacc3de263 - default default] Lock "b2194806-d9b1-4539-8cb0-e036aa2e3ec8" acquired by "nova.context.get_or_set_cached_cell_and_set_connections" :: waited 0.000s inner /usr/lib/python2.7/site-packages/oslo_concurrency/lockutils.py:270

oslo_concurrency.lockutils [req-3c77b138-d6f8-465b-a5e0-d18be8d5818d 26f288d0831a4dcbb4c6ccc1aa30258c 968fc03383e14cc2aa30b8bacc3de263 - default default] Lock "b2194806-d9b1-4539-8cb0-e036aa2e3ec8" released by "nova.context.get_or_set_cached_cell_and_set_connections" :: held 0.000s inner /usr/lib/python2.7/site-packages/oslo_concurrency/lockutils.py:282

oslo_concurrency.lockutils [req-3c77b138-d6f8-465b-a5e0-d18be8d5818d 26f288d0831a4dcbb4c6ccc1aa30258c 968fc03383e14cc2aa30b8bacc3de263 - default default] Lock "(u'iris.*****', u'iris.******')" acquired by "nova.scheduler.host_manager._locked_update" :: waited 0.000s inner /usr/lib/python2.7/site-packages/oslo_concurrency/lockutils.py:270

Есть какие-то идеи, что это за блокировки и как они могут влиять?

Aleksey

Aleksey

Я забил на какое-то время, теперь вернулся к теме. На данный момент после включения дебаг логов похоже, что почему-то scheduler то ли не видит, то ли не включает в выборку все ноды кроме одной, которая до этого была руками задизейблена.

В host_manager.py докопался до функции "_get_computes_for_cells", которая действительно возвращает только один хост, видит что он выключен и рапортует, что хостов нет. Сейчас я пытаюсь понять почему она не видит свободные хосты

Есть подозрение, что это связано со следующими строчками. Всего у меня 3 хоста сейчас, и в логе я вижу

oslo_concurrency.lockutils [req-3c77b138-d6f8-465b-a5e0-d18be8d5818d 26f288d0831a4dcbb4c6ccc1aa30258c 968fc03383e14cc2aa30b8bacc3de263 - default default] Lock "b2194806-d9b1-4539-8cb0-e036aa2e3ec8" acquired by "nova.context.get_or_set_cached_cell_and_set_connections" :: waited 0.000s inner /usr/lib/python2.7/site-packages/oslo_concurrency/lockutils.py:270

oslo_concurrency.lockutils [req-3c77b138-d6f8-465b-a5e0-d18be8d5818d 26f288d0831a4dcbb4c6ccc1aa30258c 968fc03383e14cc2aa30b8bacc3de263 - default default] Lock "b2194806-d9b1-4539-8cb0-e036aa2e3ec8" released by "nova.context.get_or_set_cached_cell_and_set_connections" :: held 0.000s inner /usr/lib/python2.7/site-packages/oslo_concurrency/lockutils.py:282

oslo_concurrency.lockutils [req-3c77b138-d6f8-465b-a5e0-d18be8d5818d 26f288d0831a4dcbb4c6ccc1aa30258c 968fc03383e14cc2aa30b8bacc3de263 - default default] Lock "(u'iris.*****', u'iris.******')" acquired by "nova.scheduler.host_manager._locked_update" :: waited 0.000s inner /usr/lib/python2.7/site-packages/oslo_concurrency/lockutils.py:270

Есть какие-то идеи, что это за блокировки и как они могут влиять?

1. а случаем у тебя компьюты не в разных cells?

2. случаем на других нодах ВМ не фейлились? У шедулера есть фильтр который выводит ноду из шедулинга если на ней фейлилась ВМ. Типа чтобы не плодить фейлы. Выключается вот так:

[filter_scheduler]

build_failure_weight_multiplier = 0

Danil

Danil

1. а случаем у тебя компьюты не в разных cells?

2. случаем на других нодах ВМ не фейлились? У шедулера есть фильтр который выводит ноду из шедулинга если на ней фейлилась ВМ. Типа чтобы не плодить фейлы. Выключается вот так:

[filter_scheduler]

build_failure_weight_multiplier = 0

нет. В одной

А вот второе проверю. А где эта инфа хранится? В базе мб поле какое-то есть?

Aleksey

Aleksey

нет. В одной

А вот второе проверю. А где эта инфа хранится? В базе мб поле какое-то есть?

https://github.com/openstack/nova/blob/9419c3e05499e55beda93d664197a7b0f0011ff7/nova/scheduler/weights/compute.py

ну вот тут код намекает что у хостов есть какой-то счетчик failed_builds

Eugen

Eugen

Eugen

Eugen

да, если под нормально считать, что ничего не выводит

и в openstack host list всё также один активный хост? после этого

Eugen

Eugen

Danil

Danil

Eugen

Eugen

В общем завтра видимо буду разбираться каким конкретно запросом он получает только один хост

а какие вообще фильтры присутствуют ?

Aleksey

Aleksey

нет. В одной

А вот второе проверю. А где эта инфа хранится? В базе мб поле какое-то есть?

как минимум в nova есть таблица instance_faults и там лежат сфейленые ВМ с привязкой по хостам

Aleksey

Aleksey

В общем завтра видимо буду разбираться каким конкретно запросом он получает только один хост

погоди у тебя прямо в листинге 1 хост?

Danil

Danil

погоди у тебя прямо в листинге 1 хост?

не в листинге. В host list 3 хоста, один из которых выключен руками, и именно он попадает в выборку, но естественно не подходит, потому что в статусе disable

Pavel

Pavel

Mikhail

Mikhail

tsla

tsla

Sheridan

Sheridan