Super

Super

если я допустим в access вывел какие-то данные, как их скормить nginx, чтобы он их закешил в свой кеш? ngx.location.capture?

Maxim

Maxim

только если из луа на конкретный локейшен только в конкретном случае отправиться

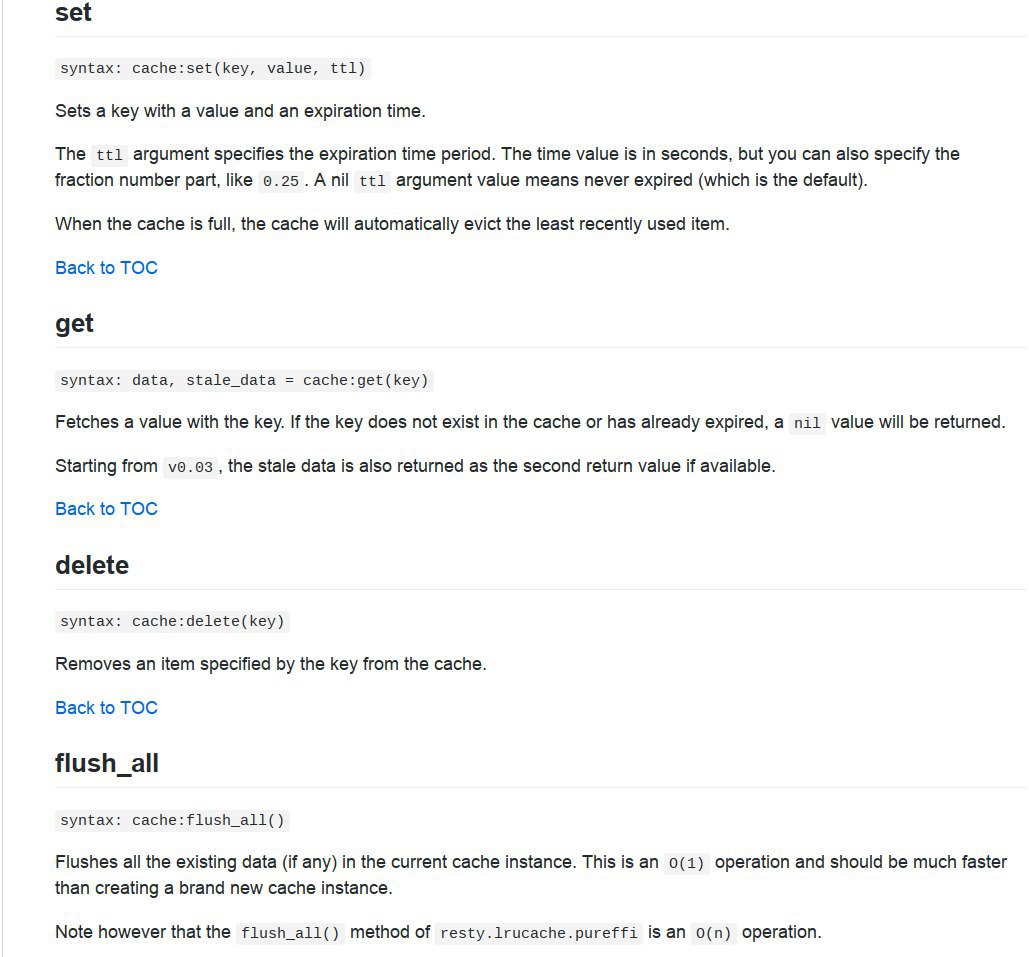

https://github.com/openresty/lua-resty-lrucache

Maxim

Maxim

и 2 метода get set

Maxim

Maxim

тогда вам нужен Cloudflare и его кэш, что бы не беспокоиться за кэш самостоятельно, нам нравится и мы не жалуемся на него, ваще про кэш забыли

Super

Super

клаудфларе использую, но он не особо помогает. их edge ttl cache можно задать мес, но по факту оно лежит по несколько дней

Maxim

Maxim

может быть пересмотреть палитику партии и задуматься о более оперативной очистке и не хранить 400Гб данных которые могут быть давно протухшими

Super

Super

ссд достаточно быстр, у него объем чтений равен пропускной способности, а количество особо не ограничено

Super

Super

если будет много трафа, там такая мясорубка будет, что эти 400гб будут целиком раз в день перезаписываться

Maxim

Maxim

если будет много трафа, там такая мясорубка будет, что эти 400гб будут целиком раз в день перезаписываться

мы например не используем кэш, только тот что в Cloudflare

Maxim

Maxim

например у нас есть 150 000 картинок для карточек товара, каждому фиду и фронт приложению нужна картинка своего размера, мы не храним обрезки, а просто быстро режем и отдаем в браузр, и не нужен нам кэш, даже забыли про него

Super

Super

я вместо имени ключа использую число и ужимаю его до 249 ричной системы исчисления, чтобы символов меньше было

Maxim

Maxim

вы же видели мой скриншот, там 2 бд по 37гб

ну то что вы показали это не совсем то что вы думаете

Maxim

Maxim

тогда вам ничего не остается как взять весь ваш кэш и хранить в БД в табличке с индексными полями, надежно и достаточно быстро

Snusmumriken

Snusmumriken

меня сейчас ограничивает чисто железо

Ох блин. Фигня в том, что для того кеша который тебе нужен (сотни миллионов страниц на диске), нужен индекс чтобы эти странички быстро искать. Притом добавление новых страничек требует достройки индекса, а удаление — считай что полной перестройки, операции довольно длительные. Можно попробовать извратиться и кешировать файликами в папочках, с таким деревом должно быть сравнительно быстро, плюс отдельные документы легко жать. Ну и удалять тоже должно быть норм: стёр папку данного сайта.

Maxim

Maxim

мне еще нужна автоэвакуация данных, если бд переполнена

а что у вас за проблема такая с местом под данные если предвидится Терабайты данных в кеш?

Maxim

Maxim

как вариант - поставить 2 нгинкса, одним с другого проксировать и использовать proxy_cache

пробовали ElasticSearch ?

Maxim

Maxim

как вариант - поставить 2 нгинкса, одним с другого проксировать и использовать proxy_cache

хорошее решение, у нас так половина кэша работает

Super

Super

а в рамках одного нгинкса можно как-то пробросить на локейшен чтобы он там закешил своим механизмом?

Maxim

Maxim

Maxim

Maxim

а в рамках одного нгинкса можно как-то пробросить на локейшен чтобы он там закешил своим механизмом?

https://github.com/weserv/images/blob/4.x/config/nginx/conf.d/imagesweserv.conf

Может чем то вам будет полезен этот конфигурационный файл

Super

Super

у меня слишком уж сложная задача, такого там нету. но попробую реализовать просто двумя нгинксами

Super

Super

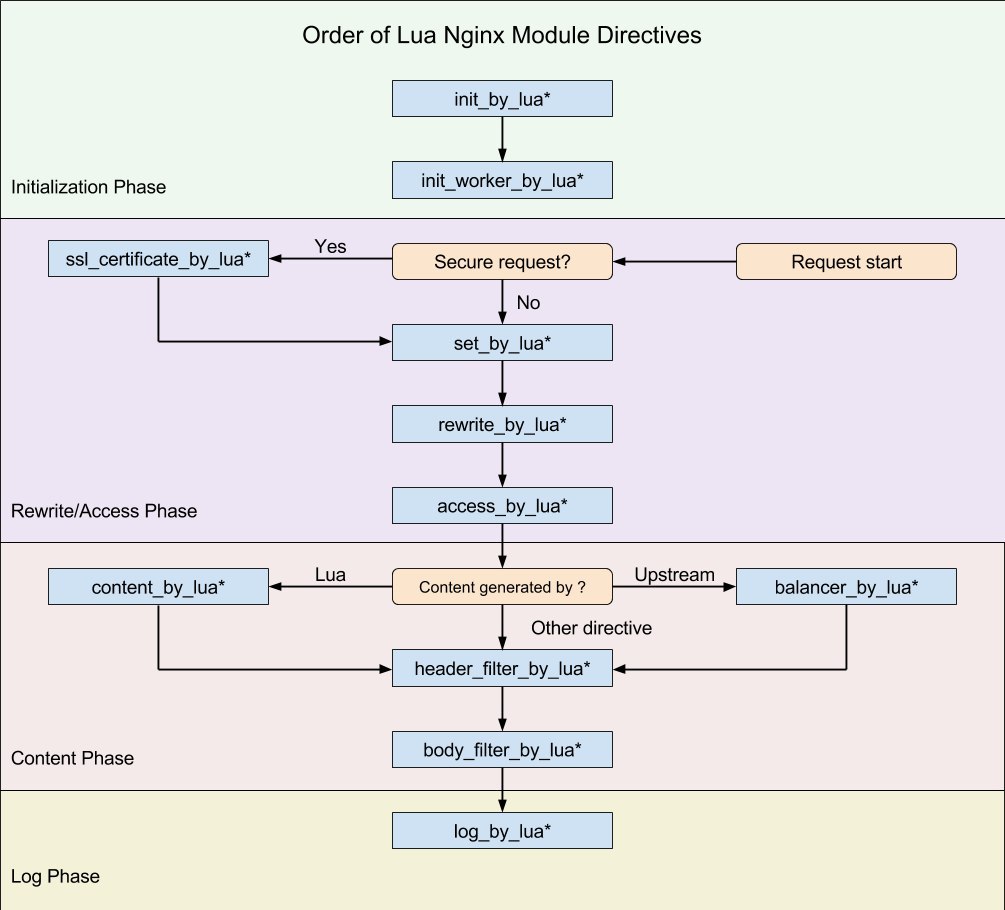

у меня вот какая ситуация location { access_by_lua_block { тут в каких-то особых случаях есть в наличии контент и его нужно отправить в кеш, причем он не тот. что выдается } далее proxy_pass и фильтры }

Super

Super

Ох блин. Фигня в том, что для того кеша который тебе нужен (сотни миллионов страниц на диске), нужен индекс чтобы эти странички быстро искать. Притом добавление новых страничек требует достройки индекса, а удаление — считай что полной перестройки, операции довольно длительные. Можно попробовать извратиться и кешировать файликами в папочках, с таким деревом должно быть сравнительно быстро, плюс отдельные документы легко жать. Ну и удалять тоже должно быть норм: стёр папку данного сайта.

да, так и есть. все бд, включая редис, строят этот индекс. но он не может быть слишком уж большим. ну допустим пару гб будет весить.

Super

Super

писать самому на диск - хорошая идея. но когда диск заполнится, надо каким-то образом найти самый ненужный файл и удалить его, проверить место и записать. для этого мне самому придется этот индекс вести и изобретать колесо.

Super

Super

плюс умные бд могут это делать постепенно, когда нагрузки нет. заранее место освобождать без спешки.

Super

Super

плюс тут надо очереди на запись делать, если скажем возникнет ситуация, что единовременно 1 поток освобождает под себя данные и хочет записать, а другой в это время записал, то возникнет проблема.

Maxim

Maxim

в фазе access_by_lua_block обычно выбрасывают ошибку если юзверь не прошел проверку, никаких других действий обычно там не производят