Denis

Denis

да, в папке действительно пусто, я решил что init должен что-то создавать там, но там ничего, однако reset чистит эту папку

Denis

Denis

# systemctl status kubelet

● kubelet.service - kubelet: The Kubernetes Node Agent

Loaded: loaded (/etc/systemd/system/kubelet.service; enabled; vendor preset: disabled)

Drop-In: /etc/systemd/system/kubelet.service.d

└─10-kubeadm.conf

Active: active (running) since Ср 2018-01-17 18:47:10 MSK; 2min 35s ago

Docs: http://kubernetes.io/docs/

Main PID: 8509 (kubelet)

Memory: 39.8M

CGroup: /system.slice/kubelet.service

└─8509 /usr/bin/kubelet --bootstrap-kubeconfig=/etc/kubernetes/bootstrap-kubelet.conf --kubeconfig=/etc/kubernetes/kubelet.conf --pod-ma...

янв 17 18:49:34 domain.ru kubelet[8509]: I0117 18:49:34.580087 8509 kuberuntime_manager.go:514] Container...vFrom

янв 17 18:49:34 domain.ru kubelet[8509]: I0117 18:49:34.580215 8509 kuberuntime_manager.go:758] checking ...11c)"

янв 17 18:49:34 domain.ru kubelet[8509]: I0117 18:49:34.580341 8509 kuberuntime_manager.go:768] Back-off ...111c)

янв 17 18:49:34 domain.ru kubelet[8509]: E0117 18:49:34.580383 8509 pod_workers.go:186] Error syncing pod 4088...

янв 17 18:49:36 domain.ru kubelet[8509]: W0117 18:49:36.685555 8509 cni.go:171] Unable to update cni conf...net.d

янв 17 18:49:36 domain.ru kubelet[8509]: E0117 18:49:36.685723 8509 kubelet.go:2105] Container runtime ne...lized

янв 17 18:49:37 domain.ru kubelet[8509]: I0117 18:49:37.740409 8509 kubelet_node_status.go:273] Setting n...etach

янв 17 18:49:41 domain.ru kubelet[8509]: E0117 18:49:41.649068 8509 eviction_manager.go:238] eviction man...found

янв 17 18:49:41 domain.ru kubelet[8509]: W0117 18:49:41.686895 8509 cni.go:171] Unable to update cni conf...net.d

янв 17 18:49:41 domain.ru kubelet[8509]: E0117 18:49:41.687035 8509 kubelet.go:2105] Container runtime ne...lized

Hint: Some lines were ellipsized, use -l to show in full.

[root@kube kubelet.service.d]# systemctl status kubelet -l

● kubelet.service - kubelet: The Kubernetes Node Agent

Loaded: loaded (/etc/systemd/system/kubelet.service; enabled; vendor preset: disabled)

Drop-In: /etc/systemd/system/kubelet.service.d

└─10-kubeadm.conf

Active: active (running) since Ср 2018-01-17 18:47:10 MSK; 2min 41s ago

Docs: http://kubernetes.io/docs/

Main PID: 8509 (kubelet)

Memory: 39.8M

CGroup: /system.slice/kubelet.service

└─8509 /usr/bin/kubelet --bootstrap-kubeconfig=/etc/kubernetes/bootstrap-kubelet.conf --kubeconfig=/etc/kubernetes/kubelet.conf --pod-manifest-path=/etc/kubernetes/manifests --allow-privileged=true --cluster-dns=10.96.0.10 --cluster-domain=cluster.local --network-plugin=cni --cni-conf-dir=/etc/cni/net.d --cni-bin-dir=/opt/cni/bin --authorization-mode=Webhook --client-ca-file=/etc/kubernetes/pki/ca.crt --cadvisor-port=0 --cgroup-driver=cgroupfs --rotate-certificates=true --cert-dir=/var/lib/kubelet/pki

Denis

Denis

янв 17 18:49:46 domain.ru kubelet[8509]: W0117 18:49:46.688486 8509 cni.go:171] Unable to update cni config: No networks found in /etc/cni/net.d

янв 17 18:49:46 domain.ru kubelet[8509]: E0117 18:49:46.688657 8509 kubelet.go:2105] Container runtime network not ready: NetworkReady=false reason:NetworkPluginNotReady message:docker: network plugin is not ready: cni config uninitialized

янв 17 18:49:48 domain.ru kubelet[8509]: I0117 18:49:48.386917 8509 kubelet_node_status.go:273] Setting node annotation to enable volume controller attach/detach

янв 17 18:49:48 domain.ru kubelet[8509]: I0117 18:49:48.692960 8509 kuberuntime_manager.go:514] Container {Name:etcd Image:gcr.io/google_containers/etcd-amd64:3.1.10 Command:[etcd --listen-client-urls=http://127.0.0.1:2379 --advertise-client-urls=http://127.0.0.1:2379 --data-dir=/var/lib/etcd] Args:[] WorkingDir: Ports:[] EnvFrom:[] Env:[] Resources:{Limits:map[] Requests:map[]} VolumeMounts:[{Name:etcd ReadOnly:false MountPath:/var/lib/etcd SubPath: MountPropagation:<nil>}] VolumeDevices:[] LivenessProbe:&Probe{Handler:Handler{Exec:nil,HTTPGet:&HTTPGetAction{Path:/health,Port:2379,Host:127.0.0.1,Scheme:HTTP,HTTPHeaders:[],},TCPSocket:nil,},InitialDelaySeconds:15,TimeoutSeconds:15,PeriodSeconds:10,SuccessThreshold:1,FailureThreshold:8,} ReadinessProbe:nil Lifecycle:nil TerminationMessagePath:/dev/termination-log TerminationMessagePolicy:File ImagePullPolicy:IfNotPresent SecurityContext:nil Stdin:false StdinOnce:false TTY:false} is dead, but RestartPolicy says that we should restart it.

янв 17 18:49:48 domain.ru kubelet[8509]: I0117 18:49:48.693117 8509 kuberuntime_manager.go:758] checking backoff for container "etcd" in pod "etcd-domain.ru_kube-system(408851a572c13f8177557fdb9151111c)"

янв 17 18:49:48 domain.ru kubelet[8509]: I0117 18:49:48.693245 8509 kuberuntime_manager.go:768] Back-off 1m20s restarting failed container=etcd pod=etcd-domain.ru_kube-system(408851a572c13f8177557fdb9151111c)

янв 17 18:49:48 domain.ru kubelet[8509]: E0117 18:49:48.693277 8509 pod_workers.go:186] Error syncing pod 408851a572c13f8177557fdb9151111c ("etcd-domain.ru_kube-system(408851a572c13f8177557fdb9151111c)"), skipping: failed to "StartContainer" for "etcd" with CrashLoopBackOff: "Back-off 1m20s restarting failed container=etcd pod=etcd-domain.ru_kube-system(408851a572c13f8177557fdb9151111c)"

янв 17 18:49:51 domain.ru kubelet[8509]: E0117 18:49:51.649318 8509 eviction_manager.go:238] eviction manager: unexpected err: failed to get node info: node "domain.ru" not found

янв 17 18:49:51 domain.ru kubelet[8509]: W0117 18:49:51.689863 8509 cni.go:171] Unable to update cni config: No networks found in /etc/cni/net.d

янв 17 18:49:51 domain.ru kubelet[8509]: E0117 18:49:51.689998 8509 kubelet.go:2105] Container runtime network not ready: NetworkReady=false reason:NetworkPluginNotReady message:docker: network plugin is not ready: cni config uninitialized

Denis

Denis

# tail -n 30 /var/log/messages

Jan 17 19:04:13 kube dockerd: time="2018-01-17T19:04:13.815696693+03:00" level=warning msg="unknown container" container=9f9a4b0b545ac96c261aa768e5f4f2c953a3ed6dc2e4751e5d1de2f4b9a86158 module=libcontainerd namespace=plugins.moby

Jan 17 19:04:14 kube kubelet: I0117 19:04:14.894501 12405 kubelet_node_status.go:273] Setting node annotation to enable volume controller attach/detach

Jan 17 19:04:14 kube kubelet: I0117 19:04:14.894578 12405 kubelet_node_status.go:273] Setting node annotation to enable volume controller attach/detach

Jan 17 19:04:14 kube kubelet: I0117 19:04:14.909903 12405 kubelet_node_status.go:273] Setting node annotation to enable volume controller attach/detach

Jan 17 19:04:15 kube kubelet: I0117 19:04:15.199515 12405 kuberuntime_manager.go:514] Container {Name:etcd Image:gcr.io/google_containers/etcd-amd64:3.1.10 Command:[etcd --listen-client-urls=http://127.0.0.1:2379 --advertise-client-urls=http://127.0.0.1:2379 --data-dir=/var/lib/etcd] Args:[] WorkingDir: Ports:[] EnvFrom:[] Env:[] Resources:{Limits:map[] Requests:map[]} VolumeMounts:[{Name:etcd ReadOnly:false MountPath:/var/lib/etcd SubPath: MountPropagation:<nil>}] VolumeDevices:[] LivenessProbe:&Probe{Handler:Handler{Exec:nil,HTTPGet:&HTTPGetAction{Path:/health,Port:2379,Host:127.0.0.1,Scheme:HTTP,HTTPHeaders:[],},TCPSocket:nil,},InitialDelaySeconds:15,TimeoutSeconds:15,PeriodSeconds:10,SuccessThreshold:1,FailureThreshold:8,} ReadinessProbe:nil Lifecycle:nil TerminationMessagePath:/dev/termination-log TerminationMessagePolicy:File ImagePullPolicy:IfNotPresent SecurityContext:nil Stdin:false StdinOnce:false TTY:false} is dead, but RestartPolicy says that we should restart it.

Jan 17 19:04:15 kube kubelet: I0117 19:04:15.199667 12405 kuberuntime_manager.go:758] checking backoff for container "etcd" in pod "etcd-domain.ru_kube-system(408851a572c13f8177557fdb9151111c)"

Jan 17 19:04:15 kube kubelet: I0117 19:04:15.199924 12405 kuberuntime_manager.go:768] Back-off 2m40s restarting failed container=etcd pod=etcd-domain.ru_kube-system(408851a572c13f8177557fdb9151111c)

Jan 17 19:04:15 kube kubelet: E0117 19:04:15.199991 12405 pod_workers.go:186] Error syncing pod 408851a572c13f8177557fdb9151111c ("etcd-domain.ru_kube-system(408851a572c13f8177557fdb9151111c)"), skipping: failed to "StartContainer" for "etcd" with CrashLoopBackOff: "Back-off 2m40s restarting failed container=etcd pod=etcd-domain.ru_kube-system(408851a572c13f8177557fdb9151111c)"

Jan 17 19:04:15 kube kubelet: I0117 19:04:15.408151 12405 kubelet_node_status.go:273] Setting node annotation to enable volume controller attach/detach

Jan 17 19:04:15 kube kubelet: I0117 19:04:15.413814 12405 kubelet_node_status.go:82] Attempting to register node domain.ru

Jan 17 19:04:15 kube kubelet: I0117 19:04:15.920588 12405 kubelet_node_status.go:273] Setting node annotation to enable volume controller attach/detach

Anton

Anton

Alexey

Alexey

Кубаны, а какие есть хорошие и простые решения для того, чтобы шарить volumes в кубах. Мы сидим в гугл клауде и нам нужно, чтобы один контейнер/хост писал, а остальные читали. Пробовал google PD, но он не поддерживает rwmany, readmany +writeonce не дают сделать механизмы кубов. GCS бакеты не подходят из за невозможности быстро писать много файлов за один раз. Может есть ещё что-то, кроме gluster/ceph/nfs, что могло бы решить проблему?

Anonymous

Anonymous

Кубаны, а какие есть хорошие и простые решения для того, чтобы шарить volumes в кубах. Мы сидим в гугл клауде и нам нужно, чтобы один контейнер/хост писал, а остальные читали. Пробовал google PD, но он не поддерживает rwmany, readmany +writeonce не дают сделать механизмы кубов. GCS бакеты не подходят из за невозможности быстро писать много файлов за один раз. Может есть ещё что-то, кроме gluster/ceph/nfs, что могло бы решить проблему?

Так контейнер или хост? Можно два контейнера засунуть в под и шарить как обычную fs

Alexey

Alexey

@gurinderu увы, мне нужно расшаривать данные, которые пишутся извне в большое кол-во контейнеров на ридонли. Схема типа writer -> shared storage <- pod reader1

\ pod readern

Anonymous

Anonymous

Alexey

Alexey

Нельзя врайтера в том же поде поднять?

Ноуп. Самый лучший вариант, конечно, с cephfs, но мне пока нужно узнать, есть ли ещё варианты.

Kirill

Kirill

Коллеги, подскажите в чем разница между сервисом который ExternalIP и LoadBalanser? уже много почитал но так и не понял.

Anton

Anton

ну а external ip управляются админом, если трафик на кластер приходит по этим адресам, можно заставить сервис принимать трафик на этом адресе

Logan

Logan

кто нибудь использует ceph с гигабитной сетью ? поделитесь впечатлениями

я использую, нагрузка минимальная – ему хватает

Anonymous

Anonymous

Файлы

ну тут тогда нужно fs смотреть без вариантов, можешь сравнить ceph,gluster и самый крутой hdfs)

Logan

Logan

ну тут тогда нужно fs смотреть без вариантов, можешь сравнить ceph,gluster и самый крутой hdfs)

не используйте gluster. никогда.

𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜

Кубаны, а какие есть хорошие и простые решения для того, чтобы шарить volumes в кубах. Мы сидим в гугл клауде и нам нужно, чтобы один контейнер/хост писал, а остальные читали. Пробовал google PD, но он не поддерживает rwmany, readmany +writeonce не дают сделать механизмы кубов. GCS бакеты не подходят из за невозможности быстро писать много файлов за один раз. Может есть ещё что-то, кроме gluster/ceph/nfs, что могло бы решить проблему?

Если есть желание можете потестить Lustre вместе со мной :)

https://github.com/kvaps/kube-lustre

Denis

Denis

Всем привет!

Столкнулся с проблемой на Centos7:

При запуске kubeadm init —pod-network-cidr=10.244.0.0/16

получаю ошибку в jounalctl:

Unable to update cni config: No networks found in /etc/cni/net.d

В общем проблема похоже была не в cni, но в чем конкретно, я так и не разобрался. Решил все установкой kubctl, kubeadm, kubelet версии 1.8.6 (вместо 1.9.1)

𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜

Всем привет!

Столкнулся с проблемой на Centos7:

При запуске kubeadm init —pod-network-cidr=10.244.0.0/16

получаю ошибку в jounalctl:

Unable to update cni config: No networks found in /etc/cni/net.d

а сеть установили? в каталоге /etc/cni/net.d появился конфиг?

Denis

Denis

Да, появился файл # cat /etc/cni/net.d/10-flannel.conf

{

"name": "cbr0",

"type": "flannel",

"delegate": {

"isDefaultGateway": true

}

}

𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜

Но после того как я сделал apply)

так и должно быть, в мане же так и написанно:

https://kubernetes.io/docs/setup/independent/create-cluster-kubeadm/

Maksim

Maksim

Да, так и должно быть, как оказалось) Но вот версия 1.9.1 на centos7 не завелась

У меня завелась-) Правда у меня он контейнеризирован

Vitalii

Vitalii

привет!

Сталкивались с ситуацией, когда endpoint удаляется из service и не возвращается обратно? Поды при этом в состоянии Ready, selector правильный.

Пересоздание service проблему чинит.

Vitalii

Vitalii

проблема возникает абсолютно случайно и как такое повторить непонятно.

По метрикам видно, что удаляет endpoint-controller.

Пока включил —v=2 логи на apiserver, scheduler, controller-manager

G72K

G72K

RE

RE

камрады, порекомендуйте мануал по развертыванию небольшого кластера на кубернетис.

и вообще чтонить почитать для новичка.

перехожу с докер сворма на кубер, кое что не совсем понятно..

Denis

Denis

Привет! А у кого нибудь есть проблема с Docker 1.12.6 что при большом потоке логов в STDOUT отжирается дохрена памяти?

AB 🇨🇾 🍉

AB 🇨🇾 🍉

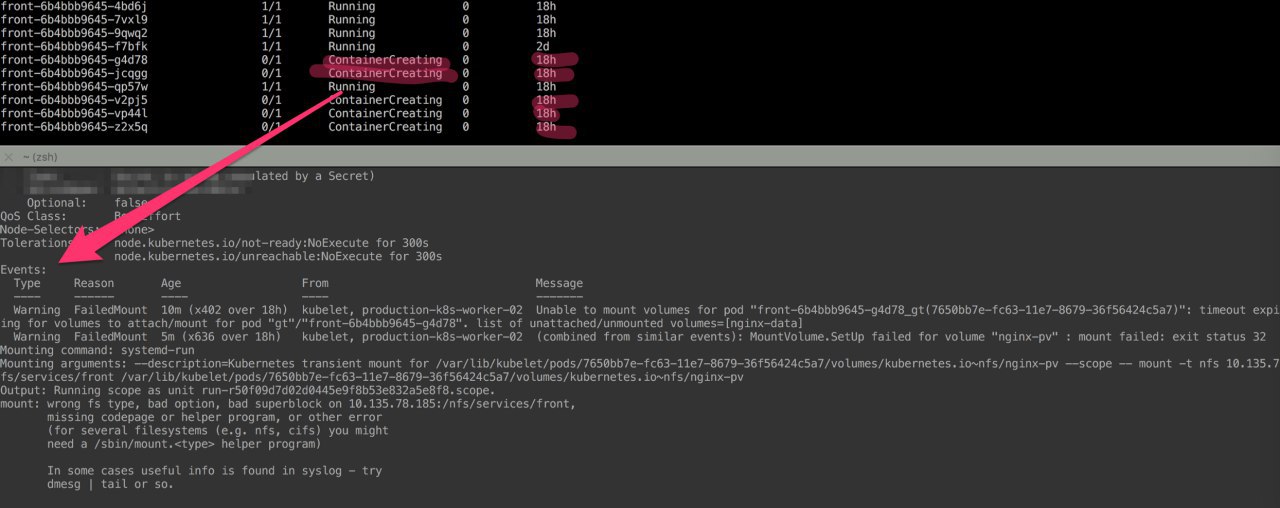

От чего в кубернетисе связка nfs+pv+pvc такое нестабильная? Ставлю реплику 1-10, и часть контейнеров не может примаунтиться

sherzod

sherzod

и при чем куб не пытается даже прибить поды, а ждет уже сутки..

по идее он не должен их прибивать, а рестартить контейнеры постепенно увеличивая таймаут

Igor

Igor

Konstantin

Konstantin

Serega

Serega

Алексей

Алексей

Mikhail [azalio]

Mikhail [azalio]

John

John