Dmitry

Dmitry

Ребят, до сих пор не понимаю как все используя кубера не столкнулись с такой проблемой, если один под обращается по clusterIP с другим подом и они случайно оказались на одном хосте то Коннект больше не установится

Dmitry

Dmitry

Под1 10.0.0.1/24, под2 10.0.0.2/24, под1 обращается по кластер ИП к под2 10.255.0.1/24, далее происходит днат (кластер ИП заменяется на 10.0.0.2), и когда трафик дошел до под2 он начинает отвечать со своего адреса 10.0.0.2 на адрес 10.0.0.1 и тут днат уже не отрабатывает и трафик через бридж идёт напрямую к контейнеру

Anton

Anton

Потому что по уму надо все шел скрипты пускать 'set -ue' а там такое && ошибку выкинет. if чище, но не $? конечно, а 'if Nginx -t; then'

ну тот скрипт конкретно с set -e какой толк запускать? его падение кто вообще зафиксирует?

Serega

Serega

ну вот для теста сделал два пода,

testing svc/echoserver-local 10.0.0.175 <none> 80/TCP 2d app=echoserver-local

testing svc/memcached 10.0.0.8 <none> 11211/TCP 2d k8s-app=memcached

зашел на первый и пингую второй. Все ок. Или я не так вас понял?

Andrey

Andrey

bebebe

bebebe

всё это есть, включая бэкапы

либо вы меня не так поняли, либо врети

https://i.imgur.com/Lx4XedE.png

Даня

Даня

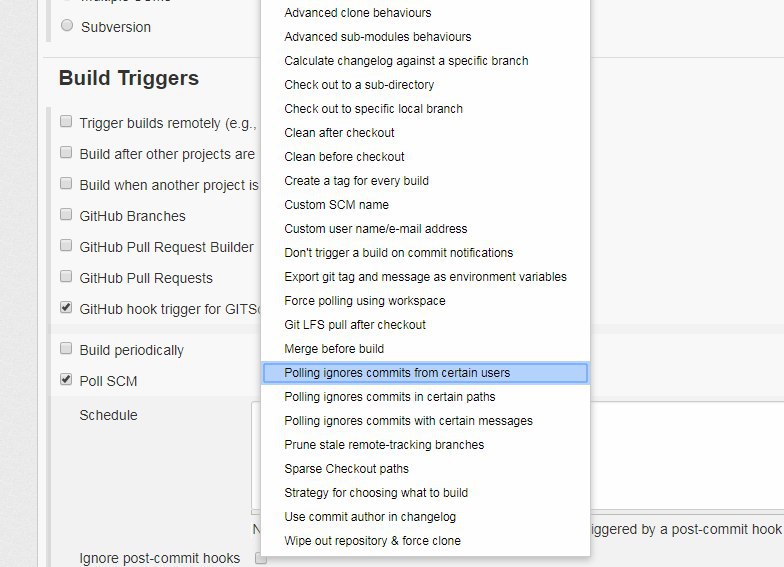

А какой самый просто вариант заставить Jenkins игнорировать свои же коммиты? Сорри за оффтоп

если через гит-хук и у тебя юзер дженкинс

bebebe

bebebe

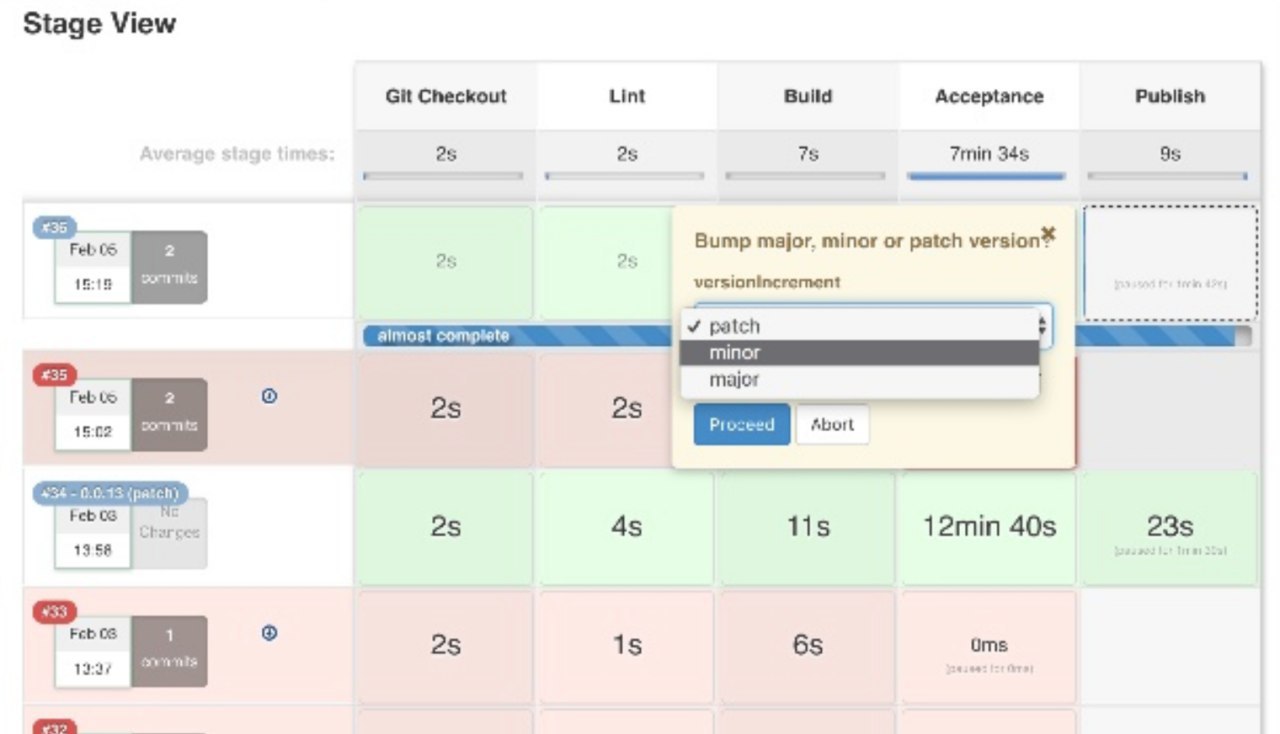

присмотритесь к этому пайплайну, два разных workflow который готовят k8s для aws и baremetal, gitlab не может дожидаться пока стейдж полность не пройдет и запустить другой. впрочем да, это оффтопик

Даня

Даня

А какой самый просто вариант заставить Jenkins игнорировать свои же коммиты? Сорри за оффтоп

только там еще нужно будет врубить force polling using workspace

Andrey

Andrey

либо вы меня не так поняли, либо врети

https://i.imgur.com/Lx4XedE.png

https://docs.gitlab.com/ee/ci/multi_project_pipeline_graphs.html а если хочется бесплатного, то есть https://docs.gitlab.com/ee/ci/triggers/

Vladimir

Vladimir

Под1 10.0.0.1/24, под2 10.0.0.2/24, под1 обращается по кластер ИП к под2 10.255.0.1/24, далее происходит днат (кластер ИП заменяется на 10.0.0.2), и когда трафик дошел до под2 он начинает отвечать со своего адреса 10.0.0.2 на адрес 10.0.0.1 и тут днат уже не отрабатывает и трафик через бридж идёт напрямую к контейнеру

трафик пода к "своему" же сервису не днатится,

-A KUBE-SEP-VFJAMJXL7RM7FULA -s 10.200.2.44/32 -m comment --comment "default/my-service:" -j KUBE-MARK-MASQ

-A KUBE-SEP-VFJAMJXL7RM7FULA -p tcp -m comment --comment "default/my-service:" -m tcp -j DNAT --to-destination 10.200.2.44:80

P.S. на самом деле днатится, но уже после маскарадинга, в под назначения он придет с другим src ip, видимо с ip ноды

Anatoliy

Anatoliy

вы меня опять не поняли, давайте либо в приват уйдем, либо перестанем оффтопить.

если в приват ушли - добавьте меня пожалуйста :)

Anatoliy

Anatoliy

И кстати вопрос по куберу, я могу как-то видоизменять iptables? кубер из за этого ничего там не поломает?

У меня контейнер который билдится докером в поде не имеет доступ в инет(

Anatoliy

Anatoliy

Угу, и меня интересуют последствия если я его уберу, с iptables у меня не очень хорошо, что оно сделает для кубера я вообще не могу понять... впрочем если критичного ничего не будет - можно попробовать убрать)

Serega

Serega

время создавать ci_ru или что-нибудь такое

для мазохистов(и любителей потрындеть) есть devops_ru

Anatoliy

Anatoliy

т.е. вы хотели сказать "на мои вопросы не отвечают"? )))

не только на мои) но написал, посмотрим что они ответят))

Dmitry

Dmitry

трафик пода к "своему" же сервису не днатится,

-A KUBE-SEP-VFJAMJXL7RM7FULA -s 10.200.2.44/32 -m comment --comment "default/my-service:" -j KUBE-MARK-MASQ

-A KUBE-SEP-VFJAMJXL7RM7FULA -p tcp -m comment --comment "default/my-service:" -m tcp -j DNAT --to-destination 10.200.2.44:80

P.S. на самом деле днатится, но уже после маскарадинга, в под назначения он придет с другим src ip, видимо с ip ноды

то что ты скинул это правило выполняется если сервис сам к себе обрашается по кластерному адресу, условие -s и потом происходит днат в самого же себя

Dmitry

Dmitry

ну вот для теста сделал два пода,

testing svc/echoserver-local 10.0.0.175 <none> 80/TCP 2d app=echoserver-local

testing svc/memcached 10.0.0.8 <none> 11211/TCP 2d k8s-app=memcached

зашел на первый и пингую второй. Все ок. Или я не так вас понял?

они должны быть на одной ноде два пода kubectl get pods -o wide

Vladimir

Vladimir

я так и не нашел правила которое делает маскарадинг

-A KUBE-MARK-MASQ -j MARK --set-xmark 0x4000/0x4000 вот так покидает prerouting цепочку

и затем в postrouting-е

-A KUBE-POSTROUTING -m comment --comment "kubernetes service traffic requiring SNAT" -m mark --mark 0x4000/0x4000 -j MASQUERADE

Maksim

Maksim

Мож кто может тут

Стокнулся с такой проблемой

Нужно что бы docker registry аутентифицировал клиентов через

token, однако token сервер не умеет работать только по OAuth 2 При получении токена registry пишет, что токен пописан не доверенным сертификатом, при том что сертифкат указан в конфиге регистра

Dmitry

Dmitry

-A KUBE-MARK-MASQ -j MARK --set-xmark 0x4000/0x4000 вот так покидает prerouting цепочку

и затем в postrouting-е

-A KUBE-POSTROUTING -m comment --comment "kubernetes service traffic requiring SNAT" -m mark --mark 0x4000/0x4000 -j MASQUERADE

чтоб попасть в эту цепочку сервис должен сам себе отправить пакет на кластерип -A KUBE-SEP-VFJAMJXL7RM7FULA -s 10.200.2.44/32 -m comment —comment "default/my-service:" -j KUBE-MARK-MASQ

Maksim

Maksim

мож запуск с другим сертом был

а как ты ключ в регистр добавлял? есть мнение что я его не правильно кидаю

Anatoliy

Anatoliy

А есть что-то что что бы докер мог начать в инет ходить?

Даже если просто руками

docker run -it --rm alpine /bin/ash

запускаю ничего не пингуется(снаружи).

Serega

Serega

они должны быть на одной ноде два пода kubectl get pods -o wide

я помню ваш кейс. Вывод подов с миникубе )

Anatoliy

Anatoliy

вы еще не расшарили доступ до своего окружения чатику? :)

звиняйте но нет) Да и осталось то немного в принципе)

не понимаю почему если стартовать докер руками там сети нет(

Делаю docker build в одном из подов и тот образ что создается не может закачать себе все что ему необходимо( Падает по таймауту(

bebebe

bebebe

я помню ваш кейс. Вывод подов с миникубе )

Кстати никто не заметил что миникуб испортился? С последним релизом те же проблемы

Serega

Serega

про dind читал. не работает

даю наводку

http://jpetazzo.github.io/2015/09/03/do-not-use-docker-in-docker-for-ci/

Anatoliy

Anatoliy

даю наводку

http://jpetazzo.github.io/2015/09/03/do-not-use-docker-in-docker-for-ci/

docker run -v /var/run/docker.sock:/var/run/docker.sock \

-ti docker

Вот так и пользуюсь

Anatoliy

Anatoliy

Но блин мне не важно так я это запускаю или нет. у меня нет сети во всех контейнерах которые я запускаю руками.

Вот просто

docker run -it --rm alpine sh

и там ping 8.8.8.8 - не работает

Andrey

Andrey

Logan

Logan

Etki

Etki

Vladyslav

Vladyslav