Я не знаю деталей как это у них внутри реализовано, но, конечно, это виртуальный айпишник, и у нескольких нод не может быть один и тот же айпишник по понятным причинам

подозреваю что это VRRP в том или ином виде

Sergey

Sergey

сервис ставится на балансинг в амазоновском елб, а экстернал-днс делает алиас на этот лб в роуте53

Serhii

Serhii

Какой у вас проект или где работаете?

Агрегатор билетов

В чём вы специалист?

Бекенд разработчик

Откуда вы?

Киев

Как узнали про группу?

Голанг чат

#whois

Yura

Yura

#whois

Проектов много, аутсорсинговая компания

php, yii2

Не знаю)

Интересует тема

Великий Новгород

Из группы golang ru

Lanegan

Lanegan

#whois

▫️Какой у вас проект или где работаете? - проект многоканальная рассылка

▫️В чём вы специалист? - php, java SE, 1c

▫️Чем можете быть интересны или полезны сообществу? - чем смогу, помогу :)

▫️Чем интересно сообщество вам? High load

▫️Откуда вы? - Москва

▫️Как узнали про группу? - golang_ru

Logan

Logan

это странно, потому как половина старожилов го сидит тут. И наоборот. Мы с гошниками давно дружим

Alexey 〒.

Alexey 〒.

Какой у вас проект или где работаете?

тг боты, микросервисы

В чём вы специалист?

Бекенд разработчик (java, go)

Откуда вы?

Мск

Как узнали про группу?

golang_ru

#whois

Zloy-Dobry

Zloy-Dobry

это странно, потому как половина старожилов го сидит тут. И наоборот. Мы с гошниками давно дружим

Только эти гошники пишут еа пхп

Ivan

Ivan

Всем привет!

Столкнулся с такой проблемой - поднимаю сервис, прописываю в нём порты:

type: NodePort

ports:

- name: http

protocol: TCP

port: 80

targetPort: 7180

- name: https

protocol: TCP

port: 443

targetPort: 7143

а когда он запускается, по факту пробрасывается это:

80:30743/TCP,443:2153/TCP

подскажите, с чем это может быть связано и куда копать?

перечитал пару раз мануал по сервисам кубернета - даже намёка не нашёл.

т.е. по факту кубернет игнорирует прописанные в конфиге порты и присваивает случайные.

самое интересное, что даже по этим случайным портам до контейнера достучаться невозможно((

Etki

Etki

If you want a specific port number, you can specify a value in the nodePort field, and the system will allocate you that port or else the API transaction will fail (i.e. you need to take care about possible port collisions yourself). The value you specify must be in the configured range for node ports.

Etki

Etki

kind: Service

apiVersion: v1

metadata:

name: my-service

spec:

selector:

app: MyApp

ports:

- protocol: TCP

port: 80

targetPort: 9376

nodePort: 30061

# ^^^ вот этого я так понимаю не хватает

Ivan

Ivan

kind: Service

apiVersion: v1

metadata:

name: my-service

spec:

selector:

app: MyApp

ports:

- protocol: TCP

port: 80

targetPort: 9376

nodePort: 30061

# ^^^ вот этого я так понимаю не хватает

странно. по мануалу и таргет-порт и ноде-порт указываются только для лодбалансера

https://kubernetes.io/docs/concepts/services-networking/service/

Maksim

Maksim

В случае если NodePort не указан, кубер берёт рандомный из диапазона установленного ключём —nodeports на старте аписервера

Maksim

Maksim

ну попробую, вдруг прокатит... с мануалами у них не особо...

Мануалы написаны как справочник для знающих кубер)

Etki

Etki

странно. по мануалу и таргет-порт и ноде-порт указываются только для лодбалансера

https://kubernetes.io/docs/concepts/services-networking/service/

я ровно с этой страницы цитату выцепил

Maksim

Maksim

я ровно с этой страницы цитату выцепил

Ну и да читать там нужно каждую букву, концетрация знания там максимальная. (Это на корпоративные мунуалы, где можно по диагонали читать)

Maksim

Maksim

часть написано для Кубера в GCE часть дл ястенд элоне. часть для поднятого миникубом часть из сырцов

Ivan

Ivan

kind: Service

apiVersion: v1

metadata:

name: my-service

spec:

selector:

app: MyApp

ports:

- protocol: TCP

port: 80

targetPort: 9376

nodePort: 30061

# ^^^ вот этого я так понимаю не хватает

ага, порты вроде нарисовались правильно!

спасибо!

Ivan

Ivan

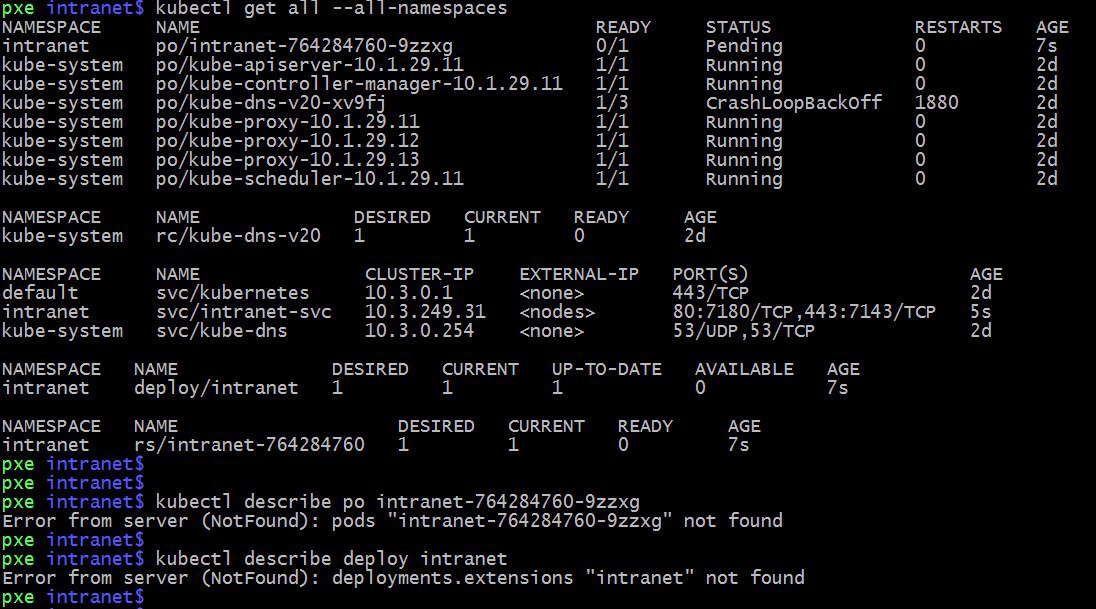

и ещё один вопрос у меня есть))

а как понять, почему контейнер не поднимается?

он висит в статусе Pending

и при этом "kubectl describe po" и "kubectl describe deploy" гооврят, что таких нет, хотя реально они есть))

Ivan

Ivan

официальный мануап косячный. там через реплика-контроллер делается, а надо конфиги на даймон-сет переписать, иначе все три экземпляра пытаются подняться на одной ноде

Maksim

Maksim

официальный мануап косячный. там через реплика-контроллер делается, а надо конфиги на даймон-сет переписать, иначе все три экземпляра пытаются подняться на одной ноде

Кто сказал что косячный?/ Есть ещё affinity

Ivan

Ivan

ну я не знаю, зачем они через реплика-контроллер написали

https://coreos.com/kubernetes/docs/latest/deploy-addons.html

они же доджны по одному на ноду работать а не все на одной ноде

Maksim

Maksim

второй это контроллер DNS, который лазит в апи сервер и подготавливает файлик hosts. Третий это не посредственно ДНС, который читает файлик hosts и резолвит

Maksim

Maksim

кто мануал этот писал))

в общем, как руки дойдут - перепишу на даймон-сет

так что проблема не в писателе, а в читателе

Sergey

Sergey

если вы раните под на хостах с определенным лейбом, а хостов таких 2, а реплик надо 3 - ну вы поняли

Ivan

Ivan

так что проблема не в писателе, а в читателе

да, видимо я не досмотрел и сделал поспешные выводы))

l1njan

l1njan

здравствуйте, я с глупым вопросом. поднял последний k8s по ману: https://kubernetes.io/docs/setup/independent/create-cluster-kubeadm/ ; использовал calico как сеть

попытался поставить nginx-ingress-controller вот так: kubectl apply -f https://rawgit.com/kubernetes/ingress/master/examples/deployment/nginx/kubeadm/nginx-ingress-controller.yaml

но получаю nginx-ingress-controller-799cd4fcd7-g6b6c 0/1 CrashLoopBackOff в списке get pods

логи говорят следующее:

# kubectl logs nginx-ingress-controller-799cd4fcd7-g6b6c -n kube-system

I1002 11:08:24.985933 7 launch.go:112] &{NGINX 0.9.0-beta.13 git-949b83e https://github.com/kubernetes/ingress}

F1002 11:08:24.999813 7 launch.go:130] ✖️ It seems the cluster it is running with Authorization enabled (like RBAC) and there is no permissions for the ingress controller. Please check the configuration

подскажите, пожалуйста, куда копать?

Vegas

Vegas

https://github.com/projectcalico/calico/blob/master/v2.3/getting-started/kubernetes/installation/hosted/index.md

RBAC

If using Calico with RBAC, apply the ClusterRole and ClusterRoleBinding specs:

kubectl apply -f {{site.url}}/{{page.version}}/getting-started/kubernetes/installation/rbac.yaml

l1njan

l1njan

Mikhail [azalio]

Mikhail [azalio]

Øk_gø_løve

Øk_gø_løve