dk

dk

хард вей от кейси что бы понимать как там и вче ставится и между собой работает

Хотя да, так лучше, наверное, будет

Роман

Роман

так докер для кубера с айпитейбл фолс надо запускать

У меня на одной ноде работает gitlab-ci-multi-runner. На этой ноде у меня стоит iptables=true для докера, ибо, в противном случае, поды, созданные мульти-раннером, не имеют доступа в интернет. Не знаю почему и кто виноват, но только так работает.

Roman

Roman

а при падении одной из нод кубер не должен разве перекидывать поды на живые ноды? запускаю через ReplicationController...

Роман

Роман

а при падении одной из нод кубер не должен разве перекидывать поды на живые ноды? запускаю через ReplicationController...

По моему должен. Если не стоит nodeSelector.

Roman

Roman

ага, перекинул 2 реплики nginx.. но суммано зарегано 3 реплики - 2 живых и 1 в состоянии Unknown на ноде, которую зашатдаунил... ща разбираюсь как подчистить эти хвосты...

Mikhail [azalio]

Mikhail [azalio]

Я недавно поднимал фланель с докером на центос и тоже наткнулся на дроп по умолчанию в форварде

Sergey

Sergey

Так у докера с какого то релиза по умолчанию дроп на форвард и народ много и долго бугуртил на этот счёт

Roman

Roman

а есть какая-то волшебная команда чтобы убрать сходшую ноду из кластера? что-то не гуглится :-/

Maksim

Maksim

По идее ему пофигу,должен был удалить :)

он мог решить, что на нём поды, и после команды delete ждать, когда поды уедут

Maksim

Maksim

1й определяет время обновления статусы ноды 2й ждёт, типо вдруг нода вернётся 3й это время переезда подов

Mikhail [azalio]

Mikhail [azalio]

http://container-solutions.com/kubernetes-hard-way-explained-chapter-1/?utm_source=telegram.me&utm_medium=social&utm_campaign=v-bloge-container-solutions-nachalas-ser - разжуют в рот положат!

dk

dk

https://github.com/kelseyhightower/kubernetes-the-hard-way

Оно?

Это точно не реклама гугель-клауда?

Mikhail [azalio]

Mikhail [azalio]

кто знает что будет если у меня 3 апи сервера, а тут --apiserver-count int написано 2? )

bebebe

bebebe

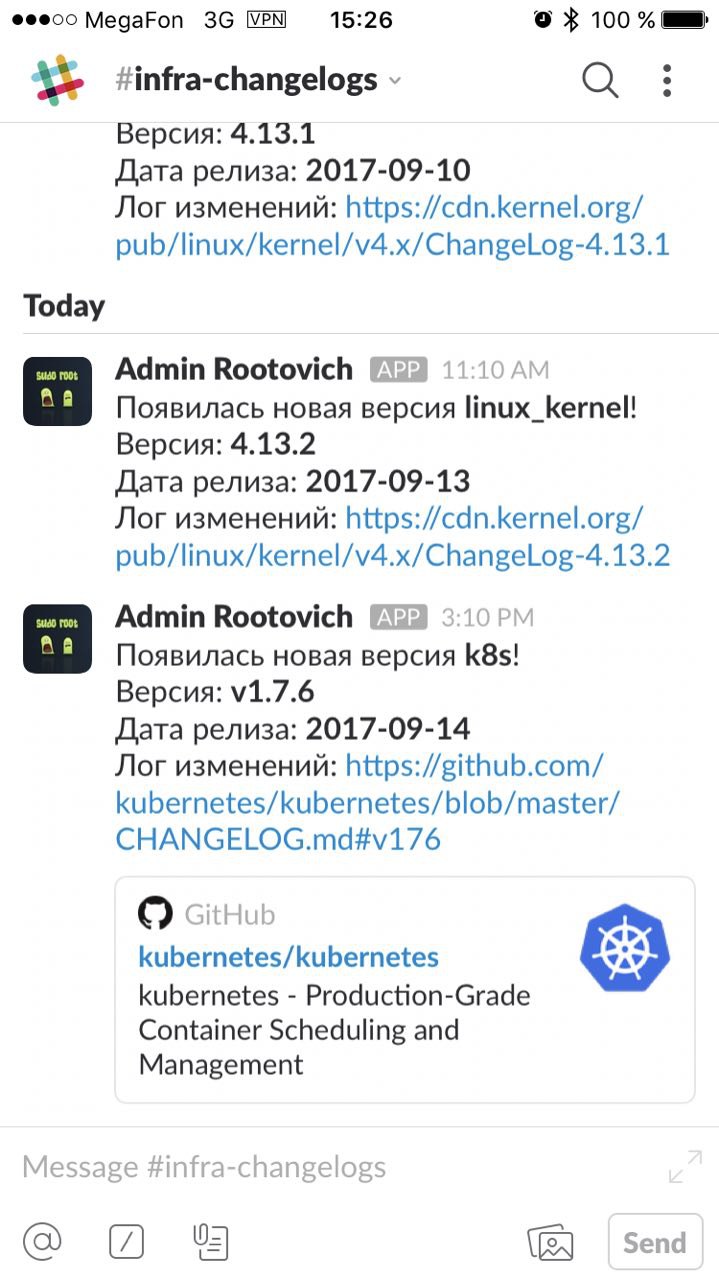

k8s 1.7.6 is out

https://github.com/kubernetes/kubernetes/blob/master/CHANGELOG.md#changelog-since-v175

Nikita

Nikita

причем не полнятно почему, вроде саммый обычный deployment

apiVersion: extensions/v1beta1

kind: Deployment

metadata:

name: elasticsearch

labels:

app: elasticsearch

cmp: services

spec:

replicas: 1

template:

metadata:

labels:

app: elasticsearch

cmp: services

spec:

containers:

- name: main

image: elasticsearch:5.5.2

imagePullPolicy: Always

ports:

- name: elastic

containerPort: 9200

protocol: TCP

G72K

G72K

кто знает что будет если у меня 3 апи сервера, а тут --apiserver-count int написано 2? )

норм, они будут подменять свою запись в днс постоянно, но зато если 1 уйдет в даун, то висячей записи не останется

Mikhail [azalio]

Mikhail [azalio]

норм, они будут подменять свою запись в днс постоянно, но зато если 1 уйдет в даун, то висячей записи не останется

у меня bare-metal и запись одна на 3

G72K

G72K

у меня bare-metal и запись одна на 3

внутри куба есть свой dns, вот в нем есть запись kubernetes.default.svc.cluster.local вот в нее и добавляют свои ип

Maksim

Maksim

Ребят, а можено задать какой-то скрипт, который будет запускаться в поде после его старта, но не заменяя entrypoint и command у контейнера

G72K

G72K

очень вероятно, что используете. все контроллеры внутри ходят туда (nginx-ingress, external-dns, какой-нибудь prometheus operator)

G72K

G72K

Mikhail [azalio]

Mikhail [azalio]

очень вероятно, что используете. все контроллеры внутри ходят туда (nginx-ingress, external-dns, какой-нибудь prometheus operator)

`$ kubectl get deploy --all-namespaces

NAMESPACE NAME DESIRED CURRENT UP-TO-DATE AVAILABLE AGE

kube-system kube-state-metrics 1 1 1 1 1d

kube-system kubernetes-dashboard 1 1 1 1 1d` )

Anonymous

Anonymous

@DenisIzmaylov

вот ребята сделали хорошего чистильщика спама

@daysandbox_bot

он по определенным паттернам удаляет сразу же сообщения и пишет причину

Knyage

Knyage

Andrey

Andrey

Lev

Lev

Magistr

Magistr

Denis

Denis