Роман

Роман

Что-то фигня какая-то. api_servers указал, но всё равно прометей пишет:

Kubernetes SD configuration requires at least one Kubernetes API server

Роман

Роман

Maksim

Maksim

Что бы поды имели конкретную айдентику

Нет. Это лишь побочный эффект. Statefull set нужен что бы запускать опр. зависимости контейнерров

Denis

Denis

Dmitry

Dmitry

Stateful ты можешь жестко привязать pv к поду, и каждый рез при поднятии пода, к нему будет подключаться его pv

Maksim

Maksim

Собсно тут statefull сет используется что бы перед запуском es изменить кол-во страниц памяти в систему

Anonymous

Anonymous

Насчет ES еще вот так можно (если я верно понял о чем речь):

https://github.com/pires/kubernetes-elasticsearch-cluster/blob/5a83c043c4b84288c544a291bb1e888e0d3a90c6/es-client.yaml#L16

Maksim

Maksim

а ясказал, что это лишь один из...более того не самым главным, досталось по наследству от pet set

Anonymous

Anonymous

😱😱😱😱

что за жесть, я когда обновляю страничку с моей единственной нодой, то он меняет их system uuid, то есть перенаправляет то на одну, то на другую ноду

это из-за того, что у них имена одинаковые или почему так?

Ivan

Ivan

Что ему может быть нужно?

попробуй оставить пустым апи сервер если пром у тебя в кубе, вот пример:

- job_name: 'kubernetes-apiservers'

scheme: https

tls_config:

ca_file: /var/run/secrets/kubernetes.io/serviceaccount/ca.crt

insecure_skip_verify: true

bearer_token_file: /var/run/secrets/kubernetes.io/serviceaccount/token

kubernetes_sd_configs:

- role: endpoints

api_server:

Anonymous

Anonymous

а то я развернул master-etcd-agent полный набор на 2 ноды, и когда вырубаю одну, то всё падает(

Error from server: etcdserver: request timed out

Роман

Роман

попробуй оставить пустым апи сервер если пром у тебя в кубе, вот пример:

- job_name: 'kubernetes-apiservers'

scheme: https

tls_config:

ca_file: /var/run/secrets/kubernetes.io/serviceaccount/ca.crt

insecure_skip_verify: true

bearer_token_file: /var/run/secrets/kubernetes.io/serviceaccount/token

kubernetes_sd_configs:

- role: endpoints

api_server:

Да, так работает. Если ставлю role: node то не работает. А без роли - нормально.

Anonymous

Anonymous

в k8s, а то мне не очень понятно почему он видит одну ноду, но когда я обновляю страницу с инфой о ноде, то он меняет значения system uuid, то одной ноды, то другой (не знаю как еще это объяснить)

крч кластер работает на двух нодах, но в инфе показывает только одну

kås

kås

в k8s, а то мне не очень понятно почему он видит одну ноду, но когда я обновляю страницу с инфой о ноде, то он меняет значения system uuid, то одной ноды, то другой (не знаю как еще это объяснить)

крч кластер работает на двух нодах, но в инфе показывает только одну

страница с инфой о ноде это какая?

Logan

Logan

в k8s, а то мне не очень понятно почему он видит одну ноду, но когда я обновляю страницу с инфой о ноде, то он меняет значения system uuid, то одной ноды, то другой (не знаю как еще это объяснить)

крч кластер работает на двух нодах, но в инфе показывает только одну

начнем с простого - сколько нод и сколько апи-серверов? апи-сервера друг о друге знают вообще?

Anonymous

Anonymous

страница с инфой о ноде это какая?

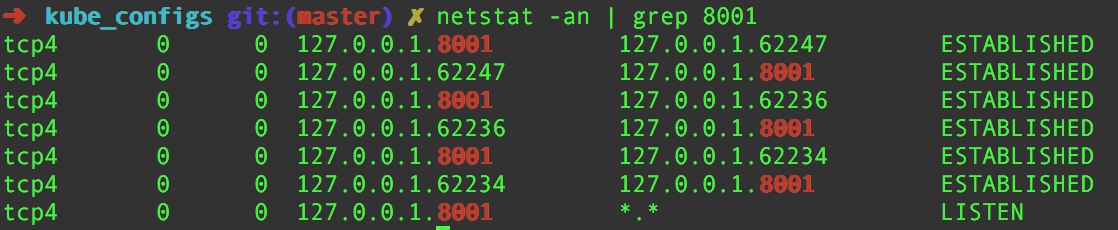

http://localhost:8001/api/v1/namespaces/kube-system/services/kubernetes-dashboard/proxy/#!/node/ubuntu-1604-xenial-64-minimal?namespace=default

вот типа такая url для ui

Anonymous

Anonymous

начнем с простого - сколько нод и сколько апи-серверов? апи-сервера друг о друге знают вообще?

2 ноды, на каждой стоит master-etcd-agent

они друг о друге знают, я это определил так: поднял какой-то сервис, зашел по ssh на другую машину и увидел этот же сервис через kubectl

Anonymous

Anonymous

http://localhost:8001/api/v1/namespaces/kube-system/services/kubernetes-dashboard/proxy/#!/node/ubuntu-1604-xenial-64-minimal?namespace=default

вот типа такая url для ui

проблема видимо в том, что k8s определяет ноду по hostname, а он не уникален(

Anonymous

Anonymous

кажется что напрямую, разворачивал через kubespray, если подскажете как это перепроверить, то я это сделаю :)

Logan

Logan

выясни, на каком порту у тебя апи на мастере. И проверь, нету ли на мастере балансировщика. Есть подозрение, что у тебя два мастера и ты по очереди попадаешь то на один, то на второй.

зачем ты сделал две машины в одном кластере и с одним именем - спрашивать, конечно, бессмыслено?

Anonymous

Anonymous

так получилось :c

я уже решил, что проще переделать конечно, просто не ожидал подвоха с этой стороны

Logan

Logan

с точки зрения куба проблем, я так понимаю, нет. А вот с точки зрения диагностики...

Я бы рекомендовал, для начала:

- три ноды, а не две

- разные имена

- переделать

Logan

Logan

да как бы не за что. Деплой куба - очень болезненная тема. Способов - как блох, и все они не работают.

И все - по-разному

Maksim

Maksim

да как бы не за что. Деплой куба - очень болезненная тема. Способов - как блох, и все они не работают.

И все - по-разному

Почему? Все сводится к одному и тому же просто разными способами....

Magistr

Magistr

Sergei

Sergei

Etki

Etki