Logan

Logan

какой самый православный способ поднять кубер на CentOS bare-metal? kubespray?

этот вопрос тут всплывает с такой частотой, что впору его пинить. Нет такого способа. Карго для любителей ансибла, марсианский кукбук - для любителей шефа, кубе-адм для маленьких тестовых инсталляциях

Dmitry

Dmitry

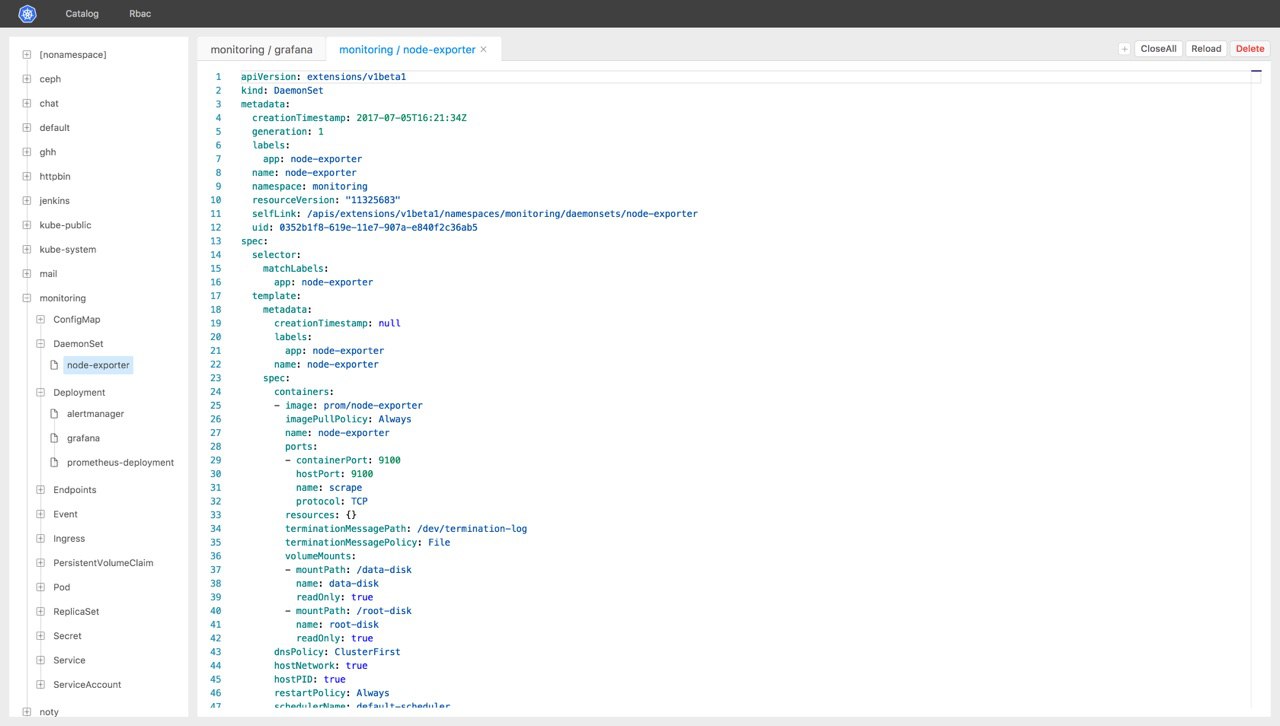

кстати, мы тут в команде запилили альтернативный low-level UI для кубов. для любителей редактировать yaml руками

Роман

Роман

этот вопрос тут всплывает с такой частотой, что впору его пинить. Нет такого способа. Карго для любителей ансибла, марсианский кукбук - для любителей шефа, кубе-адм для маленьких тестовых инсталляциях

А кубеадм разве плохо подходит для больших проектов?

Dmitry

Dmitry

А кубеадм разве плохо подходит для больших проектов?

ну вообще там при запуске kubeadm написано don’t use in production

Logan

Logan

А кубеадм разве плохо подходит для больших проектов?

в нем нет файловера. А без файловера запускать продакшн – самоубийство

Dmitry

Dmitry

в нем нет файловера. А без файловера запускать продакшн – самоубийство

тут https://github.com/kubernetes-incubator/kubespray написано, что The firewalls are not managed, you'll need to implement your own rules the way you used to. in order to avoid any issue during deployment you should disable your firewall.

A

A

Ребята, и всё-таки, что нужно сделать с RBAC, чем-то ещё, чтобы просто запустить хотя бы вот такой экзампл? https://github.com/nginxinc/kubernetes-ingress/tree/master/examples/complete-example

A

A

Чистый kubeadm с weave, ничгео не трогалось. Сервисы стартуют, но ingress не работает: просто никто не слушает на нужных портах и всё.

Sergei

Sergei

А можно пояснить, что подразумевается под failover'ом ?

устойчивость кластера к падению одного из мастеров.

Роман

Роман

Khramov

Khramov

Так чем kubeadm не устраивает? Мы на нем 3 мастера подняли, и пока 2 живы, все ок. И то 2 нужно чтобы кластер etcd не упал только, а так и одного достаточно

Logan

Logan

Так чем kubeadm не устраивает? Мы на нем 3 мастера подняли, и пока 2 живы, все ок. И то 2 нужно чтобы кластер etcd не упал только, а так и одного достаточно

три мастера в файловере? а давно кубеадм так умеет? в версии 1.4 и 1.5 точно не умел

Khramov

Khramov

Ну сам kubeadm такого не умеет, с помощью него делается 1 мастер и джойнятся куча нод. Но чтобы дополнительно превратить еще 2 ноды в 2 мастера нужно минут 20, не больше.

Перегенерировать сертификаты и немного поправить kubeapi в манифесте и все

✙ Egor ✙

✙ Egor ✙

Guys, есть работа в Киеве для девопса и девелопера. Проект новый, стек - go, kubernetes, consul, elasticsearch, kafka, cassandra, prometheus. Кому интересно - пишите в личку.

Роман

Роман

G72K

G72K

НИЗЯ

https://docs.docker.com/engine/userguide/networking/configure-dns/

если очень хочется, то можно. если kubelet настроен на CNI, то контейнер запускатся вообще с net=none, потом CNI скрипты конфигурируют сеть, а kubelet пишет свой resolv.conf

G72K

G72K

Кто-нибудь знает как на kubeadm сделать renew сертификатов?

осторожней, сертификаты часто используются и для --service-account-key-file, а значит когда оно сменится, то все предыдущие serviceaccounts будут пытаться подсунуть токен, который не пройдет проверку. даже если вы обновите ключ для serviceaccounts (достаточно их удалить,они пересоздадутся например), то надо будет перезапустить все запущенные поды, т.к. они все используют go-client, а он не умеет читать обновленный токен с диска, который куб заботливо положил рядом и даже обновил

Салтыдык

Салтыдык

G72K

G72K

(если kubeadm так не делает и токены для serviceaccount генерируются не из сертифкатов, то плюс ему в карму)

Салтыдык

Салтыдык

(если kubeadm так не делает и токены для serviceaccount генерируются не из сертифкатов, то плюс ему в карму)

ещё как из сертификатов. Там помимо serviceaccout ещё config map'ы есть с сертификатами внутри

Салтыдык

Салтыдык

лел, сейчас на третью багу наткнулся, нода не может зарегистрироваться (нода называется с большой буквы, а пытается зарегистрироваться с маленькой)

Салтыдык

Салтыдык

https://github.com/kubernetes/kubernetes/blob/c8c4fff8be1c1da08a6dec37f8aee44e2a426456/plugin/pkg/admission/noderestriction/admission.go#L211

Dmitry

Dmitry

я помню мне тут говорили, что я неправильный, если хочу эту фичу. в итоге завел ceph, но скорости сети не хватило. тоже свой hostPath provisioner пришлось на коленке написать и плюс модифицировать kube-scheduler.

G72K

G72K

> нужно привязывать поды к нодам

это и раньше было, нет?

> создавать шарды из volumes

не совсем понимаю, что это значит

спрашиваю потому, что я может тоже хочу local volumes, но не знаю об этом

G72K

G72K

https://github.com/kubernetes-incubator/external-storage/tree/master/local-volume

я видимо EBS избалован, может на свое железе оно и полезно

Ivan

Ivan

Pavel

Pavel