Следующий - в марте :) Скоро будет анонс. Сейчас ищем интересные доклады.

Openshift+ceph ннадо?)

Denis

Denis

https://medium.com/microscaling-systems/microscaling-a-kubernetes-cluster-53d08f2f8041#.ku7xuh2ry

Zon

Zon

Смотрел кто-нибудь на https://github.com/microscaling/microscaling ? :)

Мысль здравая, по сути аутоскейлинг не по памяти/процу, а по внешней метрике. Если ещё нет этого в сиггруппах нужно закинуть

Denis

Denis

А кто-нибудь настраивал Federation? https://coreos.com/blog/kubernetes-cluster-federation.html

Sn00part

Sn00part

если настроить etcd, то federation работает. правда это глубокая бета, я в прод бы поостерегся

Aleksey [MSK+4]

Aleksey [MSK+4]

etcd теряет коннективность и потом и кворум. можно подкрутить таймауты

между дц теряет или где? сколько машин в кластере при этом?

Sn00part

Sn00part

ещё я так понимаю там косты растут из-за служебного трафика. сколько я ещё не разбирался, но по прикидкам до 30% увеличение сетевой нагрузки, смотря как хорошо работает сеть в дц

Sn00part

Sn00part

у меня есть совсем угрюмые дц, с латенси больше 1000 и ещё асинхронные совсем. севера, там особенности такие. на следующей неделе планирую затестить и их тоже

Dmitriy

Dmitriy

Привет, Всем! помогите пожалуйста с пролемой. На нодах не поднимаются pod'ы, находятся в состоянии pending. Узнал что виной тому сообщения KubeletHasSufficientDisk, KubeletHasSufficientMemory и KubeletHasNoDiskPressure, которые у меня на каждой ноде в кластере, а потому scheduler не хочет распределять контейнеры по нодам. Как примерно разрешить эту ситацию? Искал, но так и не смог найти подходящего решения.

Anonymous

Anonymous

Хорошо бы знать значения тех ключей которые ты приводишь, но вероятно на нодах кончилось место.

Dmitriy

Dmitriy

Хорошо бы знать значения тех ключей которые ты приводишь, но вероятно на нодах кончилось место.

нет, чистые ноды, только после установки. Развернул кластр с нуля. Да и места много отведено под кластер, точнее под /var в котором я полагаю хранятся данные для запуска

Anonymous

Anonymous

Тогда не очень понятно откуда такой вывод

"Узнал что виной тому сообщения KubeletHasSufficientDisk, KubeletHasSufficientMemory и KubeletHasNoDiskPressure, "

Dmitriy

Dmitriy

Хорошо бы знать значения тех ключей которые ты приводишь, но вероятно на нодах кончилось место.

OutOfDisk False Fri, 17 Feb 2017 17:29:06 +0600 Mon, 13 Feb 2017 10:50:16 +0600 KubeletHasSufficientDisk kubelet has sufficient disk space available

MemoryPressure False Fri, 17 Feb 2017 17:29:06 +0600 Wed, 08 Feb 2017 17:54:11 +0600 KubeletHasSufficientMemory kubelet has sufficient memory available

DiskPressure False Fri, 17 Feb 2017 17:29:06 +0600 Wed, 08 Feb 2017 17:54:11 +0600 KubeletHasNoDiskPressure kubelet has no disk pressure

Ready True Fri, 17 Feb 2017 17:29:06 +0600 Mon, 13 Feb 2017 10:50:16 +0600 KubeletReady kubelet is posting ready status

Dmitriy

Dmitriy

сетку я проверял, работает, в самом начале после инсталяции запустил два контейнера с двумя репликами, на разных нодах. Они друг друга видели

Dmitriy

Dmitriy

в логах etcd ругань: etcd[2952]: transport: http2Client.notifyError got notified that the client transport was broken unexpected EOF.

Dmitriy

Dmitriy

kube-apiserver[3116]: W0215 06:44:44.967718 3116 controller.go:392] Resetting endpoints for master service "kubernetes" to &TypeMeta{Kind:,APIVersion:,}

Logan

Logan

А кто-нибудь настраивал Federation? https://coreos.com/blog/kubernetes-cluster-federation.html

мне это предстоит, я статью напишу об опыте, если интересно будет

Anonymous

Anonymous

у меня два кластера но между ними китайский фаервол, я че-то пока очкую объединять учитывая лаги, тем более юзкейсов не вижу

Logan

Logan

у меня два кластера но между ними китайский фаервол, я че-то пока очкую объединять учитывая лаги, тем более юзкейсов не вижу

без прямой договоренности с китайской СБ это, имхо, нереально

Logan

Logan

насколько я знаю, можно получить право на "трубу" от китайского МВД, но просить придется очень, очень тщательно

Anonymous

Anonymous

ну они парсят только 80 и 443, остальной трафик просто медленно через их роутеры идет потому что они заняты парсингом :)

Anonymous

Anonymous

дело в том что по опыту там скорость не гарантированая: может мегабит в секунду давать, а через минуту меньше модема из 90-х

Sergei

Sergei

Господа, есть у кого нибудь опыт работы с кубом в digitalocean?

а чем он отличается от всего остального?

l1njan

l1njan

коллеги, я наверное не там вопрос задаю. но не знаю куда еще. на конфе услышал про то, linux bridge для обеспечения сети в виртуалках KVM - какашка. и вместо него надо использовать что-то иное. но вот что?

Михаил

Михаил

l1njan

l1njan

почитал. здесь вот теперь тоже пишут, что brctl - deprecated: http://www.linux-kvm.org/page/Networking

но депрекейтед, наверное, потому, что redhat/centos 7 переехал на утилиту ip

а не потому, что что-то плохо

l1njan

l1njan

как теперь найти того человека с конфы, с которым я на галерке сидел, он еще наклейки получил?)

Alex

Alex

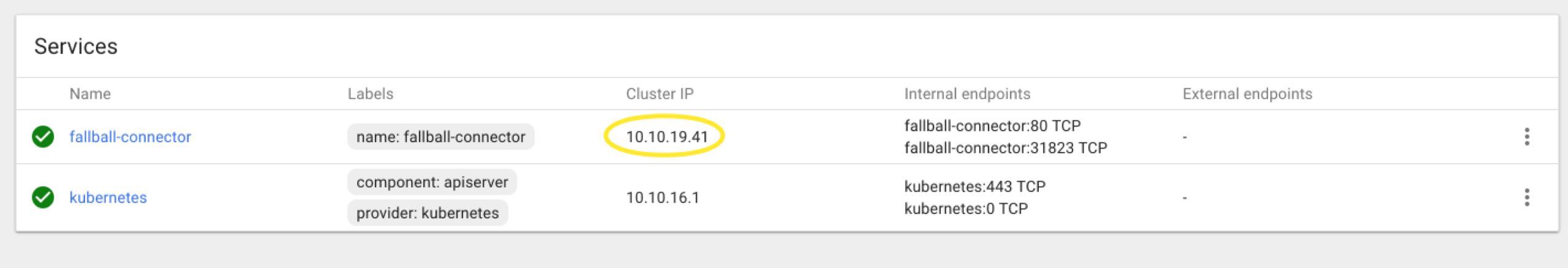

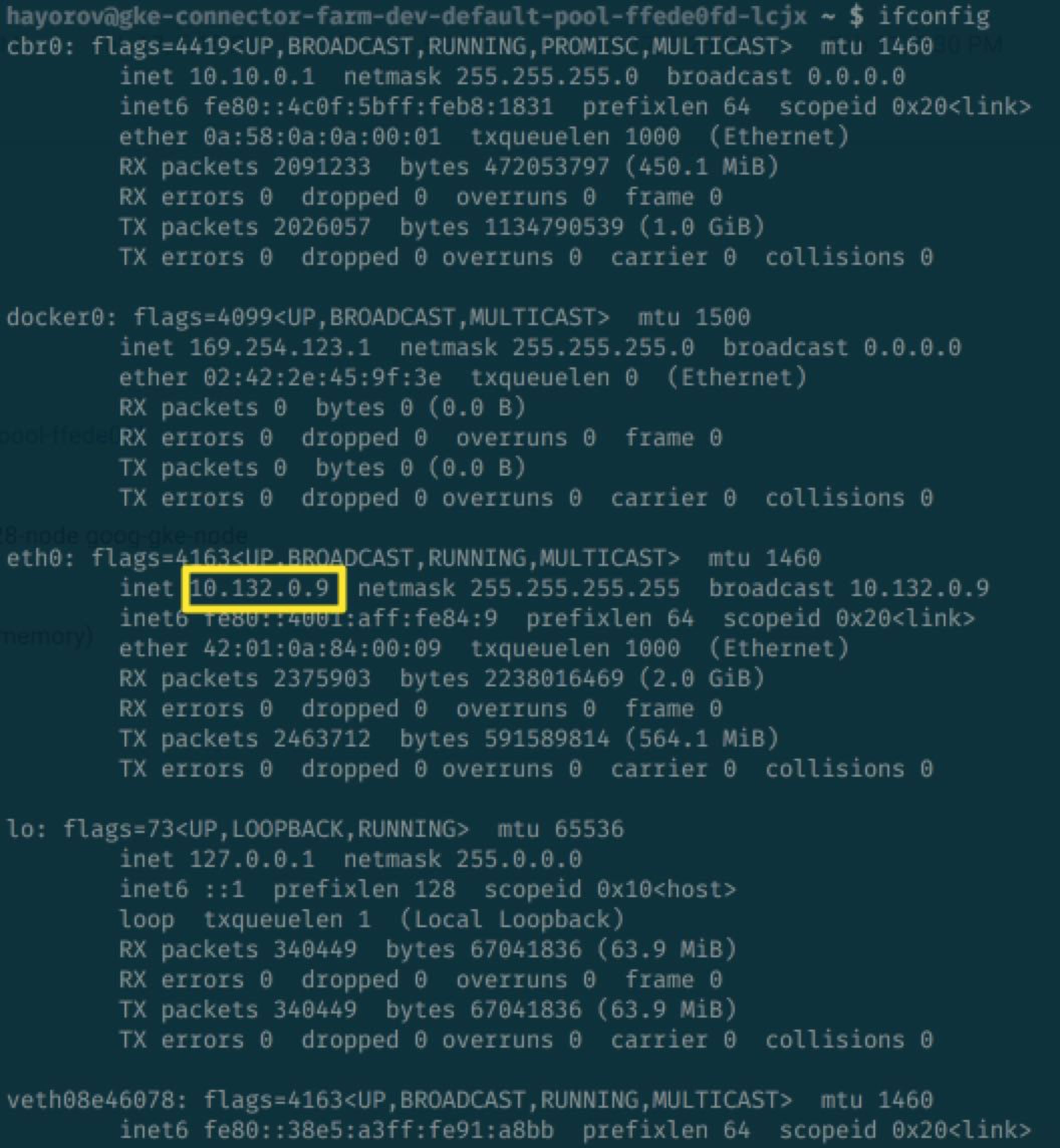

подскажите как выставить сервис на IP адрес не кластера, (у меня это 10.132.x), а Internal IP (у каждой ноды кластера есть такой адрес в GKE)? Я был уверен читая доку что для этого нужно использовать NodePort, у меня это так

apiVersion: v1

kind: Service

metadata:

name: fallball-connector

labels:

name: fallball-connector

spec:

type: NodePort

ports:

- port: 80

targetPort: 5000

protocol: TCP

selector:

name: fallball-connector

Михаил

Михаил

Logan

Logan

подскажите как выставить сервис на IP адрес не кластера, (у меня это 10.132.x), а Internal IP (у каждой ноды кластера есть такой адрес в GKE)? Я был уверен читая доку что для этого нужно использовать NodePort, у меня это так

apiVersion: v1

kind: Service

metadata:

name: fallball-connector

labels:

name: fallball-connector

spec:

type: NodePort

ports:

- port: 80

targetPort: 5000

protocol: TCP

selector:

name: fallball-connector

для этого нужен external endpoint. service - для общения подов между собой

Etki

Etki

подскажите как выставить сервис на IP адрес не кластера, (у меня это 10.132.x), а Internal IP (у каждой ноды кластера есть такой адрес в GKE)? Я был уверен читая доку что для этого нужно использовать NodePort, у меня это так

apiVersion: v1

kind: Service

metadata:

name: fallball-connector

labels:

name: fallball-connector

spec:

type: NodePort

ports:

- port: 80

targetPort: 5000

protocol: TCP

selector:

name: fallball-connector

создание NodePort не отменяет создание ClusterIP для сервиса, емнип

Etki

Etki

я даже думаю, что при указании NodePort просто создается дополнительное правило iptrables, которое трафик с этого порта перенаправляет на ClusterIP этого сервиса

Михаил

Михаил

Alex

Alex

как оно сейчас работает для того сервиса что я описал:

с любой ноды кластера можно сделать 10.10.19.41:80 и получить ответ

Alex

Alex

⇒ kubectl get svc

NAME CLUSTER-IP EXTERNAL-IP PORT(S) AGE

fallball-connector 10.10.19.41 <nodes> 80:31823/TCP 11m

Max

Max