Mark ☢️

Mark ☢️

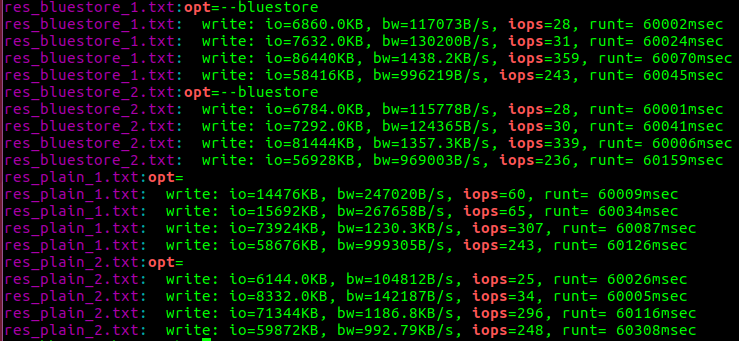

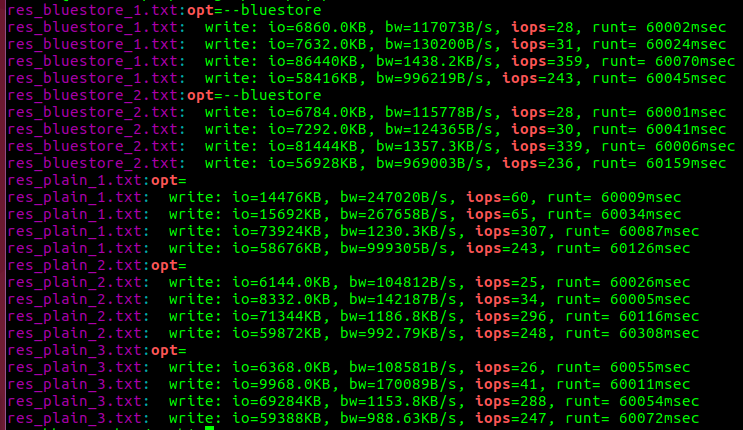

Короче. я специально забенчил все диски отдельно. и в совершенно одинаковых условиях забенчил блюстор и не-блюстор

Mark ☢️

Mark ☢️

(сейчас написал мегаскрипт который передеплоивает весь кластер и запускает бенчмарк). Вот чтоб прямо ТОЧНО всё тоже самое только блюстор и не блюстор

Михаил

Михаил

@SinTeZoiD есть идеи почему так? (как проверить, что всё произведено правильно) ?

Я не умею гадать по фотографии. Где методика тестирования? Где фио? Где описание дисков? Опять нет нихуя!

Mark ☢️

Mark ☢️

(мне прям сюда пастить или куда?) @SinTeZoiD . есть конкретные скрипты где прям видно как именно бенчится

Михаил

Михаил

Mark ☢️

Mark ☢️

Полностью автоматизированный тест: с пулом размера три на 6 дисках в итоге я получаю 307 иопсов. НЕ БЛЮСТОР. Я считаю, что это более чем отличный результат, который подтверждает, что никакие иопсы там в цефе не теряются. Хотя и странно, ведь они говорили про двойную запись....

Mark ☢️

Mark ☢️

4 эксперимента по 4 измерения в каждом. первые два измерения — рандомная запись в один поток. вторые два — в 32 потока.

Mark ☢️

Mark ☢️

ну и изза того что размер пула 3 — получается один иопс из фио жрёт три ипса в железе (ну типа в идеале)

Mark ☢️

Mark ☢️

ну и изза того что размер пула 3 — получается один иопс из фио жрёт три ипса в железе (ну типа в идеале)

Михаил

Михаил

ну и изза того что размер пула 3 — получается один иопс из фио жрёт три ипса в железе (ну типа в идеале)

https://habrahabr.ru/post/164325/

Mark ☢️

Mark ☢️

Это в идеале, понятно. В виду журналов, 1 к 6 должно быть. В блюсторе должно быть также, но в мб/сек меньше. По измерениям иопсов -- не так

Denis

Denis

можно в гисты графички припихнуть, аля https://gist.github.com/pcheliniy/b3c5e86bb328c41c61d8373bcdda2f1b

Александр

Александр

https://github.com/ceph/ceph/pull/12555 - ЙА КРОСАФЧЕГ

Ну норм... завтра в 8 дебиане поменяется и будешь ещё один пилить, что б изменили

Михаил

Михаил

Ну норм... завтра в 8 дебиане поменяется и будешь ещё один пилить, что б изменили

не тролль) хорошее дело пушить в гит баг фиксы

タキ

タキ

Всем привет! вопрос по конфигу цефа: Если мне для разных osd хочется укзать разные параметры - могу ли я сделать такой конфиг? http://pastebin.com/fbD6ngGk

Sergey

Sergey