Anonymous

Anonymous

а на xfs,ext4 вначале в журнал, а потом max_sync_interval срабатывает и пишется через syncfs. ну а syncfs вызывает sync

Mike

Mike

дело в том что на btrfs и ZFS данные пишутся одновременно и в журнал и на сам диск.

Да, ебать, и это их фишка, так же описанная в доке. Читать надо документацию.

Mike

Mike

а что, есть долбаеб использующий это с цефом ?

Резон есть. Btrfs, например, сверяет контрольную сумму блока при чтении, чего не делает сам ceph. Потоковая запись на btrfs - быстрее.

Anonymous

Anonymous

И, кстати, для записи в журнал не используется posix io. Используется libaio

не-не, я про сам стандарт Posix IO имел ввиду, а не про Posix AIO.

Евгений

Евгений

Вброшу:

Берём N+1 консьюмерских cloud-provider'ов.

Поднимаем на их базе файловые системы. Можно уровня fuse для swift'а, т.е. object-based. На базе этих файловых систем поднимаем ceph с mon'ами на своём компьютере и нескольких заныканных виртуалочках вокруг.

Дальше с этим можно работать как с _надёжным_ блочным или файловым устройством. Например, хранить собственные данные в таком виде, чтобы ни один провайдер не мог оставить вас без этих данных.

Если один из osd - локальный, то получаем лучшее от всех миров: локальную оффлайновую доступность, репликацию в безопасные независимые облака.

(c) amarao

Mark ☢️

Mark ☢️

Евгений

Евгений

...и не кушаем эти пельмени )

нет, вареные продаем на рынке за те же деньги, за которые купили оригинал, а бульончик сливаем к себе!

Artem

Artem

Всем привет! Прошу объяснить простую вещь,

залили 1.6 Тб на диск, после выполнили rm -rf *

Ceph место не освободил, собственно, что сделать чтобы он понял, что все потерли?

Artem

Artem

А если я сверху 1.6 терабайта заливаю, он данные перезаписывает или снова кладет?

Ну то есть понятно что с обычным HDD, он перезаписывает поверх, а что делает rbd?

Artem

Artem

Я просто наблюдаю за ceph -w там место уменьшается с процессом накопирования данных, причем примерно так

было 4582

стало 4577

Скопировано 4,6Gb

Artem

Artem

Новые данные размажет ещё на +400 гигов. Но это от фс внутри виртуалки зависит

Ну в общем ладно, спасибо за разъяснение завтра с утра проверю, надеюсь не увижу, что место кончилось =(

edo1

edo1

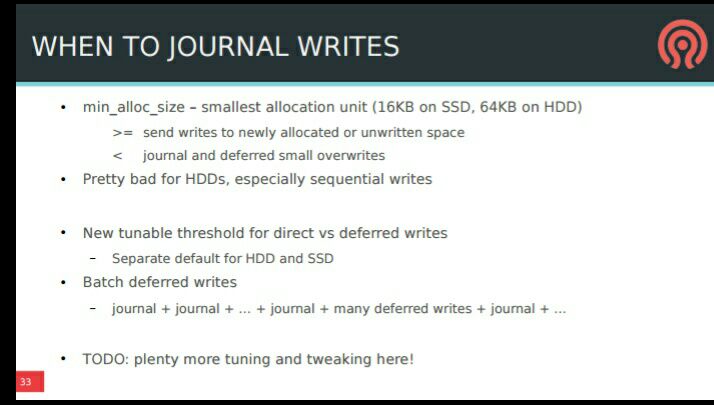

В тему двойной записи и блюстора: зато сейчас есть возможность хранить журнал на ssd, получается (почти) бесплатный wb кэш

Mark ☢️

Mark ☢️

Mark ☢️

Mark ☢️

https://www.google.ru/url?sa=t&source=web&rct=j&url=http://events.linuxfoundation.org/sites/events/files/slides/20170323%2520bluestore.pdf&ved=0ahUKEwiviMiv3bbVAhXLA5oKHWR0AZAQFggcMAA&usg=AFQjCNGuJ3P_UICVKZHTG2crNPZCnOdoyg

Anonymous

Anonymous

3.88d undersized+degraded+remapped+backfill_wait+peered [69,6,24] 69 [0] 0

3.36e undersized+degraded+remapped+backfill_wait+peered [71,4,37] 71 [46] 46

3.192 undersized+degraded+remapped+backfill_wait+peered [67,14,27] 67 [45] 45

3.c80 undersized+degraded+remapped+backfill_wait+peered [62,76,44] 62 [45] 45

3.204 undersized+degraded+remapped+backfill_wait+peered [75,52,1] 75 [45] 45

что в таком случае делать?

Anonymous

Anonymous

каким _вообще_ образом при всех целых OSD они оказались в peered? (= меньше min_size?)

а crushmap не смотрел? Может быть при добавлении дисков карта неверно собралась?

Евгений

Евгений

а какие предпосылки к этому могут быть?

А вот бывает. Например, когда крашмап самодельный. ceph osd tree прояснит положение дел.

Georgii

Georgii

относительно всего в кластере

то есть к примеру - в класиепе 6 нод, в кадой по 6 дисков - сделали пул на 3-х нодах на все диски (суммарно на 18) , и процент соответственно 50%?

Sergei

Sergei

то есть к примеру - в класиепе 6 нод, в кадой по 6 дисков - сделали пул на 3-х нодах на все диски (суммарно на 18) , и процент соответственно 50%?

то есть к примеру места в кластере 100Т, на rbd вы планируете потратить 20T, на rgw 79Т и по 100G на пулы с мета-инфой для rgw

Mikhail

Mikhail

Александр

Александр