банальна берем тест fio и гоняем на количество потоков, увеличение производительности будет с каждым потоком.

зависит от количества осд

Anonymous

Anonymous

если у тебя софт внутри виртуалки генерит один поток, хоть ты 100500 ОСД поставить, скорость будет единтичной

Mark ☢️

Mark ☢️

потому что писнул 4 метра в ПАМЯТЬ первого осд. НЕДОЖДАЛСЯ СИНКА. пошел писать второй блок и тд

Mark ☢️

Mark ☢️

а потом в конце когда будет мегасинк (если будет вобще) но должен. то будет ожидаться параллельно

Anonymous

Anonymous

Mark ☢️

Mark ☢️

ну и даже так -- оно там прописывается на магнитные как-бы в фоне. а когда гость даст команду на синк -- хуяк -- а оно уже на блинах

Anonymous

Anonymous

А какие цифры получаются в реале на однопоточной нагрузке?

thread=1 depth=1 30-40 МБ, при 30-40 IOPS'ов, тоесть блоком 1 Мб и это с тремя репликами

Anonymous

Anonymous

Так чтение не должно деградировать от числа реплик

Открою тайну :)), чтения в Ceph происохдит медленнее чем запись

Mark ☢️

Mark ☢️

Открою тайну :)), чтения в Ceph происохдит медленнее чем запись

да, но чтение суперхот данных в виртуалках и так кешируется неплохо

Anonymous

Anonymous

да, но чтение суперхот данных в виртуалках и так кешируется неплохо

ну как правило тесты все через drop cache гоняются..

Mark ☢️

Mark ☢️

ну как правило тесты все через drop cache гоняются..

тесты говенные. меряют ворст случай. а не реалистичный. ты же не проце не выключаешь кеш когда бенчмарки делаешь ?

Anonymous

Anonymous

тесты говенные. меряют ворст случай. а не реалистичный. ты же не проце не выключаешь кеш когда бенчмарки делаешь ?

Открываем любую доку по замеру производительности и видим там drop cache memory

Mark ☢️

Mark ☢️

тащемта если синки вызываются тогда когда хотел аффтар (на каждый врайт?) то хоть с кешем хоть без него.

Anonymous

Anonymous

вот тут поподробнее

тупо нет места для file cache :))). Да я на примере Oracle просто говорю

Mark ☢️

Mark ☢️

тупо нет места для file cache :))). Да я на примере Oracle просто говорю

ну тогда к ораклу. один хрен я уверен если они и используют о директ -- то у них свой кеш на чтение стопудово есть в оперативе

Anonymous

Anonymous

если рассматривать чтение, то более менее продакшеновский софт читает отличной от depth=1, как правило 32, в связи с этим проблемы чтения не так сильно чувствительны.

Anonymous

Anonymous

а вот с записью реально проблемы, т.к. основная масса СУБД (даже к некоторым NOSQL относится) пишут свои логи thread=1 и depth=1

Anonymous

Anonymous

поцггрес + асинк_коммит=Труе

несовсем, он их просто более большими блоками начинает писать и все равно делает fsync )

Mark ☢️

Mark ☢️

кеш ноне вобще в цефе не реализуем. ибо это означает кароче о_директ и пропуск пейджкеша. какой нафиг пейджкеш в рбд

Anonymous

Anonymous

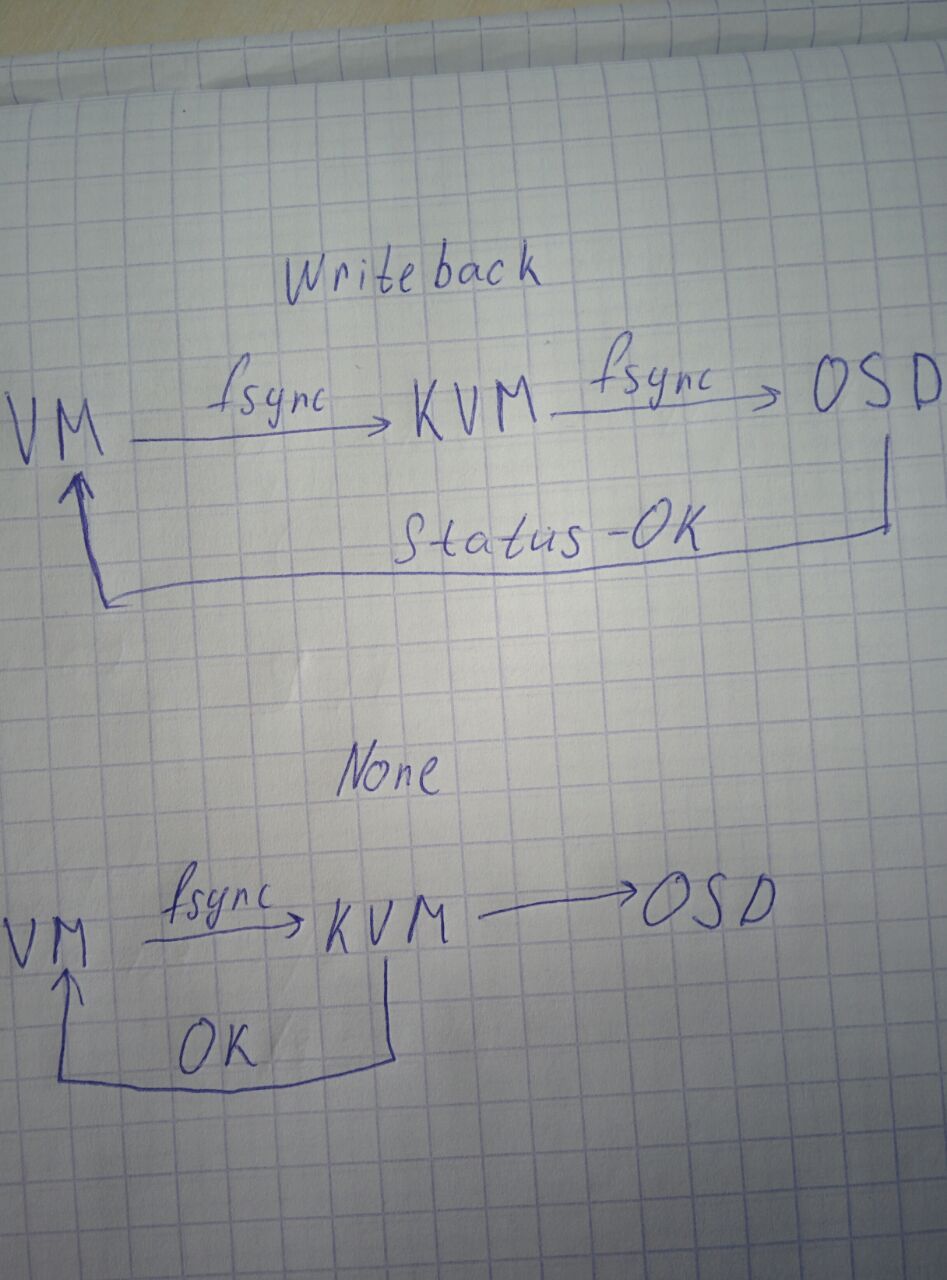

ну да не понятно нарисовал, но суть будет такая же, т.к. да, none в librbd не реализован, вот и команда fsync завернется на KVM