Я так говорю потому что вместо конкретных проблем вы цитируете доки и говорите чо-то в духе "слышал, работает плохо". Без обид)

Вот смотри, ты не веришь разрабам и докам, все тестишь сам - молодец, мне бы столько свободного времёни. К тому же, не считаю себя умнее разрабов ceph, в плане его разработки, внутреннего устройства и работы. Поэтому если они пишут, что не стоит использовать ext4 потому то и потому - склонен верить

J

J

We recommend against using ext4 due to limitations in the size of xattrs it can store, and the problems this causes with the way Ceph handles long RADOS object names. Although these issues will generally not surface with Ceph clusters using only short object names (e.g., an RBD workload that does not include long RBD image names), other users like RGW make extensive use of long object names and can break.

Anonymous

Anonymous

А не накидаете примеров настроек ceph, чтобы выжать из него по максимуму, с возможностью пережить ребаланс в момент дневной нагрузки

Anonymous

Anonymous

А что именно подбирать? Какие ручки крутить? У нас небольшой кластер в основном под образы rbd, подключаемых к linux физическим машинам, и вот хотелось бы эти образы хоть как то ускорить

J

J

Оно работает, но очень специфично.

Если база все время горячая, к ней все время есть обращения и если она поместится в быструю кэш прослойку целиком, то да, это поможет.

Но с таким же успехом можно вообще сделать пачку OSD прямо на ssd дисках.

J

J

Смотря какие SSD и смотря какая нагрузка.

Но если журналы и так на SSD, например, то чо уж там бояться)

J

J

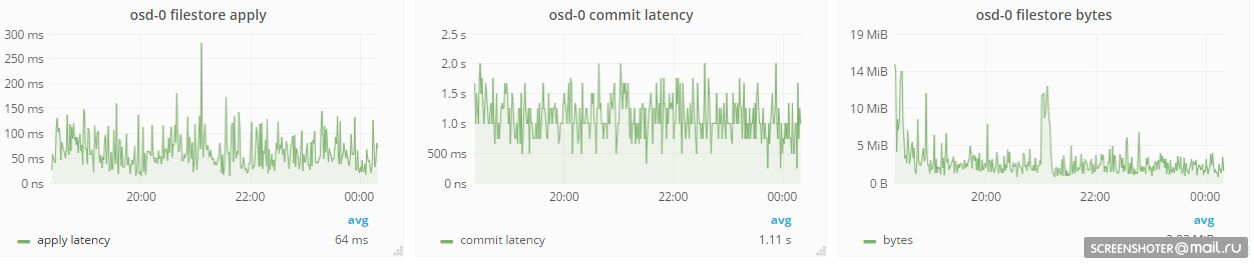

И тут же вопрос упадет ли у нас apply latency на osd при журналировании на ssd

Да, потому что транзакции будут считаться законченными сразу после того как в журналы всех OSD в placement группе запишется, диски ждать не придется.

Выходит, будет настолько быстрее насколько позволят SSD и сеть.

Anonymous

Anonymous

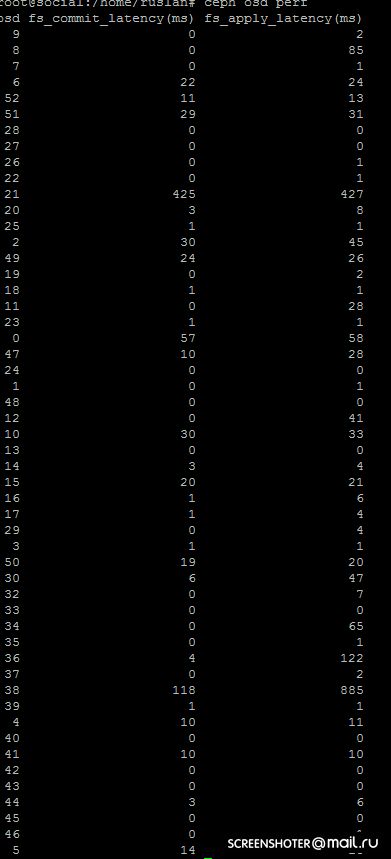

Commit latency на них где то 1-2 секунды(это когда я как понимаю происходит полный sync fs пороисходит)

J

J

Наоборот.

В цефе commit latency - задержка на запись в журнал, грубо говоря, а apply - на слив в filestore.

J

J

А вот как даже.

commitcycle_latency:

—------------------------

Filestore backend while carrying out transaction, do a buffered write. In a separate thread it does call syncfs() to persist the data to the disk and update the persistent commit number in a separate file. This thread runs by default 5 sec interval.

This latency measures the time taken to carry out this job after the timer expires i.e the actual persisting cycle.

apply_latency:

—------------—

This is the entire latency till the transaction finishes i.e journal write + transaction time. It will do a buffer write here.

Mike

Mike

Mark ☢️

Mark ☢️

Александр

Александр