Mark ☢️

Mark ☢️

Т.е. по твоему ceph так и пилят под Ubuntu? Вот что миллион Шаттлворда делает!

цеф просто пилят. не под што

Mike

Mike

Mark ☢️

Mark ☢️

That is beyond the scope of the library as this can be achieved by having the library accessed via a gateway: for example EOS or XRootD check the permissions on their own already but can use libradosfs for the storage backend.

Mark ☢️

Mark ☢️

So, to summarize its definition: libradosfs is a client-side implementation of a filesystem using RADOS, designed to provide a scale-out namespace and optimized directory/file access without strict POSIX semantics.

Mentat

Mentat

У меня тут тупой вопрос, а скорость чтения/записи кластера вообще скалируется от числа osd? И как примерно, если да, ссылки тоже подойдут, спасибо.

Mark ☢️

Mark ☢️

У меня тут тупой вопрос, а скорость чтения/записи кластера вообще скалируется от числа osd? И как примерно, если да, ссылки тоже подойдут, спасибо.

Если неистово долбить в один и тот же объект — то нет

M

M

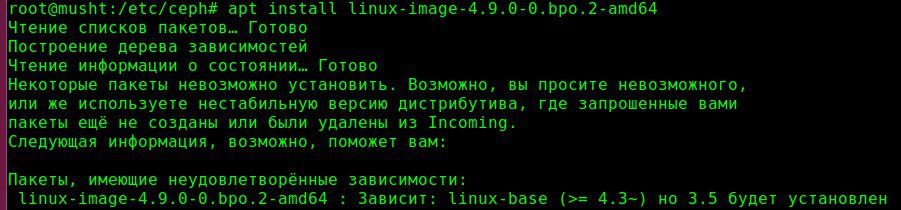

парни тупой вопрос

connect protocol feature mismatch, my fffffffffff < peer 10fffefdfffff missing 1000000000000

, раньше помогало

ceph osd crush tunables hammer

, сейчас что-то не хочет, ядра новые

4.9.24-coreos

, `

M

M

osd crush show-tunables

{

"choose_local_tries": 0,

"choose_local_fallback_tries": 0,

"choose_total_tries": 50,

"chooseleaf_descend_once": 1,

"chooseleaf_vary_r": 1,

"chooseleaf_stable": 0,

"straw_calc_version": 1,

"allowed_bucket_algs": 54,

"profile": "hammer",

"optimal_tunables": 0,

"legacy_tunables": 0,

"minimum_required_version": "hammer",

"require_feature_tunables": 1,

"require_feature_tunables2": 1,

"has_v2_rules": 0,

"require_feature_tunables3": 1,

"has_v3_rules": 0,

"has_v4_buckets": 1,

"require_feature_tunables5": 0,

"has_v5_rules": 0

}

Mark ☢️

Mark ☢️

А если в среднем по больнице?

Ну если релистично — то с ростом количества осд количество иопсов возможных возрастает. Но наибольшая выгода от паралеллизма. Цеф каг-бы сам по себе не ускоряет доступ. но зато может параллельно много операций дать. если же к цефу подключена одна виртуалка, то рандомные ио с неё тоже скейлится но не очень, ибо софтина и едро (фс) обычно не особо рассчитывают на параллеллизм хранилища. как-то так

Михаил

Михаил

цеффс кароч либо я не умею готовить, либо он реально отстой.

Ну CephFS изначально медленнее RBD

Mark ☢️

Mark ☢️

но если в рбд своя фс (типа как у меня) - а в ней свой журнал — это ж двойные синки. запись должна быть медленнее

Mark ☢️

Mark ☢️

а меня нет. не хочу экспандить образ по необходимости. ну и в теории (где пони какают радугой) цеффс должен быть быстрее типа потому что меньше слоёв

Sergey

Sergey

еще и за журнала который постоянно переписывает через себя весь поток входящих данных, оно еще и не бюджетно выходит

Mark ☢️

Mark ☢️

Александр

Александр

вот ещё одна причина перехода на CephFS

А ты под что вообще делаешь, а то я пропустил чото

Mark ☢️

Mark ☢️

Епрст, что хранить?

Ёпрст. 120 гигов рпм-файлов. И при сборке их обновлять вместе с ёпрст их метаданными

Gleb

Gleb

Stanislav

Stanislav

Старый

Старый

Ilya

Ilya