Anonymous

Anonymous

А если попытаться скрестить VMware и storage на ceph на одном физическом хосте? Т.е. сделать этакий аналог ScaleIO.

Stanislav

Stanislav

Нормальная хранилка. где-то $20-30к за 10Тб.

Каких ТБ, сырых? Делл свою Юнити предлагает за меньше 10к за 10тб.

Anton

Anton

А если попытаться скрестить VMware и storage на ceph на одном физическом хосте? Т.е. сделать этакий аналог ScaleIO.

Зачем делать аналог ScaleIO, есть есть бесплатный ScaleIO? Datacore, VSAN, да на худой конец Starwind.

Для платной VMware

Sergey

Sergey

Каких ТБ, сырых? Делл свою Юнити предлагает за меньше 10к за 10тб.

это цены без самих дисков?

Stanislav

Stanislav

ну хранилка + лицензиня на такое дисковое пространство

Нет, с дисками конечно ) вообще у делл/емц достаточно грамотные пресейлы, если до них добраться через голову сейлзов реселеров. Готовы и Юнити предложить, и скейл.ио, и нутаникс

Anton

Anton

> если до них добраться через голову сейлзов реселеров.

Ой сложно! :)

Все есть, все известны, все в фейсбуке

Stanislav

Stanislav

> если до них добраться через голову сейлзов реселеров.

Ой сложно! :)

Все есть, все известны, все в фейсбуке

Для этого надо нормально закупаться и знать, что нормальные люди там есть ) а когда начинаешь этим с улицы заниматься - полный треш

Anonymous

Anonymous

А по бесплатному scaleio нормальная документация есть? Насколько я в курсе - за бесплатно - нет. И первый же чих принесет много интересного.

Anton

Anton

А по бесплатному scaleio нормальная документация есть? Насколько я в курсе - за бесплатно - нет. И первый же чих принесет много интересного.

Документация за деньги - это что-то новое.

Бесплатный от платного отличается поддержкой, насколько мне известно

Dimonyga

Dimonyga

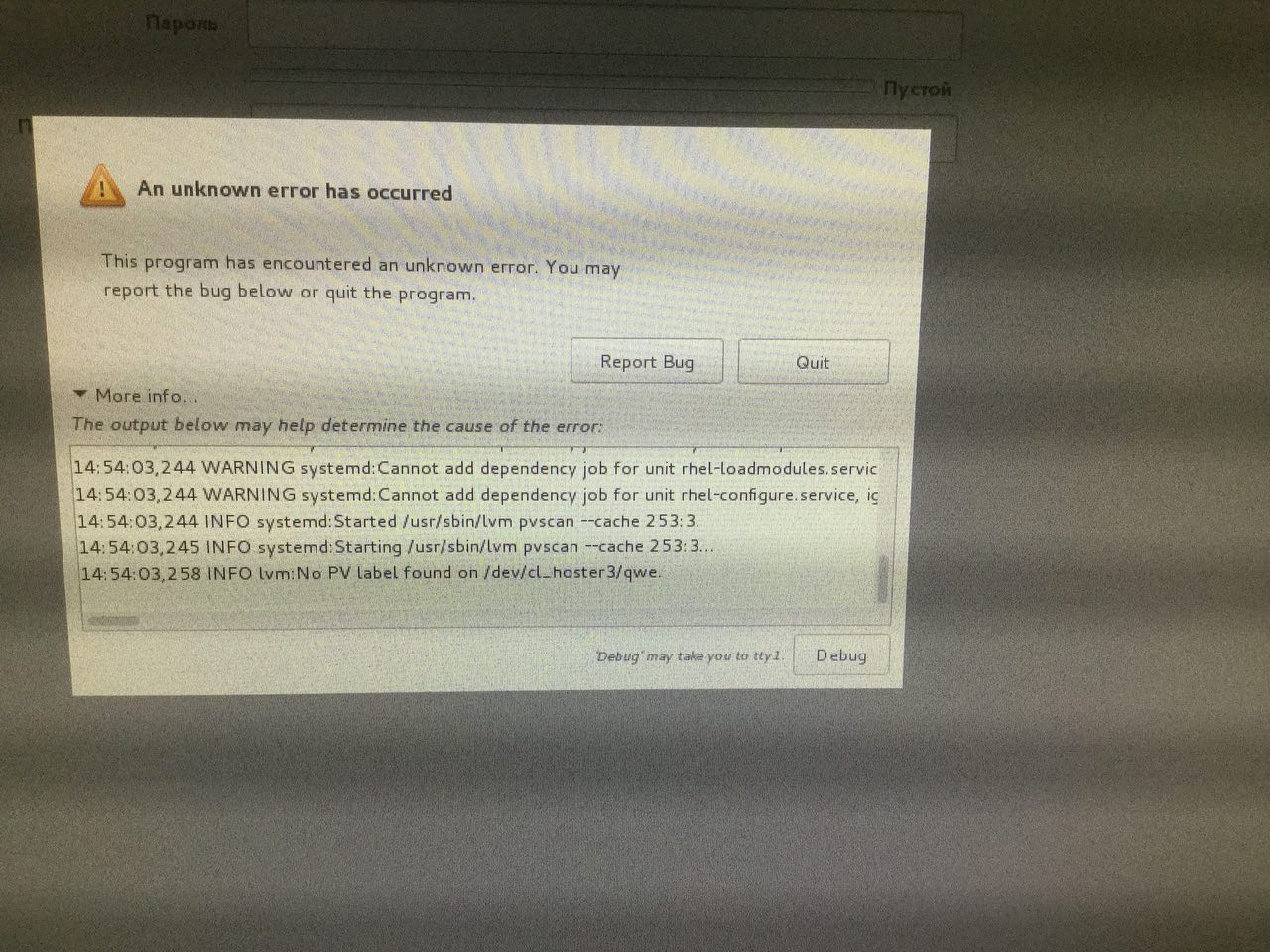

Ставлю седьмой центос под ещё один нод

Отличный выбор! =) Но вот кракен ..... Если бы джевел - можно прям не ставя репы сторонние сделать yum install centos-ceph-jewel && yum install ceph-deploy

Евгений

Евгений

Как кошернее всего перенести образы в другой пул ?

не кошерно но факт - rbd export пайпом пустить в rbd import

можно через pv, чтобы на скорость смотреть

Mark ☢️

Mark ☢️

Народ! А вы у себя используете replica size = 2 или 3?

У меня 2. Я нищеброд. Но скоро сделаю 3

Mark ☢️

Mark ☢️

не кошерно но факт - rbd export пайпом пустить в rbd import

можно через pv, чтобы на скорость смотреть

А аналогично через qemu-img норм ?

Mark ☢️

Mark ☢️

Через pv не надо, он однопоточный

А что экспорт в несколько потоков умеет ? Если через пайп в импорт -- то пайп то всеравно один.

Mike

Mike

А что экспорт в несколько потоков умеет ? Если через пайп в импорт -- то пайп то всеравно один.

Из-за pv скорость падает сильно.

Евгений

Евгений

pv режет скорость?)

Похоже на то. У меня при вот такой конструкции dd if=/dev/rbd0 bs=8M | pv | dd of=/dev/sdd bs=8M скорость 50 мегабайт в секунду. При условии, что слева ceph на 10 гигабитной сетке, а слева - ssd на pci-e

Logan

Logan

Скорость показывает. Это первый совет на SO на тему "чем посмотреть скорость dd"

Вообще в моменте скорость модно посмотреть через сигнал. PV - вариант для ленивых

Александр

Александр

[root@nfs ~]# dd if=/dev/zero of=/solutions/testfile.1G bs=128k count=400k conv=fdatasync status=progress

скопировано 3102343168 байт (3,1 GB), 3,000273 s, 1,0 GB/s^C

Logan

Logan

[root@nfs ~]# dd if=/dev/zero of=/solutions/testfile.1G bs=128k count=400k conv=fdatasync status=progress

скопировано 3102343168 байт (3,1 GB), 3,000273 s, 1,0 GB/s^C

а он в моменте показывает? Или только по факту? И, кстати, оно не всегда работает почему-то

Александр

Александр

а он в моменте показывает? Или только по факту? И, кстати, оно не всегда работает почему-то

во время выоплнения показывает

Александр

Александр

[root@nfs ~]# dd if=/dev/zero of=/solutions/testfile.1G bs=128k count=400k conv=fdatasync status=progress

скопировано 6210715648 байт (6,2 GB), 6,000331 s, 1,0 GB/s^C

50173+0 записей получено

50173+0 записей отправлено

скопировано 6576275456 байт (6,6 GB), 6,35491 c, 1,0 GB/c

Mark ☢️

Mark ☢️

Mark ☢️

Mark ☢️

А в виду буфферизации, чтения не будет происходить при записи потому блок будет переписываться целиком. Ну мож кроме первого блока

Alex

Alex

Кстати как можно забекапить клонированный образ в ceph, чтоб при его потере восстановить и этот образ был по прежнему клоном, а не самостоятельной единицей как при rbd import? На ум приходит только делать diff-export.

Евгений

Евгений

Евгений

Евгений

Это логично. Но интересует весь процесс в целом

ну, после импорта сделать

rbd snap create image@backup

rbd snap protect image@backup

Alex

Alex

ну, после импорта сделать

rbd snap create image@backup

rbd snap protect image@backup

Не совсем то, что мне нужно. Схема такая: есть gold образ от которого создаются виртуалки

rbd clone pool/gold-image@snap pool/vm-image

Так вот мне нужно бекапить vm-image так, чтобы при восстановлении vm-image он не стал самостоятельным образом

Евгений

Евгений

Alex

Alex

так уже на созданном клоне делайте snap create

Похоже это то что нужно:

https://skuicloud.wordpress.com/2014/12/19/openstackceph-rbd-incremental-backup-and-restore/

Mark ☢️

Mark ☢️

fio —ioengine=libaio —direct=1 —name=test —bs=4k —iodepth=1 —readwrite=randwrite —filename=/dev/sdb —runtime 10

Mark ☢️

Mark ☢️

fio —ioengine=libaio —direct=1 —name=test —bs=4k —iodepth=32 —readwrite=randwrite —filename=/dev/sdb —runtime 10

Radik

Radik

Михаил

Михаил

Pavel

Pavel