Михаил

Михаил

А в чем выражается "так себе". В доке не натыкался

Уф, я по доке сужу, там как раз про эффективность было

Pavel

Pavel

Known Bad Workloads

The following configurations are known to work poorly with cache tiering.

RBD with replicated cache and erasure-coded base:

Mike

Mike

Народ, а кто сравнивал cache tiering vs journal ssd. По удобству первый явно лучше, как со скоростью холодных данных?

Вообще это разные сущности, никак не связанные и не противопоставленные

Pavel

Pavel

RBD with replicated cache and base: RBD with a replicated base tier does better than when the base is erasure coded, but it is still highly dependent on the amount of skew in the workload, and very difficult to validate. The user will need to have a good understanding of their workload and will need to tune the cache tiering parameters carefully.

Alex

Alex

RBD with replicated cache and base: RBD with a replicated base tier does better than when the base is erasure coded, but it is still highly dependent on the amount of skew in the workload, and very difficult to validate. The user will need to have a good understanding of their workload and will need to tune the cache tiering parameters carefully.

Меня именно это. Случай интересует. В целом описание довольно абстрактное. Логично что Настройки Кеша нужно подбирать.

Pavel

Pavel

Меня именно это. Случай интересует. В целом описание довольно абстрактное. Логично что Настройки Кеша нужно подбирать.

Это идёт в разделе known bad workloads

Mike

Mike

Проблема в том, как работает cache tier. Хорошо, что используется bloom фильтр, но вот реализация evict/flush - печальная

Alex

Alex

Проблема в том, как работает cache tier. Хорошо, что используется bloom фильтр, но вот реализация evict/flush - печальная

А в чем печаль? Просто не могу найти нормальных бенчей. Обычно параметры там от балды ставят.

Mike

Mike

ну вот у тебя по дефолту размер объекта - 4Mb. Ты записываешь 1Кб данных, а ceph поднимает из холодного пула в горячий - полностью весь объёкт, т.е. 4Мб

Logan

Logan

Народ, а кто сравнивал cache tiering vs journal ssd. По удобству первый явно лучше, как со скоростью холодных данных?

коллективный опыт хабра показывает, что тиеринг всегда выливается в all-flash хранилище. Если у вас традиционная война быстро/дешево - делайте раздельные пулы и классы обслуживания. Увы.

Alex

Alex

коллективный опыт хабра показывает, что тиеринг всегда выливается в all-flash хранилище. Если у вас традиционная война быстро/дешево - делайте раздельные пулы и классы обслуживания. Увы.

В последнее время опыт хабра уже совсем не торт ))) Сейчас как раз и разбито - быстрый пул ssd only, медленный - hdd. Но руки чешутся кэш пощупать .

Logan

Logan

В последнее время опыт хабра уже совсем не торт ))) Сейчас как раз и разбито - быстрый пул ssd only, медленный - hdd. Но руки чешутся кэш пощупать .

на хабре было несколько подобных инсталляций. Все они пришли к all-flash

Alex

Alex

Не не не. Вариант когда предлагают на один ssd поставить 5 osd. И на каждой ноде по такому принципу разбить 2 и более ssd меня не устраивает. Вариант вылета целой ноды при таком конфиге не радует

Logan

Logan

Не не не. Вариант когда предлагают на один ssd поставить 5 osd. И на каждой ноде по такому принципу разбить 2 и более ssd меня не устраивает. Вариант вылета целой ноды при таком конфиге не радует

это вам решать, на чем вы будете экономить. Я бы ставил парой SSD+HDD.

Alex

Alex

это вам решать, на чем вы будете экономить. Я бы ставил парой SSD+HDD.

ssd в этом случае под журнал?

Logan

Logan

да. Если вам действительно никак не получается сделать нормально all-flash - хотя бы журнал под SSD.

Alex

Alex

Так у нас и так пул с виртуалками на ssd только. Я hdd пул хотел ускорить, с которого нарезаются доп диски для не критичных по iops данных. А вот по месту там нужно много.

Dimonyga

Dimonyga

Расскажу свой небольшой опыт по SSD + HDD для RBD: много всего пробовали, в итоге самой быстрой конфигурацией оказалось запуск ОСД на Flashcache. Очень хотелось поиграться с кэш пулами, но увы, для RBD оно работает не так хорошо как хотелось бы. Особенно под базами данных и подобным. В итоге юзаем RAID10 под пулы для mission critical, HDD + SSD + Flashcache под базы данных (нужнал находится якобы на HDD, но весь живет в кэше на SSD) и простые HDD + jerasure под большие хранилища.

Mikhail

Mikhail

В последнее время опыт хабра уже совсем не торт ))) Сейчас как раз и разбито - быстрый пул ssd only, медленный - hdd. Но руки чешутся кэш пощупать .

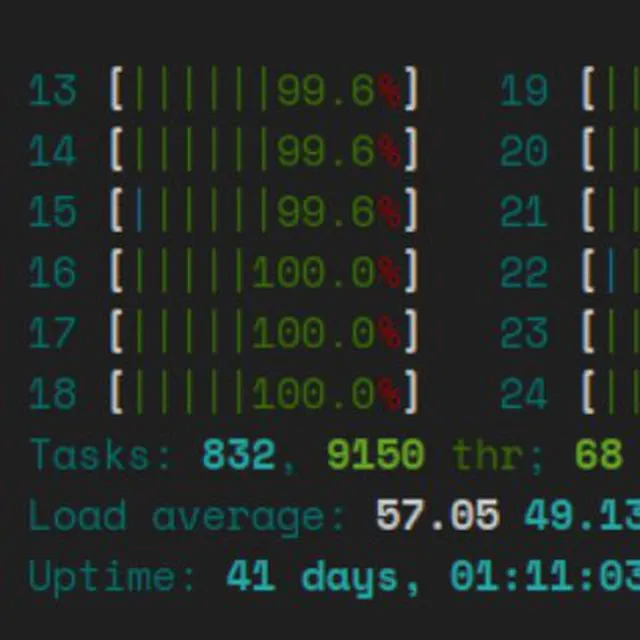

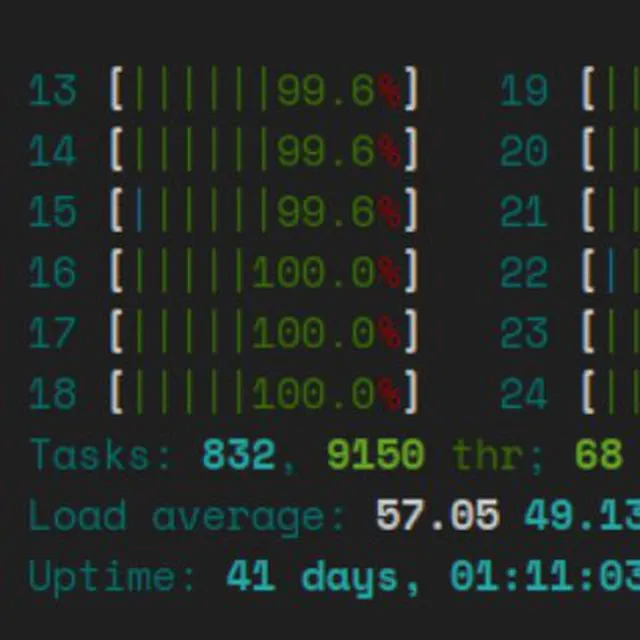

cache-tier - штука загадочная, при r/w нагрузке и rbd смысл в нем появляется если данные полностью умещаются в кеш, т.к. если начинаем читать то, что находится не в кеше - производительность падает, всплески на запись он конечно сгладит, но точно так же (и даже лучше) их сгладят и журналы на ссд.

Dorian

Dorian

Starting with version 9.0, DRBD has an auto-promote feature. That allows you arbitrarily use other cluster managers that are able to mount a file system on a shared storage device.

До чего дошёл прогресс

Dimonyga

Dimonyga

Если нод планируется 2-е то лучше DRBD. под Ceph надо по доке от 3-х/, а в реальности желательно от 5-ти.

Михаил

Михаил

Можно в этом направлении копать: http://docs.ceph.com/docs/master/rbd/rbd-mirroring/

В комментариях ко вчерашней статье сказали, что не продакшн вариант)

Dorian

Dorian

http://www.slideshare.net/Hadoop_Summit/selective-data-replication-with-geographically-distributed-hadoop?from_m_app=android

Михаил

Михаил

https://www.youtube.com/watch?v=bbPO3Qb7gzA

как 50 минут рассказывать ниочем

можно смотреть с 25 минуты где-то, если хочется.

Stanislav

Stanislav

Valentin

Valentin