1С:Файловое хранилище

почему то представил бункер, весь залитый канализацией прорвавшейся, а внутри в ржавых сейфах дискеты 5.25. а особо важное на кассетах

Vladimir

Vladimir

не могу с ходу найти. что там внутри вкратце? глустер?

не знаю. я только с виртуоззо контейнерами работаю

Nick

Nick

ну и вообще ploop это такая, штука, которая с одной стороны хорошо, а с другой стороны больно дорого обходится

Vladimir

Vladimir

вот только в реальной жизни 10 гигабит там уходит на три вдс, а дальше все

а можно подробнее?)

Vladimir

Vladimir

но из рекламного проспекта звучит красиво

во, нашёл: https://virtuozzo.com/wp-content/uploads/vz7/doc/Virtuozzo7_Platform_Benchmarck_DS_EN_Ltr_20160720.pdf

Vladimir

Vladimir

это лучше в каком-нибудь соседнем чатике к @pavel_odintsov

ладно, сворачиваем оффтоп. извините )

Mike

Mike

Поверю, что ceph может проиграть, например, scaleio, только scaleio это только блок и модули в ядре. А все остальное - придется городить рядом и терпеть перемещение данных между системами.

Sn00part

Sn00part

ceph делают учёные, на большие бабки, плюс огромное коммьюнити и промышленные контракты. в такой ситуации 1с и другим крыть просто нечем. а зная эти все продукты изнутри, я бы с таким прикупом мизер бы не пошел

Vlad

Vlad

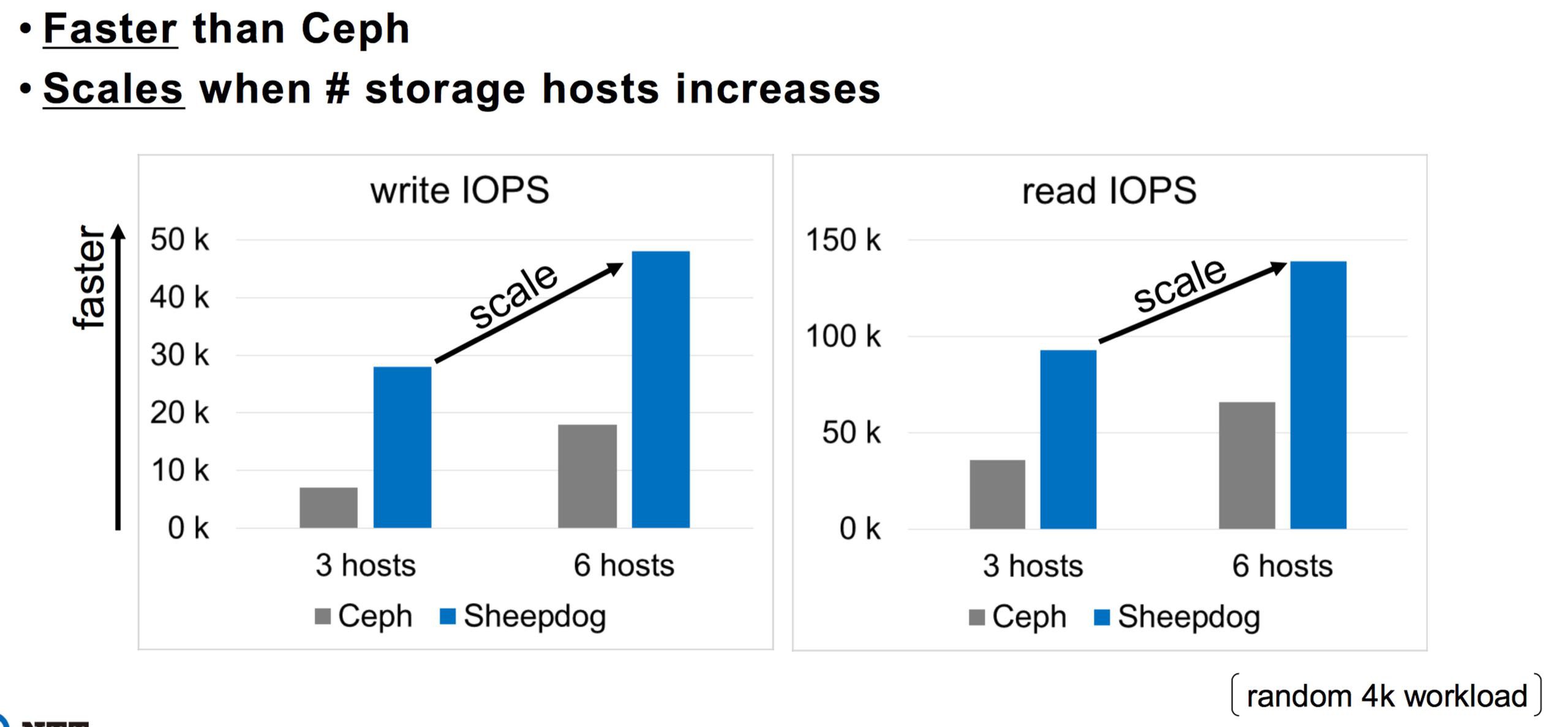

Кстати на sheepdog не пробовали делать кластер? Я пару лет назад делал - был быстрее ceph раза в три.

Mark ☢️

Mark ☢️

Кстати на sheepdog не пробовали делать кластер? Я пару лет назад делал - был быстрее ceph раза в три.

Я возбудился. А он точно синкает когда нужно ? С тремя репликами ?

Vlad

Vlad

https://sheepdog.github.io/sheepdog/_static/openstack-summit-2016-barcelona-vbrownbag-sheepdog.pdf

Vlad

Vlad

Я возбудился. А он точно синкает когда нужно ? С тремя репликами ?

я запускал с --nosync. Но у меня было два датацентра и дисковые кэши с батарейками. См. последний абзац: https://github.com/sheepdog/sheepdog/wiki/Why-The-Performance-Of-My-Cluster-Is-Bad

Mark ☢️

Mark ☢️

The qemu block driver communicates with only one gateway that is specified during the boot time of the qemu process. And the gateway node calculates object locations based on sheepdog's consistent hashing as you already noticed. It simplifies the assumption about hardware fault e.g., gateway node and qemu processes are executed on a same host so hardware fault can kill both of them at once. Although iSCSI can break this assumption, it has its own mechanism of multipath.

I'm not sure about your motivation of calculating the object location in the block driver, performance improvement?

Mark ☢️

Mark ☢️

Получается, что в шыпдоге нужно гатевей запускать на тех компах где куему и подключаться грубоговоря на локалхост. Превед миграция.

Mark ☢️

Mark ☢️

@SinTeZoiD это тебе для странички "почему не шипдог, хоть он и быстрее и проще". Там же и про отсутствие возможности настроить чтобы например хранил реплики принудительно в разных стойках

Михаил

Михаил

Mark ☢️

Mark ☢️

да, шипдог больше чем цеф подходит для гиперконвергентных кластеров

Вот это слово мне не понятно вобще

Mike

Mike

Ибо file based, метаданные хранятся в inode - жесткая привязка к наличию файловой системы.

Метод хеширования простой как качерга - IP/volume name. Возможно может стать проблемой. Сложно сделать карты распределения, как в ceph.

Mike

Mike

Но почему он у них быстрее цефа ? Вот в чем вопрос

Вопрос больше не в этом, а в том как они делали тест. Как был настроен ceph.

Mike

Mike

И когда были сделаны тесты. Не секрет, что write/read path в ceph не оптимизированы, хоть за последние полтора года скорость чтения подняли существенно.

Pavel

Pavel

Может кому будет интересно: http://florian.ca/ceph-calculator/

о, я такое делал только в форме скрипта

Vladimir

Vladimir

Добрый день! ) А кто как борется c интенсивным ребалансингом всего CEPH кластера при добавлении новых OSD ? У нас в работе порядка 60 OSD, добавление одной OSD утилизирует кластерный канал до 8 гигабит и длится около 2-х часов ) Это при условиии, что средняя заполненность каждой OSD примерно 450GB из 1TB.

Vladimir

Vladimir

Сейчас вывод такой: при добавлении более 2-х OSD в рабочий кластер с 60 OSD (~450 GB утилизация каждой) сеть в 10G ляжет в легкую. Это конечно при условии, что у вас журналы на SSD + на бэкэнде диски 10K

Pavel

Pavel

--osd_recovery_op_priority 1

—osd_max_backfills 1

—osd_recovery_max_active 1

—osd_recovery_threads 6

Vladimir

Vladimir

--osd_recovery_op_priority 1

—osd_max_backfills 1

—osd_recovery_max_active 1

—osd_recovery_threads 6

Первые три опции у нас есть, osd_recovery_threads нужно видимо попробовать.

Juriy

Juriy

Александр

Александр