Михаил

Михаил

На гигабите даже не пытаться?

Лабу можно. Интерконнект к проду тоже можно попробовать, но вдумчиво, понимая тип нагрузки. А вот интерконнект между нодами цефа нужен 10г. Иначе ребаланс будет долгим и печальным

Pavel

Pavel

Лучше просто взять и посчитать, сколько будет ребаланс и сколько будет потолок между цефом и клиентом

kay

kay

Коллеги, я понимаю, что это чятег про openstack, но всё же отважусь задать вопрос.

Можно ли в openstack создать attacheable volume без cinder? Volume же создаётся под каждую виртуалку без cinder, значит должна быть возможность создавать его без отдельного хранилища.

Пока у меня только вот такой результат:

$ cinder list

+--------------------------------------+--------+-------------+------+-------------+----------+-------------+

| ID | Status | Name | Size | Volume Type | Bootable | Attached to |

+--------------------------------------+--------+-------------+------+-------------+----------+-------------+

| ae59dee1-e889-48bb-963d-1dfd904784ad | error | test | 10 | - | false | |

+--------------------------------------+--------+-------------+------+-------------+----------+-------------+

Albert

Albert

Итак, контролер упал, зато все компьют ноды остались рабочими. Но, все инстансы потеряли сеть. Сеть с инстансами вернулась когда контролер вернули. Что это может быть? Почему такая надобность в контролере для работы сети?

Tverd

Tverd

В общем если контроллер шлюз и различные подсети для виртуалок, соответственно при отключении контроллера они не будут друг друга видеть. Если в одной подсети, то пофигу

Artem

Artem

По volume у кого-нибудь есть соображения?

не понимаю вопроса- по сути ты на cinder можешь скормить локальную lvm vg и она по iscsi будет подключаться на compute ноды(хранилка не отдельная- все в рамказ ноды, где стоит cinder-volume)

Artem

Artem

что есть cinder host? у тбея есть где запутсить cinder-volume и где будет lvm vg, которую можно пользовать как хочется?

Artem

Artem

* но естественно, если этот хост с cinder-volume упадет- то все виртуалки лягут по отвалу диска

kay

kay

@saamich ты предлагаешь запустить cinder-volume в кластере openstack и зарегистрировать его в openstack?

Artem

Artem

@saamich ты предлагаешь запустить cinder-volume в кластере openstack и зарегистрировать его в openstack?

ну теоритически это можно сделать- если скорость работы не критична, но я предлагал запутсить вышеозвуечнные сервисы на любой ноде, где есть такая возможность

kay

kay

@saamich доступа к compute node нет. могу лишь только сервисы зарегистрировать через keystone service-create. сейчас вот запустил виртуалку со 100Gb root partition. И сразу же наткнулся на проблему. Ubuntu cloud image по умолчанию ресайзит partition до максимального размера. Сейчас пытаюсь понять как ужать текущий раздел.

kay

kay

* загрузиться в rescue cd? не понял как... вроде как можно только создать instance, который будет грузиться с ISO, но не перезагрузить текущий instance в ISO

* запретить cloudinit ресайзить диск? тоже пока не понятно.

* ресайзить диск наживую?

Artem

Artem

* загрузиться в rescue cd? не понял как... вроде как можно только создать instance, который будет грузиться с ISO, но не перезагрузить текущий instance в ISO

* запретить cloudinit ресайзить диск? тоже пока не понятно.

* ресайзить диск наживую?

это только через фмниы ушами и ручной/virsh правкой конфигов ВМ

kay

kay

@saamich запилил конфиг:

#cloud-config

growpart:

mode: {{ grow_partition }}

теперь при деплое виртуалка не ресайзит диск.

Artem

Artem

и как его регистрировать в openstack service

он не регистрируется, как понимаю регается api сервис

Artem

Artem

openstack compute service list | grep cinder пусто

http://docs.openstack.org/mitaka/install-guide-rdo/cinder-controller-install.html - примеры как зарегать там есть

kay

kay

openstack service create --name cinder --description "OpenStack Block Storage" volume

Could not find requested endpoint in Service Catalog.

Mikhail

Mikhail

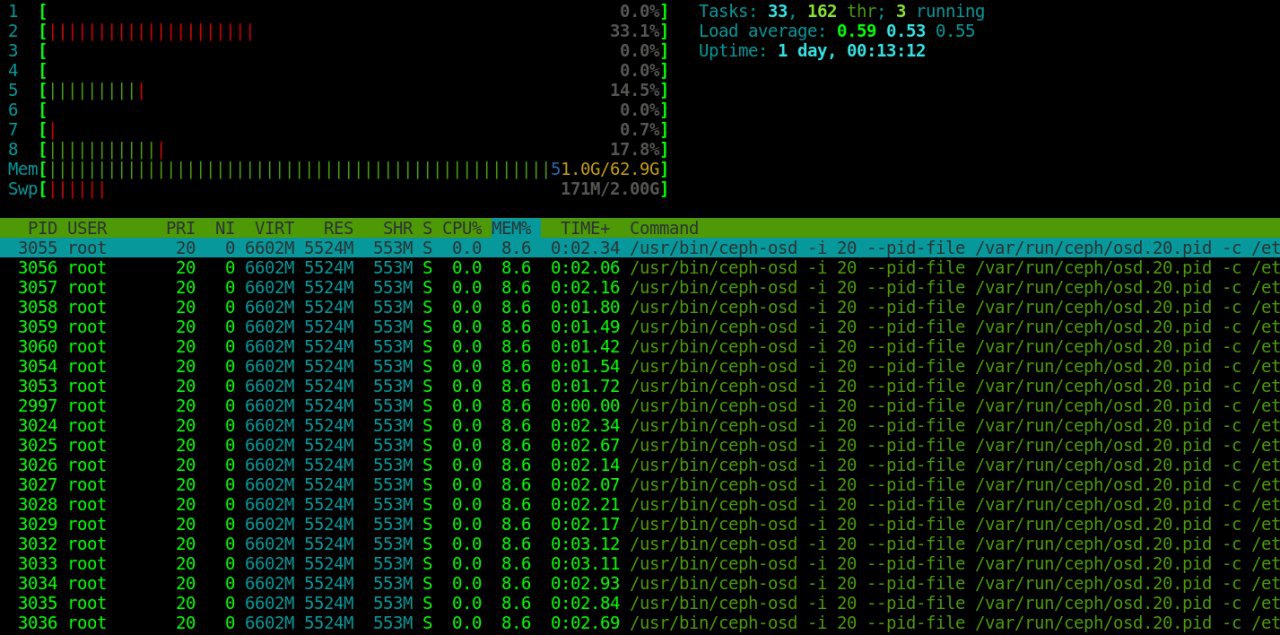

вот кстати о первом: я тут ошибся немного с количеством нулей и попытался создать image размером почти в петабайт, ceph начал генерить объекты и на 20+ млн, часов через 12 ноды tier пула стали падать из-за нехватки памяти, на них было по 4гб озу, разделы диска по 500 гб

Mark ☢️

Mark ☢️

Mikhail

Mikhail

сама операция создания имиджа на этом сдохла, но 20 млн объектов-то в пуле остались, я добавил памяти нодам, благо они на виртуалках и они теперь кушают по 50 гб озу

Mikhail

Mikhail

вот мне интересно, это у меня что-то не так пошло или сколько ж им памяти надо на большом объеме пула?

Александр

Александр

NS 🇷🇺

NS 🇷🇺

Sergei

Sergei